Show HN Today: Discover the Latest Innovative Projects from the Developer Community

ShowHN Today

ShowHN TodayShow HN 今日精选:2025-09-03最热门的开发者项目展示

SagaSu777 2025-09-04

探索2025-09-03 Show HN上最热门的开发者项目,包括创新技术、AI应用等激动人心的新发明。深入了解这些引人注目的项目!

今日内容汇总

趋势洞察

今日的 Show HN 展示了技术创新的前沿,尤其是在人工智能领域,开发者们正积极探索如何让 AI 更智能、更高效、更易用。我们看到,与其一味追求模型规模,不如深入挖掘模型自身的推理机制,例如通过“熵引导循环”来优化小模型的表现,这对于开发者和创业者来说,意味着用更低的成本实现更高的智能水平,特别是在资源有限的场景下。同时,面向开发者的工具层出不穷,从文本到 SQL 的语义层、Tailwind CSS 可视化编辑、API 密钥管理到 Rust AST 查询,这些都极大地提升了开发效率和体验。其中,开源和本地化部署是显著趋势,这不仅降低了使用门槛,也给了用户更大的自主权。此外,AI 的应用场景也在不断拓宽,从分析用户流失到自动化会计工作,再到生成创意内容,甚至将视频编码到 Git 中,都体现了技术驱动的创新力。对于有想法的开发者,不妨关注这些正在兴起的领域,并思考如何用你的技术创造性地解决实际问题,拥抱黑客精神,将那些看似不可能的点子变为现实。

今日最热门产品

名称

Show HN: Entropy-Guided Loop – How to make small models reason

亮点

这个项目通过分析大型语言模型(LLM)生成过程中的“不确定性信号”(如 logprobs、perplexity、entropy),来智能地判断何时以及在何处需要模型进行二次思考和修正。开发者可以通过这种方式,用更小的模型在特定任务上达到接近大型模型的表现,显著降低成本。其核心技术在于利用模型自身输出的概率信息来指导推理过程,这是一种非常精妙的“自我反思”机制。学习者可以从中获得关于如何通过优化推理路径而非单纯增大模型规模来提升AI性能的宝贵经验。

热门类别

AI/ML

Developer Tools

Productivity

Web Development

Utilities

热门关键字

AI

LLM

Python

JavaScript

Rust

Open Source

CLI

Web App

Automation

Data Visualization

技术趋势

LLM Reasoning Enhancement

Developer Productivity Tools

AI for Content Creation/Analysis

WebAssembly/Client-Side Performance

Rust Ecosystem Growth

Data Visualization & Analysis

Open Source Infrastructure Alternatives

AI Safety & Monitoring

Personalized AI Assistants

Creative AI Applications

项目分布

AI/ML Related (35%)

Developer Tools/Utilities (25%)

Web Applications/Frameworks (15%)

Productivity/Niche Tools (15%)

System/Performance Tools (10%)

今日热度产品榜单

| 排名 | 产品名称 | 点赞数 | 评论数 |

|---|---|---|---|

| 1 | VoiceGecko:系统级全局语音输入 | 53 | 9 |

| 2 | 熵能引导推理循环 | 31 | 1 |

| 3 | Chibi:AI驱动的用户行为洞察引擎 | 11 | 3 |

| 4 | Tradomate.one: 智能回测的股票筛选器 | 6 | 7 |

| 5 | GraphQL2SQL | 7 | 2 |

| 6 | Tail Lens - 实时Tailwind CSS可视化编辑器 | 7 | 1 |

| 7 | AI能耗追踪器 | 2 | 6 |

| 8 | JSONDiffMate | 3 | 4 |

| 9 | 元认知AI发明助手 | 3 | 3 |

| 10 | LLM风格探针:闪小说语境下的模型能力可视化 | 6 | 0 |

1

VoiceGecko:系统级全局语音输入

作者

Lukem121

描述

VoiceGecko 是一款突破性的系统级语音输入工具,它能将你的声音转化为文字,并能精准地在电脑上的任何应用程序中进行输入,无论你在使用什么软件,它都能完美配合。其核心创新在于绕过了传统应用层面的限制,实现了全局的语音输入集成,解决了在不同软件之间切换语音输入时的不便。

人气

点赞 53

评论数 9

这个产品是什么?

VoiceGecko 是一个能够让你的电脑听懂你说话并帮你打字的系统级工具。它不像普通输入法那样只在特定文本框里工作,而是可以让你在任何地方,比如写邮件、聊天、写代码、甚至在命令行里,只要你想输入文字,都可以直接用嘴巴说出来,VoiceGecko 就会帮你把这些声音翻译成文字并直接输入到你当前正在使用的那个地方。它的技术创新之处在于,它能够深入到操作系统层面,像一个超级用户一样,把语音识别的成果精准地“粘贴”到电脑上的任何可输入区域,这比很多只能在特定App里工作的语音输入要强大得多。

如何使用它?

开发者可以使用 VoiceGecko 来提高工作效率。在你写代码、写文档、回复邮件或参与项目讨论时,可以直接对着电脑说话,VoiceGecko 就会自动将你的语音转换成文字并输入到你正在使用的 IDE、文本编辑器、聊天工具或浏览器中。这可以大大减少手动打字的次数,让你更专注于思考和表达。你可以将其视为一个“听写助手”,它可以在任何需要输入文字的场景下为你服务,非常适合需要大量文字输入的开发者。

产品核心功能

· 系统级全局语音输入:能够识别你的语音并将其转换为文字,然后输入到电脑上的任何应用程序的输入框内,解决了在不同软件间切换时语音输入中断的问题,让你可以在任何地方“开口说话,即时输入”,显著提高输入效率。

· 跨应用文本集成:创新性地将语音识别结果无缝地集成到操作系统层面,无需复制粘贴,直接在目标应用中实现文本输入,确保了流畅的使用体验,让你在写代码、写邮件、做笔记时都能享受即时反馈。

· 高效快捷的输入方式:将口头表达直接转化为书写的文字,避免了大量敲击键盘的繁琐操作,尤其是在处理长篇内容或需要快速响应的场景下,能够大幅节省时间和精力,让你将更多注意力集中在内容本身。

产品使用案例

· 在编写长篇技术文档时,开发者可以通过 VoiceGecko 直接口述内容,省去了逐字输入的麻烦,快速将想法变成文字,极大提高了文档撰写效率,让你专注于内容的逻辑和表达。

· 当开发者在 IDE 中需要快速输入注释、提交信息(commit message)或者进行代码相关的笔记时,可以直接对着电脑说话,VoiceGecko 会准确地将语音转化为文本并输入到相应的位置,无需中断编程流程,保持了开发节奏。

· 在进行远程协作和沟通时,例如在团队聊天工具中回复信息或者在视频会议的聊天窗口中发言,VoiceGecko 可以直接将语音输入到聊天框,让你更方便地参与讨论,无需频繁切换输入法或手动输入,使沟通更加顺畅。

2

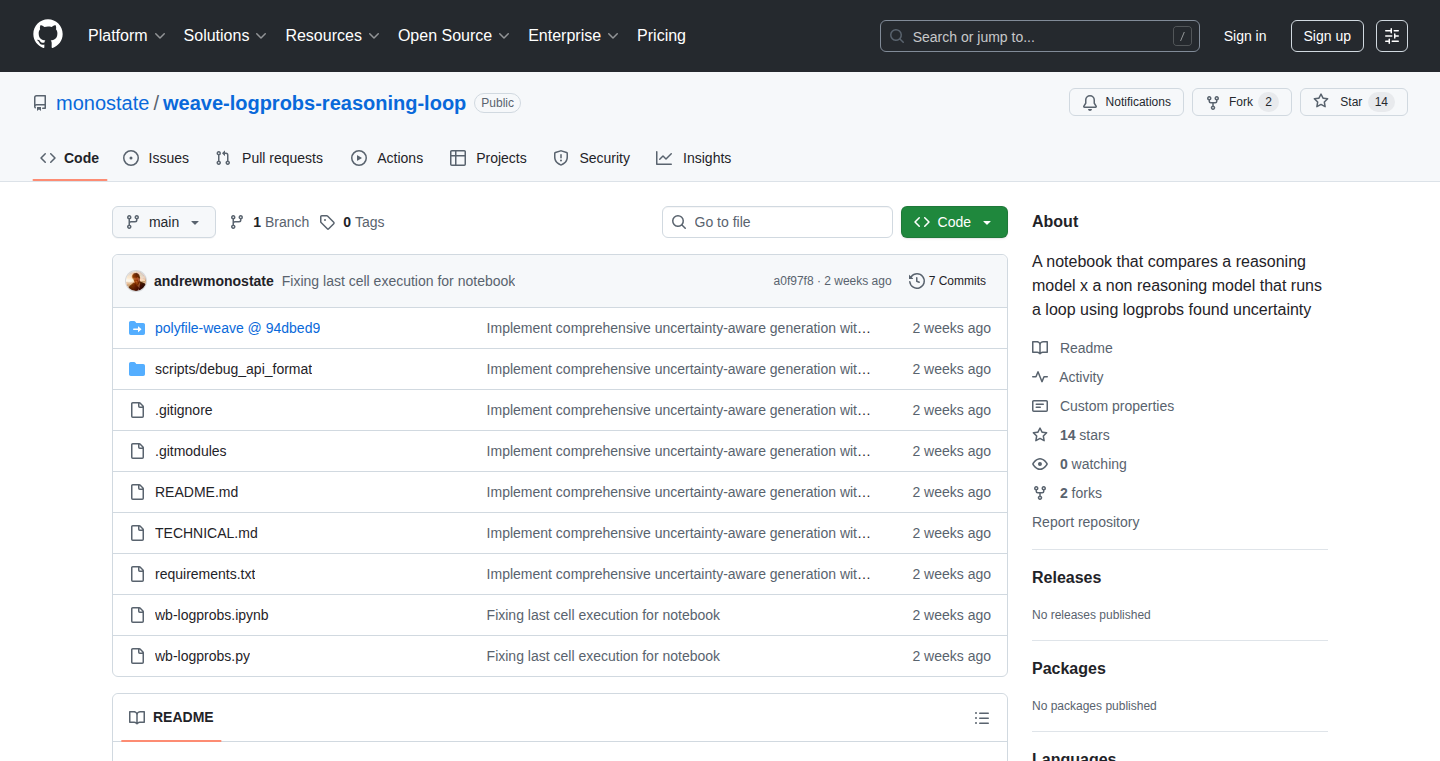

熵能引导推理循环

作者

andrewmonostate

描述

这是一个创新的AI推理技术,它利用了大型语言模型(LLM)在生成每个词时的“不确定性”信号(比如某个词出现的可能性有多大,或者模型在选择下一个词时有多犹豫)。通过捕获这些信号,这个技术可以判断模型在哪些地方可能出错,然后让模型重新思考一下,从而提高回答的准确性和“思考”能力,而无需重新训练模型,大大降低了成本。

人气

点赞 31

评论数 1

这个产品是什么?

这是一个叫做“熵能引导推理循环”的技术,它能够让AI模型在生成文本时,自己发现并修正潜在的错误。通常,AI模型在生成每一个词的时候,都会计算出很多词的可能性,但我们一般只用可能性最大的那个。这个技术却会关注那些模型认为“不太确定”的词,或者模型在选择词时表现得“很纠结”的情况。当它发现这种“不确定”或“纠结”的信号超过某个阈值时,它就会触发一个“再思考”的环节。在这个环节里,模型会收到一些提示,比如它之前考虑过的其他词有哪些,以及它周围的上下文信息,然后它会利用这些信息来优化自己的回答。就好比一个人在写文章时,如果遇到拿不准的地方,会停下来多想一下,甚至查查资料,这样写出来的东西就更靠谱了。这个技术的创新之处在于,它利用了模型自身已有的信息,而不需要额外的训练,而且它能够显著提升小模型的“思考”能力,使其表现接近大模型,同时成本却低很多。

如何使用它?

开发者可以将这个技术集成到他们的AI应用中,尤其是那些需要AI进行复杂推理、回答技术问题、处理数学或代码的场景。具体来说,你需要一个支持输出“词语概率”或“对数概率”(logprobs)的AI模型API(比如OpenAI的一些模型)。然后,你可以用Python来实现这个推理循环。当你的应用调用AI模型获取回答时,这个循环会介入,监控模型生成的每个词的“不确定性”信号。如果信号达到触发条件,循环就会将这些“不确定”的词以及一些备选词和上下文信息喂回给模型,让它重新生成或修正部分回答。你可以通过设置不同的“不确定性”阈值来调整模型“再思考”的频率,以平衡准确性和效率。这个技术可以用在任何需要提升AI回答质量和鲁棒性的地方。

产品核心功能

· 捕获词语概率和上下文:在AI生成文本时,记录下每个词的出现可能性和模型对其他词的偏好,这就像是在分析AI写每个字时的“想法”,为后续的“再思考”提供依据。

· 计算不确定性指标:通过分析词语的概率分布,计算出模型在生成特定词语时的“犹豫程度”或“迷惑程度”,比如困惑度(perplexity)或熵(entropy),这些指标能量化AI的“不确定性”。

· 触发条件判断:设置一个“不确定性阈值”,当AI生成某个词的“不确定性”超过这个阈值时,就触发“再思考”机制,确保模型在真正需要时才进行优化。

· 生成“优化提示”:将那些AI不确定的词,以及模型在选择它们时考虑过的其他选项,还有它们出现的上下文信息,打包成一个“优化提示”发送给模型。

· 模型二次推理:让模型接收这个“优化提示”,并利用这些信息来重新评估和优化它之前的回答,提升最终结果的准确性。

· 实现低成本的“思考”:通过以上步骤,模型能在不进行昂贵重训练的情况下,大幅提升其在复杂任务上的表现,这对于追求性价比的应用来说非常有价值。

· 提供可配置的调优:允许开发者根据具体应用场景调整“不确定性”的触发条件,实现个性化的性能优化。

产品使用案例

· 在一个技术问答系统中,用户问了一个复杂的技术问题。AI模型在回答过程中,对某个关键的技术术语的解释不够确定,这个技术捕获到了这种不确定性,并让模型重新审视了该术语的定义和相关概念,最终提供了更准确、更深入的解释,解决了用户的问题。

· 在处理数学证明题时,AI模型在推理过程中的某一步计算结果存在微小的误差或推导不够严谨,推理循环识别出这一步的“不确定性”很高,于是模型利用了备选的计算路径或更严谨的证明步骤,修正了错误,得出了正确的数学证明。

· 在代码生成场景中,AI模型生成了一段可能有潜在bug的代码片段,推理循环发现了模型在选择某个函数参数时存在不确定性,并提供了模型之前考虑过的其他参数选项,让模型有机会选择一个更健壮、更不容易出错的参数组合,从而生成更可靠的代码。

· 对于需要AI进行创意写作或内容生成的场景,即使AI生成的内容在逻辑上没有明显错误,但如果某些表达不够生动或不够贴切,这个技术也能识别出模型在措辞上的“犹豫”,并鼓励模型尝试更优的表达方式,提升内容的质量和吸引力。

· 在进行成本敏感的AI应用开发时,可以使用这个技术来提升那些性能要求不高但又需要一定“思考”能力的轻量级模型,使其在低成本下也能达到媲美大型模型的中间结果,从而显著降低运营成本。

3

Chibi:AI驱动的用户行为洞察引擎

url

作者

kiranjohns

描述

Chibi是一个利用AI分析用户会话录像,自动识别用户流失、困惑和应用缺陷的工具。它能帮助产品经理和开发者快速找出用户在使用产品过程中遇到的问题,提升用户体验和留存率。

人气

点赞 11

评论数 3

这个产品是什么?

Chibi是一个智能分析工具,它能够“观看”用户在使用你的网站或应用时的操作录像,就像一个超级勤奋的侦探,但它不是用眼睛看,而是用AI(特别是Google的Gemini模型)来理解录像内容。传统上,要了解用户为什么离开或不使用某个功能,你需要手动观看大量录像,非常耗时。Chibi的创新之处在于,它能自动处理这些录像,提炼出关键信息,比如用户在哪里卡住了,哪里让他们感到困惑,或者是什么原因导致他们放弃操作。它就像一个AI助手,能帮你省去大量枯燥的手动分析工作,直接告诉你‘问题出在哪里’。

如何使用它?

开发者可以将Chibi集成到现有的用户会话录像工具中。通常,这些录像是由像rrweb这样的库捕获的用户前端操作数据。Chibi会接收这些录像数据,然后通过其AI模型进行分析。你可以把它想象成一个插件,当用户录像生成后,Chibi会自动接管,输出一份报告。开发者可以通过Chibi提供的API或集成接口,将分析结果展示在自己的产品分析面板中,或者直接发送到团队的通知渠道(如Slack)。例如,当用户提交会话录像后,Chibi可以自动分析并生成一份摘要,指出用户在支付流程中反复尝试点击一个不存在的按钮,并因此流失。

产品核心功能

· AI驱动的会话录像分析:利用AI模型(如Gemini)解读用户操作录像,自动识别用户痛点、困惑点和潜在错误,直接告诉你“用户为什么在这里卡住了”或“用户为什么离开了”。

· 用户流失原因识别:精确找出导致用户放弃操作的关键环节,例如按钮失效、信息不明确或流程复杂,帮助你快速定位并修复导致用户流失的根源。

· 用户行为异常检测:发现用户在使用过程中不寻常的行为模式,如重复点击、长时间无操作或意外退出,这些都能提供关于用户体验不佳的线索。

· 集成便捷性:Chibi通过集成第三方会话录像工具(如rrweb),能够轻松接入现有工作流,让用户录像分析自动化,提高效率。

· actionable Insights(可操作的洞察):Chibi不仅仅是报告问题,它还提供具体的改进建议,让你知道“下一步该怎么做”来提升产品质量。

产品使用案例

· 一位电商平台的产品经理发现某个促销活动的转化率不高。通过Chibi分析用户在浏览促销页面的录像,Chibi发现用户在寻找优惠码输入框时遇到了困难,因为输入框的样式不明显。产品经理据此调整了页面设计,优惠码输入框更加醒目,转化率因此提升。

· 一家SaaS公司的开发者在发现新功能上线后用户满意度下降。Chibi分析了用户使用新功能时的录像,指出用户在完成一个关键设置步骤时,界面提示信息不清晰,导致用户反复尝试失败。开发者根据Chibi的分析,优化了提示信息和引导流程,用户满意度很快恢复。

· 一家游戏公司在测试一款新游戏时,注意到部分玩家在新手引导阶段就放弃了游戏。Chibi分析了这些玩家的录像,发现游戏内的操作提示与实际按键不符,导致玩家困惑。公司根据Chibi的反馈,及时修正了新手引导的操作提示,降低了早期流失率。

4

Tradomate.one: 智能回测的股票筛选器

作者

askyashu

描述

Tradomate.one 是一个创新的股票筛选工具,它将技术分析、价格走势、基本面和新闻情绪融为一体,打造了一个全能型的股票扫描器。它的独特之处在于,不仅仅是筛选,还能通过历史数据回测你的筛选策略,帮助你了解哪些股票在特定条件下表现更佳,从而提供更深入的投资洞察。

人气

点赞 6

评论数 7

这个产品是什么?

Tradomate.one 是一个结合了多种数据源(技术指标、价格行为、公司基本面、新闻情绪)来帮助用户找到符合自己投资标准的股票的工具。它的核心创新在于“回测”功能,这意味着你可以输入一套筛选条件(比如,某股票的某个技术指标必须达到某个值),然后Tradomate.one会去查看过去一段时间内,符合这些条件的股票的表现如何。这就像是在用过去的真实数据来测试你的选股“秘籍”,看看它是否真的有效。所以,它能帮助你验证自己的投资想法,而不是盲目地去猜测。

如何使用它?

开发者可以将Tradomate.one作为一个独立的Web应用来使用,用于研究和发现潜在的投资机会。你可以通过Web界面设定各种复杂的筛选规则,例如:'寻找市盈率低于20,但最近一周股价上涨超过5%且近期有正面新闻报道的科技股'。一旦筛选出符合条件的股票池,你就可以直接在Tradomate.one中选择这些股票,并执行历史回测,查看在过去一段时间(比如一年)内,这个股票池的平均收益率是多少。此外,如果你是开发者,可以考虑如何将Tradomate.one的筛选逻辑API化,集成到你自己的量化交易系统中,或者用于自动化的投资组合管理。

产品核心功能

· 多维度股票筛选:通过整合技术分析、价格行为、基本面和新闻情绪,为你提供全方位的股票筛选能力,让你能更精准地找到符合你投资理念的股票。

· 历史数据回测:允许你测试自己设定的筛选条件在过去市场中的表现,通过真实的历史数据验证你的选股策略的有效性,从而做出更明智的投资决策。

· 策略性能洞察:提供回测结果分析,让你了解不同筛选条件组合下的股票表现,帮助你优化投资策略,发现真正有价值的交易模式。

· 整合分析平台:将多种投资分析方法统一在一个平台,省去了在不同工具之间切换的麻烦,提高投资研究的效率。

产品使用案例

· 一位对技术分析情有独钟的开发者,想验证“MACD金叉”信号在过去一年中是否能带来超额收益。他可以在Tradomate.one中设置MACD金叉的筛选条件,然后运行一年的回测,看看符合条件的股票平均涨幅是多少。如果结果不错,他就可以考虑将此作为其量化交易策略的一部分。

· 一位关注基本面的投资者,想寻找“低市盈率高增长”的股票。他可以在Tradomate.one中设置市盈率低于15,并且过去两个季度净利润增长率超过20%的条件,然后回测这些股票在过去三个月的表现,以评估其短期投资潜力。

· 一位交易者希望利用新闻情绪来辅助交易。他可以在Tradomate.one中筛选出“近期有正面技术突破新闻”的股票,然后回测这些股票在新闻发布后的短期价格走势,看是否有可预测的模式,从而在新闻出现时快速做出交易反应。

5

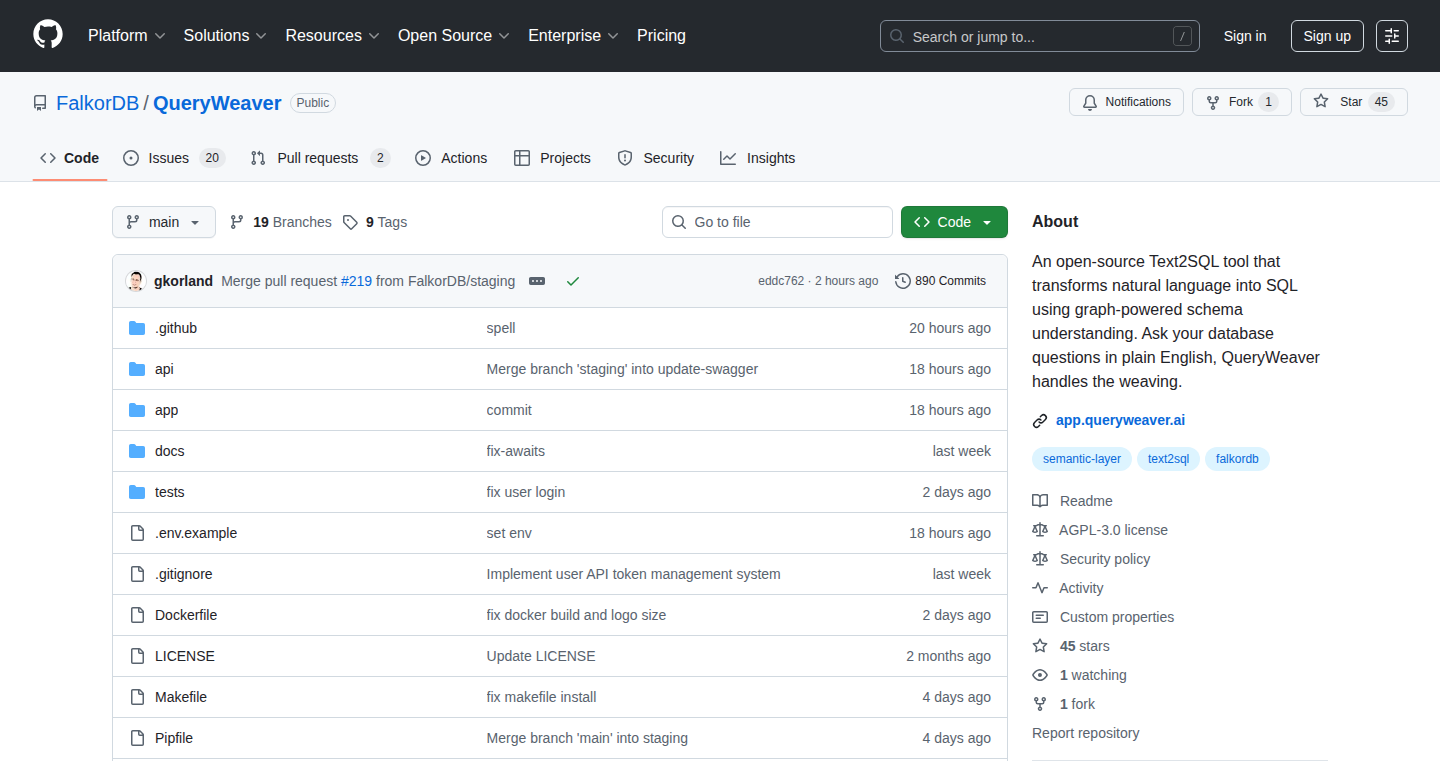

GraphQL2SQL

作者

danshalev7

描述

一个使用图数据库构建的文本转SQL工具,它为你的现有数据库创建一个“语义层”。这意味着你不再需要写复杂的SQL语句,只需用自然语言提问,比如“展示在过去X时间段内在Y区域购买过Z产品的客户”,工具就能理解你的意图,知道需要连接哪些表,并生成相应的SQL。它还能记住对话的上下文,让你进行追问,比如“只显示欧洲的那些客户”,工具也能准确理解。

人气

点赞 7

评论数 2

这个产品是什么?

这是一个让你用说话的方式就能查询数据库的工具。传统上,你需要懂SQL语言才能从数据库里捞取数据,而且如果数据结构复杂,写SQL会非常困难。GraphQL2SQL的创新之处在于它不直接把数据库表格的结构喂给AI模型,而是把这些表格之间的关系,比如“客户”如何与“订单”关联,“产品”属于哪个“活动”,以及“活跃用户”在你的业务中具体代表什么,这些信息用一种叫做“图数据库”的技术来表示。你可以想象成给数据库画了一张关系图,AI看了这张图就能更聪明地理解你的问题,并生成正确的SQL查询。这个工具使用FalkorDB来处理这些关系,并利用Graphiti来跟踪你的提问历史,让后续的追问更加顺畅。重要的是,它不会迁移你的数据,只读取你现有的数据库,生成的SQL也是标准化的,可以在任何地方运行。

如何使用它?

开发者可以通过创建一个API密钥来快速体验GraphQL2SQL。在使用时,你不需要将原始数据转移到这个工具中,它会直接连接到你现有的数据库,读取其结构信息。你可以通过自然语言向它提问,它会将其翻译成SQL语句并返回给你,或者直接帮你执行查询。这就像给你的数据增加了一个智能的语音助手,让你无需深入了解数据库的底层结构就能获取所需信息。它还可以生成API,方便其他应用程序集成,实现更灵活的数据访问。

产品核心功能

· 自然语言转SQL查询:允许用户用日常语言提问,工具将其翻译成SQL,解决用户不懂SQL的痛点。

· 语义层构建:通过图数据库建立数据间的关系,让AI更准确地理解业务逻辑,提升查询的智能化水平。

· 对话上下文记忆:支持连续提问和追问,用户可以逐步细化查询需求,提高查询效率。

· 标准SQL输出:生成的SQL语句通用性强,可直接在各种数据库环境中运行,减少集成难度。

· 数据不迁移:直接读取现有数据库,不进行数据搬迁,保障数据安全性和部署便捷性。

产品使用案例

· 营销分析:一个营销人员想知道“上个月哪些客户购买了我们的最新产品,并且来自欧洲地区”,GraphQL2SQL能直接根据自然语言生成SQL,找出这些客户,无需写复杂的多表连接和条件过滤SQL。

· 产品迭代:产品经理想了解“哪些用户在过去一周内使用了某个新功能,并且是我们的付费用户”,然后追问“只看那些活跃度高的”,GraphQL2SQL能理解上下文,准确找出这些用户群,为产品优化提供数据支持。

· 数据报表自动化:数据分析师可以将GraphQL2SQL集成到报表生成流程中,通过简单的语言指令自动更新数据报表,节省手动编写SQL的时间。

· 快速原型开发:在开发初期,需要快速验证一些数据需求,开发者可以直接用GraphQL2SQL查询数据库,而无需花费时间构建复杂的查询接口。

6

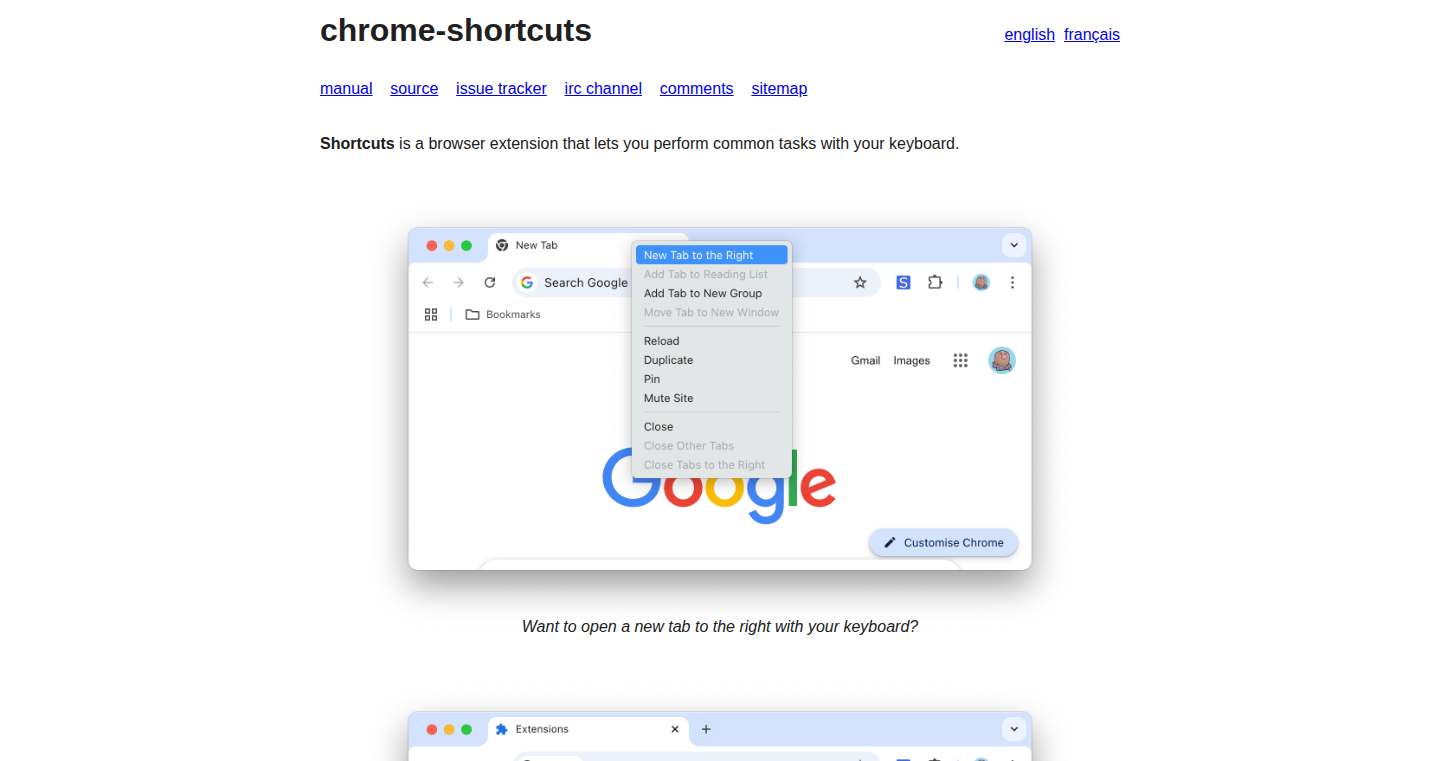

Tail Lens - 实时Tailwind CSS可视化编辑器

作者

jayasurya2006

描述

Tail Lens 是一个创新的浏览器开发者工具,它允许开发者在浏览器中直接实时编辑和预览 Tailwind CSS 类名。它解决了开发者在修改 CSS 样式时频繁在浏览器和代码编辑器之间切换的痛点,通过可视化界面提供即时反馈,极大地提升了前端开发效率。

人气

点赞 7

评论数 1

这个产品是什么?

Tail Lens 是一个基于浏览器的开发者工具,它让你能够在网页运行时,直接用可视化方式修改 Tailwind CSS 的类名,而无需跳转到代码编辑器。它的技术核心在于通过解析 DOM 元素上的 class 属性,并提供一个直观的界面来搜索、选择和应用 Tailwind CSS 的各种工具类。当你改变一个类名时,它会立即在浏览器中为你展示修改后的效果。这就像拥有了一个可以“玩转” CSS 的魔法棒,省去了记住大量类名和反复调试的麻烦。它支持 Tailwind CSS 的 v3 和 v4 版本,这意味着你可以用它来开发最新的 Tailwind 项目。

如何使用它?

开发者可以将 Tail Lens 作为 Chrome 浏览器扩展来安装。安装后,在任何使用 Tailwind CSS 的网站上,只需点击浏览器右上角的 Tail Lens 图标,即可激活该工具。激活后,你可以将鼠标悬停在页面上的任何元素上,Tail Lens 会自动识别该元素应用的 Tailwind CSS 类,并在一个侧边面板中显示出来。你可以直接在这个面板中添加、删除或修改类名,或者利用它的搜索功能来查找并应用新的类。修改后,页面会实时更新,让你立刻看到效果,并且可以将最终的类名复制到你的代码编辑器中,非常方便。

产品核心功能

· 实时类名可视化编辑:直接在浏览器中修改元素的 Tailwind CSS 类名,并即时看到页面变化。这能让你快速尝试不同的样式组合,无需反复刷新页面或切换编辑器。

· DOM导航与类名识别:可以轻松地在页面的 DOM 结构中进行导航,并准确地识别出当前元素应用的 Tailwind CSS 类。这对于理解复杂元素的样式来源非常有帮助。

· 类名智能建议:在编辑类名时,提供相关的 Tailwind CSS 类名建议,帮助你快速找到所需的样式。这能够弥补开发者对所有类名不熟悉的不足,加速开发过程。

· 样式预览与复制:所有修改的类名都会在浏览器中实时预览,满意后可以直接一键复制,方便粘贴到你的代码编辑器中。这大大缩短了从构思到实现的时间。

· 兼容v3和v4版本:支持最新版的 Tailwind CSS,确保你的开发工具与时俱进,能够处理最新的 CSS 功能。

产品使用案例

· 场景:一个前端开发者正在使用 Tailwind CSS 构建一个响应式布局的网站。

问题:他想快速调整某个区域的边距和对齐方式,但记不清具体的 Tailwind 类名,来回查找文档并修改 CSS 非常耗时。

解决:使用 Tail Lens,他可以直接点击该区域,在工具中搜索 'margin' 或 'justify',选择合适的类名(如 `m-4`,`justify-center`),页面立刻更新,并能直接复制最终的类名到组件代码中,将原本可能需要几分钟的调试时间缩短到几十秒。

· 场景:UI设计师和前端开发者协作,需要精确地调整页面元素的间距和颜色。

问题:设计师在浏览器中看到了理想的效果,但难以用文字准确描述给开发者,或者开发者需要多次尝试才能复现设计师的要求。

解决:使用 Tail Lens,开发者可以直接在设计师提供的原型页面上,通过可视化界面尝试不同的间距类(如 `p-2`, `p-4`)和颜色类(如 `bg-blue-500`, `text-white`),直到达到设计师满意为止,然后将最终的类名直接复制给设计师确认或整合到最终代码中,沟通效率大大提升。

· 场景:开发者在开发一个复杂的组件,需要尝试多种不同的背景、边框和阴影组合。

问题:在代码编辑器中频繁修改类名,然后手动在浏览器中检查效果,效率低下。

解决:Tail Lens 允许开发者在浏览器中直接选择和修改这些类名,例如 `bg-gradient-to-r from-purple-400 to-blue-500`,并实时看到渐变效果。这样可以极大地加快视觉调试和样式迭代的速度,尤其是对于复杂的组合样式。

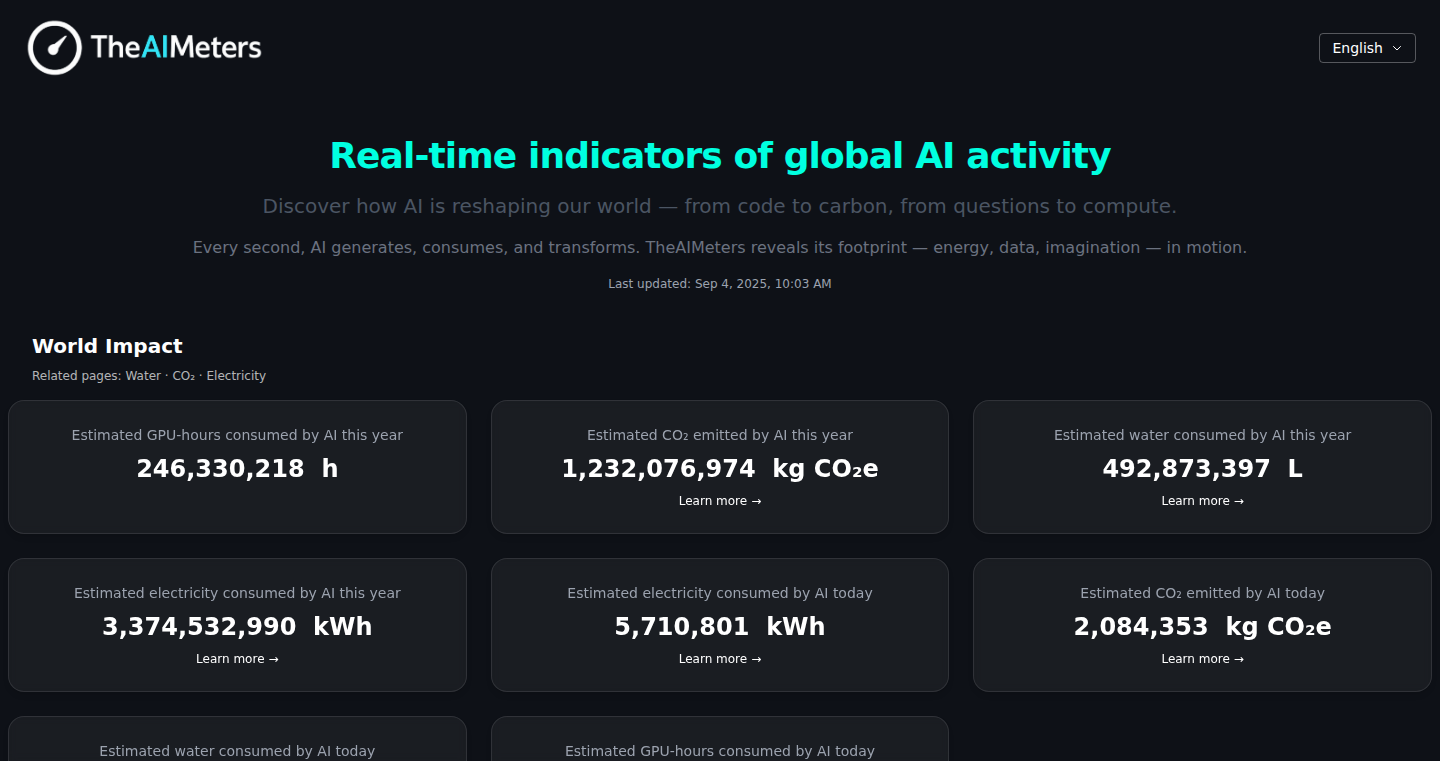

7

AI能耗追踪器

作者

rboug

描述

这是一个实时追踪全球人工智能活动对环境影响的项目,通过汇总公开数据、研究和电网因素,精确估算AI运行所消耗的电力、水资源、产生的二氧化碳当量以及GPU计算小时数。它让人们能够量化AI技术在光鲜外表下的真实环境成本,帮助理解并驱动更负责任的技术发展。

人气

点赞 2

评论数 6

这个产品是什么?

AI能耗追踪器是一个利用公开信息和专业研究,将人工智能计算过程中的资源消耗(如电力、水、碳排放)可视化为具体数字的项目。它的核心技术在于收集来自AI运营方披露的信息、学术界的研究报告,并结合不同地区的电网特性(比如是清洁能源还是化石能源发电),从而计算出AI运行时最真实的能耗和环境影响。比如,当你看到AI生成一张图片,这个追踪器就能告诉你这个过程大概消耗了多少电,相当于多少碳排放。这是一种“打破砂锅问到底”的精神,用数据说话,揭示AI技术背后的隐藏成本。它的创新之处在于将抽象的AI运算转化为具体的、可感知的影响,提供了一个量化的视角来审视AI的广泛应用。

如何使用它?

对于开发者来说,AI能耗追踪器提供了一个了解其开发和部署的AI模型对环境影响的新维度。你可以在开发过程中,预估不同AI模型的能耗,从而选择更节能的算法或优化部署策略。例如,在选择云服务提供商时,可以参考其能源来源的清洁度来评估AI项目的碳足迹。它还可以作为教育工具,向团队成员或公众展示AI技术发展的环境代价。集成方面,它可能通过API的形式提供实时数据,开发者可以将其集成到自己的应用中,为AI的使用提供一个“能耗仪表盘”,或者用于报告和研究。

产品核心功能

· 实时AI活动数据汇总:收集全球AI运营方披露的能耗、水耗、碳排放等数据,并结合研究报告,实现对AI活动的全方位追踪,帮助你了解AI的真实规模和消耗。

· 多维度环境影响估算:不仅追踪电力消耗,还精确计算水资源消耗、二氧化碳当量排放以及GPU计算小时数,提供AI影响的全面视图,让你知道AI从各个方面对地球做了什么。

· 区域电网因素整合:考虑不同地区的电力结构(清洁能源比例),对AI产生的碳排放进行更准确的评估,这意味着同一个AI计算在不同地方运行时,其碳排放量也会不同,更加贴近现实。

· 数据可视化与趋势分析:将复杂的能耗数据以直观的方式呈现,方便理解和分析AI发展趋势对环境的长期影响,让你能够看到AI进步的同时,其资源消耗的变化。

· 公开数据与研究整合:依赖运营商披露信息和学术研究,确保数据的来源可靠性和分析的严谨性,为AI能耗研究提供有力的基础数据支撑。

产品使用案例

· 一个AI内容生成平台开发者,在进行模型训练时,发现某个新模型比旧模型消耗更多的GPU时间。通过AI能耗追踪器,他发现这个新模型虽然效果更好,但其能耗和碳排放量也显著增加,于是他优化了训练算法,并在不牺牲太多效果的情况下,将能耗降低了15%,显著减少了项目的环境足迹。

· 一位研究AI伦理的学者,需要量化不同大型语言模型(LLM)在一次问答中所消耗的能量。他使用AI能耗追踪器的数据,为不同LLM提供了一个统一的能耗基准,从而比较它们的能源效率,并发表了关于AI模型能耗公平性的重要研究报告。

· 一家云服务提供商,为了向客户展示其绿色计算能力,将AI能耗追踪器的API集成到其管理面板中。客户在使用其GPU实例进行AI训练时,可以直观地看到每个任务的能耗和碳排放量,以及这些排放量在整体AI活动中的占比,从而增强了客户对绿色计算的信任和使用意愿。

· 一个科技博主,在撰写关于AI最新进展的文章时,引用了AI能耗追踪器的数据来描述AI技术快速发展背后隐藏的环境成本,向广大读者揭示了AI的“隐形账单”,引发了公众对AI技术可持续发展的讨论。

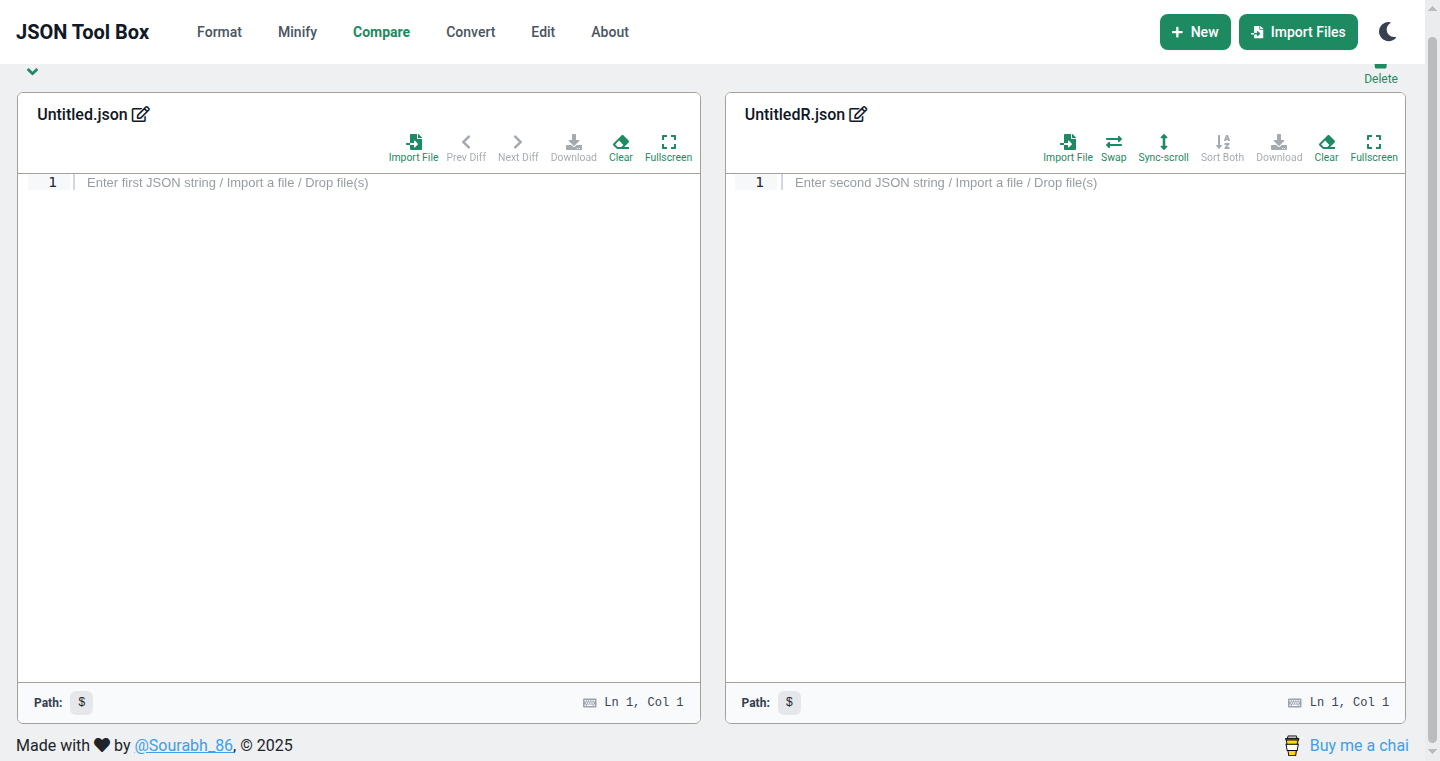

8

JSONDiffMate

作者

sourabh86

描述

JSONDiffMate 是一款专为开发者设计的,能在浏览器中实时进行 JSON 数据比对的工具。它解决了市面上许多 JSON 对比工具不够精准、功能不足的问题,能够动态显示 JSON 路径,支持多种输入方式,并提供灵活的对比选项,让开发者更高效地找出 JSON 数据的差异。

人气

点赞 3

评论数 4

这个产品是什么?

JSONDiffMate 是一个完全在浏览器中运行的 JSON 数据比对工具。它的核心创新在于提供实时的、精确的 JSON 结构比对。当你输入或拖拽两个 JSON 文件进行比对时,它不仅能清晰地展示出两份 JSON 之间的不同之处,还能在你浏览 JSON 的过程中,动态地高亮显示当前正在查看的数据在 JSON 结构中的具体位置(JSON Path)。这意味着你不再需要猜测某个数据点到底在哪里,工具会直接告诉你。此外,它还支持类型化输入、文件导入、拖拽上传,并允许你自定义滚动同步、排序比对、交换文件以及下载单独的 JSON 文件,并且界面支持暗黑/明亮模式,完全无广告。

如何使用它?

开发者可以将 JSONDiffMate 用作独立的应用,通过复制粘贴 JSON 数据、从本地文件导入,或者直接将 JSON 文件拖拽到浏览器中进行快速比对。例如,在进行 API 接口联调时,你可以将服务器返回的 JSON 和预期的 JSON 进行比对,迅速定位错误;在版本控制过程中,可以比对不同版本的配置文件 JSON,找出修改之处;或者在处理复杂数据结构时,使用其动态 JSON Path 功能帮助理解数据。它也可以嵌入到开发工作流中,作为调试或验证 JSON 数据的辅助工具。

产品核心功能

· 实时JSON比对:能够即时显示两个JSON数据的差异,无需手动刷新,让开发者快速定位问题。

· 动态JSON Path指示:在用户浏览JSON数据时,高亮显示当前数据的结构路径,极大地提升了对复杂JSON的理解和导航效率。

· 多种JSON输入方式:支持直接输入、文件导入和拖拽上传,满足不同场景下的数据录入需求,使用灵活便捷。

· 比对选项自定义:允许用户选择是否同步滚动、对JSON进行排序比对,以及交换左右两边的JSON文件,提供了高度的个性化比对体验。

· 完全客户端运行:所有比对逻辑都在用户的浏览器端执行,无需上传数据到服务器,保证了数据隐私和安全性,同时响应速度快。

产品使用案例

· API调试:在开发或测试API时,将API的实际返回JSON与预期的JSON结构进行比对,快速找出字段缺失、类型错误或值不符的问题。

· 配置文件管理:当需要比对不同环境下的配置文件(通常是JSON格式)时,JSONDiffMate可以清晰地展示配置项的差异,帮助定位问题根源。

· 数据迁移验证:在数据迁移或转换过程中,使用JSONDiffMate比对源数据和目标数据的JSON表示,确保数据完整性和准确性。

· 学习和理解复杂JSON:对于初学者或面对大型、嵌套的JSON数据时,动态JSON Path功能可以帮助他们理解数据的层级结构和相互关系。

9

元认知AI发明助手

作者

WiseRob

描述

一个能够自主解决发明问题的AI系统,它能够识别自身的局限,并主动生成子任务来克服这些难题,从而在创新过程中保持“证据接地”和“自我批判”,避免常见的AI“胡说八道”的问题。

人气

点赞 3

评论数 3

这个产品是什么?

这是一个利用“元认知循环”技术构建的AI系统。简单来说,就是AI不仅能生成想法,还能像人一样思考“我被难住了”,然后自己去解决这个“被卡住”的问题。它就像一个聪明的学徒,遇到难题会主动请教或自己学习,直到学会为止,而不是直接放弃或编造答案。这种能力让它在面对复杂、需要创造性思维的发明挑战时,能更稳健、更靠谱。

如何使用它?

开发者可以将这个AI助手集成到他们的研发流程中,用于头脑风暴、原型设计、甚至是攻克技术难题。你可以给它设定一个发明目标,例如“设计一种更节能的电池”,然后让它自主探索,它会尝试不同的方法,如果某个方法行不通,它会反思并尝试新的方向,甚至会生成需要进一步研究或编码的任务来解决遇到的障碍。这就像有一个24/7不休息、且有自我反思能力的研发伙伴。

产品核心功能

· 自主识别问题瓶颈:AI能判断自身在解决发明问题时遇到的核心难点,就像人意识到“这里需要多一点这方面的知识”,从而为接下来的改进指明方向。

· 生成并执行子任务:一旦识别出瓶颈,AI可以自动创建并执行具体的子任务来解决它,比如“搜索最新的材料科学论文”或“模拟某种化学反应”,这使得AI的解决问题能力更具深度和实践性。

· 证据接地与自我批判:AI会基于事实和现有知识来评估自己的想法,并主动纠正潜在的错误或“脑补”的成分,确保输出的可靠性和真实性,这大大降低了AI产生不靠谱解决方案的风险。

· 迭代式创新循环:AI通过不断重复“思考-发现问题-解决问题-再思考”的循环,逐步优化解决方案,实现持续的创新和进步,就像一个螺旋上升的学习过程。

产品使用案例

· 在开发新型传感器时,AI可能遇到材料兼容性问题,它会识别出这是核心障碍,然后主动生成任务去研究特定材料的化学性质或搜索相关文献,直到找到可行的材料组合。

· 在设计一种新算法时,AI如果发现某个数学模型过于复杂难以求解,它会自我反思并生成一个子任务去简化该模型或寻找替代的数学工具,从而推进算法的开发。

· 对于一个需要解决能源效率问题的产品,AI可以模拟不同的设计方案,当发现某一方案存在能量损耗瓶颈时,它会主动探索更高效的能量转换机制或低功耗组件,并提供相关的研究方向。

10

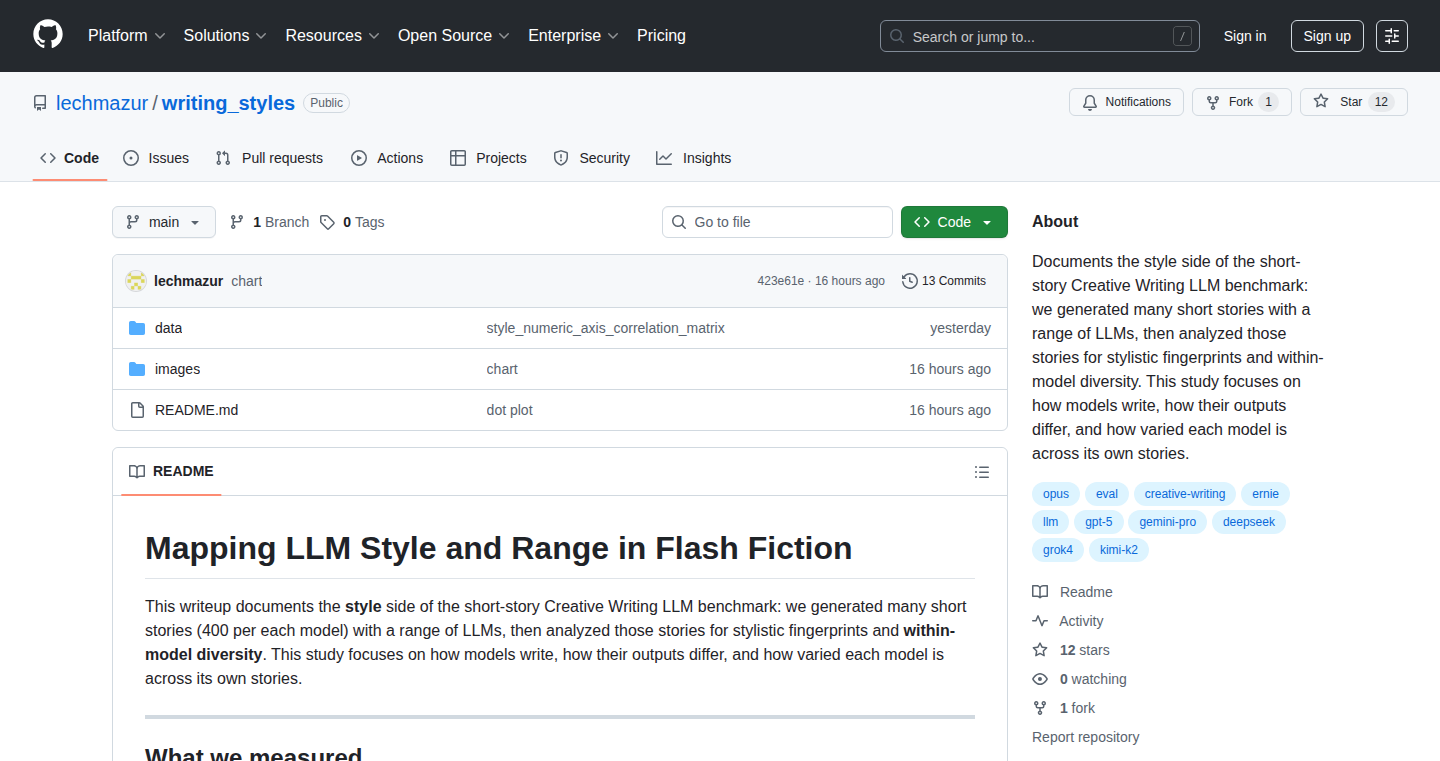

LLM风格探针:闪小说语境下的模型能力可视化

作者

zone411

描述

这个项目是一个名为“LLM Style and Range in Flash Fiction”的Hacker News上的Show HN展示,它巧妙地将大型语言模型(LLM)的风格和能力可视化,并聚焦于闪小说这一特定文学体裁。核心技术创新在于利用代码分析和量化LLM在生成不同风格和语境的闪小说时的表现,帮助开发者理解和调优模型的创造性输出,解决模型在风格一致性和多样性上的挑战。

人气

点赞 6

评论数 0

这个产品是什么?

这是一个利用代码分析技术,可视化大型语言模型(LLM)在创作闪小说时所展现出的风格特点和能力范围的项目。简单来说,它就像一个“显微镜”,能让我们看到LLM在写短故事时,它的“用词偏好”、“句子结构”、“叙事节奏”以及“情感表达”等方面的特点,并且能直观地展示出LLM在不同风格(比如幽默、悬疑、抒情)和不同能力(比如生成情节、刻画人物)上的表现。这种可视化方式,比单纯的文本输出更能帮助开发者理解模型的“脾气”和“潜力”,特别是在追求特定文学风格的AI创作场景下,这能帮助开发者找到更适合的模型或更有效的提示词。

如何使用它?

开发者可以通过集成这个项目到自己的AI写作工具或研究环境中来使用。具体来说,你可以将LLM生成的闪小说文本输入到这个项目的分析模块中,它会输出可视化的图表或报告,展示模型在字数、词汇丰富度、句子长度变化、情感倾向等方面的量化指标,并可能通过聚类或降维技术展示不同生成结果之间的风格距离。这意味着,如果你正在开发一个AI写作者,需要它能生成不同风格的闪小说,你可以用这个工具来评估你的模型在学习新风格时有多成功,或者如何调整提示词以获得更具特色的输出。它就像一个“AI写作教练”,能提供量化的反馈,帮助你的AI更快地掌握写作技巧。

产品核心功能

· LLM生成文本风格量化:通过算法分析,将LLM生成的闪小说文本中的风格特征(如词汇使用、句式结构、情感倾向)转化为可量化的指标,价值在于为模型生成文本提供客观评价依据,帮助开发者理解模型的“写作风格”,从而进行针对性优化。

· 模型能力范围可视化:将LLM在不同写作任务(如情节构建、人物塑造、场景描写)或不同风格(如喜剧、悲剧)上的表现,通过图表或其他可视化方式展现出来,价值在于帮助开发者清晰地看到模型的优势和劣势,明确模型在特定场景下的应用潜力。

· 闪小说语境特异性分析:专注于闪小说这一文学体裁,分析LLM在该语境下的语言特点和叙事模式,价值在于为需要生成短小精悍、节奏紧凑的AI内容(如社交媒体文案、游戏对话)的开发者提供参考,解决模型在该特定语境下可能出现的“跑题”或“冗长”问题。

· 模型调优辅助:通过对模型生成结果的可视化分析,开发者可以更有效地调整模型参数或提示词(prompt),以达到期望的写作风格和质量,价值在于加速模型研发和优化流程,提高AI内容生成的效率和质量。

产品使用案例

· AI内容创作平台:一个AI写作助手平台,需要为用户提供不同风格的短故事。开发者可以使用“LLM风格探针”来评估新训练的模型在模仿“冷幽默”风格闪小说方面的表现,并通过可视化反馈调整模型,使其生成的笑点更精准。

· 游戏叙事引擎:一款需要AI生成游戏内NPC对话或任务剧情的游戏。开发者可以利用该工具分析LLM在生成“冒险”或“奇幻”风格的闪小说式剧情片段时的能力,确保AI生成的对话具有一致的语境和风格,提升游戏沉浸感。

· 教育科技应用:一个辅助学生学习创意写作的AI工具。开发者可以使用该项目来分析不同LLM在生成“励志”或“科幻”闪小说时的语言特点,并可视化地展示给学生,帮助他们理解不同风格的构成要素,从而更好地进行模仿和创作。

· 研究性AI开发:研究者在探索LLM的创造性输出时,需要深入理解模型的工作机制。通过“LLM风格探针”,研究者可以量化地分析模型在处理不同情感倾向的闪小说输入时的响应差异,为LLM的通用人工智能能力研究提供数据支持。

11

并行流代理:AI递归提速器

作者

etler

描述

这个项目通过一种叫做“流委托”的技术,让AI代理能够并行地生成文本,同时又可以按顺序消费这些文本,完全不会造成输出的阻塞。它能够将庞大的AI提示(prompt)拆解成更小的、可以递归处理的部分,这对于AI进行“元提示”(meta-prompting),也就是让AI学会如何更好地生成提示,非常有帮助,极大地提升了AI处理复杂任务的速度和效率。

人气

点赞 4

评论数 2

这个产品是什么?

这是一个能够加速AI处理复杂任务的工具。传统上,AI处理一个非常大的问题时,需要一步一步地完成,就像你写一篇长篇论文,必须先写完第一段才能开始第二段,这样效率很低。这个项目引入了“流委托”的概念,你可以把它想象成一个聪明的调度员。它能把一个大问题分解成很多个小问题,然后让好几个AI“助手”同时去解决这些小问题,并且把它们产生的结果像流水一样快速地传递给下一个环节,即使上一个AI助手还没完全输出结果,下一个助手也能拿到部分结果继续工作,这样整体的处理速度就快了10倍。这种方法特别适合处理那些需要层层递进、不断细化的问题,比如让AI写出更精准、更有逻辑的文案,或者进行复杂的代码生成。

如何使用它?

开发者可以将这个工具集成到他们的AI应用或工作流中。比如,当需要AI生成一篇包含多个复杂章节的长篇文章时,传统方式是让AI从头写到尾。使用这个工具,可以将文章结构分解成多个章节的提示,然后并行地交给不同的AI代理处理。当一个AI代理生成了某个章节的部分内容后,这些内容可以立即被后续的AI代理使用,用于生成下一部分内容或者进行内容优化,而不需要等待整个章节完全生成。这种模式也可以用于AI的“自我学习”,即让AI不断优化自己的提示指令,从而更高效地完成任务。

产品核心功能

· 并行流生成:让多个AI代理同时工作,各自生成一部分内容,就像多个人一起写一份报告,各自负责一个部分,大大缩短了总的写作时间,适用于需要快速产出大量内容的场景。

· 顺序消费:即使AI代理是并行工作的,但它们产生的结果可以被有序地传递给下一个处理环节,确保了信息的连贯性和逻辑性,就像流水线上的工人,每个人做好自己的部分,然后传递给下一个人,产品就能源源不断地出来。

· 递归提示分解:将复杂的AI任务拆解成一系列可以互相嵌套、递归执行的小任务,让AI能够逐步深入地理解和解决问题,就像剥洋葱一样,一层一层地揭示出最终答案,特别适合解决需要深度思考和推理的问题。

· 元提示优化:通过让AI代理处理经过优化的提示,AI能够学习如何更好地生成提示,从而提升自身的能力,这相当于教AI如何学习,让AI变得越来越聪明,适用于需要AI进行自我改进和优化的场景。

产品使用案例

· 在一个AI内容创作平台中,用户可以输入一个大纲,系统利用这个工具将文章分解为引言、主体段落(可按章节拆分)、结论等多个AI任务,并行生成,最后快速组合成一篇完整文章,用户能更快地获得内容。

· 在AI驱动的代码生成场景中,开发者可以给AI一个大型项目需求,工具会将需求分解为模块化组件的生成任务,并行执行,并确保不同模块生成的代码能够无缝集成,开发者可以更快地搭建复杂的软件项目。

· 一个AI研究人员使用该工具来训练一个能够自主优化其研究假设的AI模型,通过将“提出假设-验证假设-修正假设”的过程进行递归拆解和并行加速,加速了研究进程。

· 在AI对话系统中,用户可以进行一个非常深入、多轮次的复杂对话,这个工具能将对话的不同分支和用户反馈并行处理,让AI响应更及时、更连贯,提升了用户体验。

12

TwoTickets: 事件驱动的社交匹配

作者

aammundi

描述

TwoTickets 是一个创新的社交应用,它打破了传统社交模式,将社交的核心放在“事件”上。用户不再依赖于无休止的个人资料滑动,而是通过发布或响应特定活动(如演唱会、体育比赛、戏剧表演等)来寻找志同道合的伙伴。这种“事件优先”的模式,让社交更加自然、高效,以共同的兴趣作为破冰的契机,极大地提升了连接的质量和趣味性。

人气

点赞 3

评论数 3

这个产品是什么?

TwoTickets 是一个基于事件的社交匹配平台,它的核心创新在于将社交活动(events)置于用户个人资料之上。传统的社交应用往往需要用户先建立个人资料,然后通过滑动或搜索来寻找潜在的连接。TwoTickets 则反其道而行之,用户先发布一个“Twoot”(即发布一个想参加的事件),吸引有相同兴趣的人加入,或者响应别人的“Twoot”。这种方法利用了共同的活动作为天然的社交黏合剂,使得匹配过程不再是枯燥的资料比对,而是围绕具体的、有趣的活动展开,极大地降低了社交的门槛,也让认识新朋友的过程更加自然和有目的性。它的技术实现思路在于构建一个事件发布、事件搜索、意向表达(匹配)和后续沟通的流程,并将事件的实时性和参与度作为社交的驱动力。

如何使用它?

开发者可以通过以下方式使用 TwoTickets:

1. **作为用户:** 下载 TwoTickets 的 iOS 应用,注册账号后,你可以选择发布你想参加的活动,例如“我有一个朋友临时无法参加XX演唱会,想找人一起去”,或者响应其他用户发布的活动。平台会根据你的兴趣和位置,为你匹配可能感兴趣的活动或匹配到有相同活动意向的人。然后,你们可以通过应用内的聊天功能进一步沟通,最终决定一起参加活动。

2. **作为开发者(社区反馈):** 如果你是开发者,并且对这种“事件优先”的社交模式感兴趣,可以研究 TwoTickets 的产品设计和用户体验。他们的目标是让你思考,这种模式是否能够解决当前社交应用中普遍存在的“匹配效率低下”和“社交尴尬”的问题。你可以参考其产品网站和应用,思考如何在自己的项目或社区中引入类似的基于共享体验的社交机制。

产品核心功能

· 发布活动(Twoot):允许用户发布自己想参加的活动,并可以附带简短的描述。这使得寻找同伴的意图非常明确,解决找不到一起参加活动的人的问题。

· 浏览和搜索活动:用户可以浏览其他用户发布的活动,并根据活动类型、时间、地点等进行搜索。这让用户能够发现潜在的社交机会,避免错失感兴趣的活动。

· 活动匹配:当用户的“Twoot”与另一个用户的意向匹配时(例如,都想去看同一场演唱会),系统会进行提示。这是核心的匹配机制,其价值在于将社交焦点从个人资料转移到共同的活动体验上。

· 内置聊天功能:提供安全的即时通讯工具,让匹配成功的用户可以进一步沟通活动细节,建立联系。这解决了匹配后如何有效沟通,进而转化为实际社交行为的痛点。

· 无个人资料可见性限制:在发起匹配前,用户的个人资料不会被对方看到,这减少了基于第一印象的偏见,强调了活动的重要性。这种设计让社交更加平等和聚焦于共同兴趣。

产品使用案例

· 场景:小明有一个多余的音乐会门票,但他的朋友们都无法同行。

如何解决:小明在 TwoTickets 上发布了一个“Twoot”,说明了他想去参加的音乐会,并附带了多余一张门票的信息。其他同样想参加这场音乐会但找不到伴侣的用户,在 TwoTickets 上看到了小明的“Twoot”,并对他表达了兴趣。两人通过应用内聊天商定好细节后,一起前往音乐会。这个案例展示了 TwoTickets 如何帮助用户解决“一个人去活动的尴尬”和“如何利用多余的票务资源”的问题。

· 场景:小红想去参加一个周末的户外徒步活动,但她不认识可以一起去的朋友。

如何解决:小红在 TwoTickets 上发布了一个关于徒步活动的“Twoot”。其他同样想参加该活动但缺少同伴的用户,在 TwoTickets 上看到了小红的发布,并对她进行了匹配。两人通过聊天确认了装备和集合时间,共同参与了这次徒步。这体现了 TwoTickets 如何通过共同的户外活动,帮助用户认识新朋友,扩大社交圈,解决“想参加活动但没人一起”的社交痛点。

· 场景:在一个新的城市,用户想去体验当地的特色剧院演出,但不知道该和谁一同前往。

如何解决:用户可以在 TwoTickets 上发布一个关于该剧院演出的“Twoot”。可能会有其他同样对该演出感兴趣,并且在新城市寻找社交机会的用户看到并与之匹配。他们通过应用内沟通,一起探索这座城市,并享受演出。这展示了 TwoTickets 如何帮助用户在陌生环境中,通过共享的文化体验建立连接,解决“在新环境中社交孤立”的问题。

13

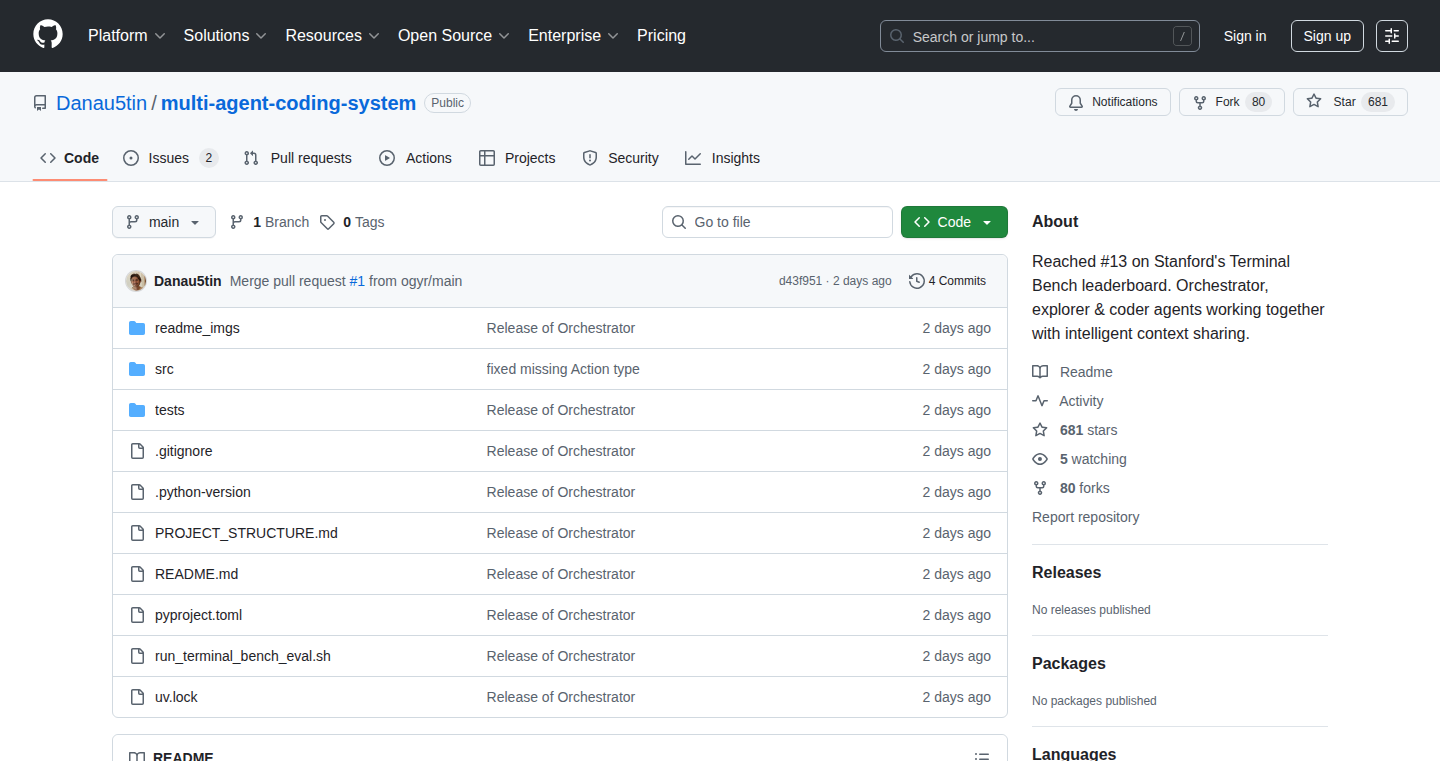

多智能体协同编程引擎

作者

Danau5tin

描述

这是一个由多个AI智能体协作完成编程任务的系统,特别擅长处理基于终端的复杂指令。它通过一个主导智能体(Orchestrator)来调度执行智能体(Explorer)和编码智能体(Coder),利用创新的上下文共享机制,在执行过程中有效地传递信息,实现了惊人的效果,甚至在斯坦福大学的Terminal Bench(终端指令性能测试)中超越了Claude Code。这个项目展示了如何通过模块化和智能协作来提升AI在编程领域的表现。

人气

点赞 4

评论数 1

这个产品是什么?

这是一个利用人工智能(AI)模拟人类开发者团队工作的系统。它包含几个不同的AI角色:一个“总指挥”(Orchestrator),负责理解整体任务和分配工作;一些“探索者”(Explorer),负责在终端环境中尝试不同的命令和解决方案;以及“编码者”(Coder),负责编写实际的代码。这些AI角色之间通过一个“智能上下文共享机制”来交流和传递信息,就像一个真实团队成员之间互相提供背景信息一样。这种协同工作方式,特别是其独特的上下文共享技术,使得系统能够高效地解决复杂的终端操作和编程问题,从而在性能测试中脱颖而出。

如何使用它?

开发者可以通过代码库提供的源码和提示词(prompts)来运行和试验这个系统。你可以将其集成到你的开发工作流程中,让AI智能体来帮助你执行一些重复性或复杂的终端操作,例如自动部署、环境配置、脚本编写等。如果你想让AI帮你完成一个多步骤的终端任务,你可以设定目标,让系统自动分解并执行。它还可以作为一个基础框架,让你通过修改提示词或添加新的智能体来扩展其能力,比如让它尝试不同的编程语言或解决更广泛的技术挑战。

产品核心功能

· 多智能体协同工作:通过将大型任务分解给不同的AI角色(指挥、探索、编码),提高任务处理效率和鲁棒性,这能帮助开发者处理复杂的、需要多步骤思考的编程任务。

· 智能上下文共享:AI角色之间能够有效地传递当前任务的状态、尝试结果和中间发现,就像人与人沟通一样,这确保了信息不会丢失,并且每个AI都能理解整体进展,极大地提高了AI解决问题的连续性和准确性。

· 终端指令执行与分析:系统能够理解并执行复杂的终端命令,并从执行结果中学习,这使得AI能够自主地探索和尝试解决问题,解决了开发者在自动化脚本编写和环境管理中遇到的难题。

· 性能基准测试优化:系统在斯坦福Terminal Bench上表现出色,证明了其在实际终端操作和代码生成方面的强大能力,意味着开发者可以使用更高效的AI工具来辅助开发。

· 开源与可扩展性:项目源码和提示词完全公开,允许开发者自由修改、学习和扩展,这鼓励了社区创新,并提供了定制化AI解决方案的可能性。

产品使用案例

· 在一个复杂的服务器部署场景中,开发者可以设定目标为“部署一个Web应用到生产环境”。多智能体协同编程引擎可以自动识别所需的依赖、执行安装命令、配置服务器、启动服务,并进行基本的健康检查,减少了手动操作的时间和出错的概率。

· 在进行软件开发环境的搭建时,开发者可以要求系统“配置一个Python开发环境,并安装Django和PostgreSQL”。系统会依次执行安装Python、创建虚拟环境、安装库、配置数据库等一系列终端操作,确保环境的正确性和一致性。

· 当开发者需要编写一个复杂的shell脚本来自动化日常任务时,可以向系统描述需求,例如“编写一个脚本,每天定时备份数据库并上传到云存储”。AI智能体可以帮助构思脚本逻辑、生成代码,并测试其功能。

· 在进行性能调优时,开发者可以尝试让AI智能体通过多次终端指令的尝试和反馈,找到执行某个任务的最优命令序列,类似于人类通过试错来优化解决方案的过程。

14

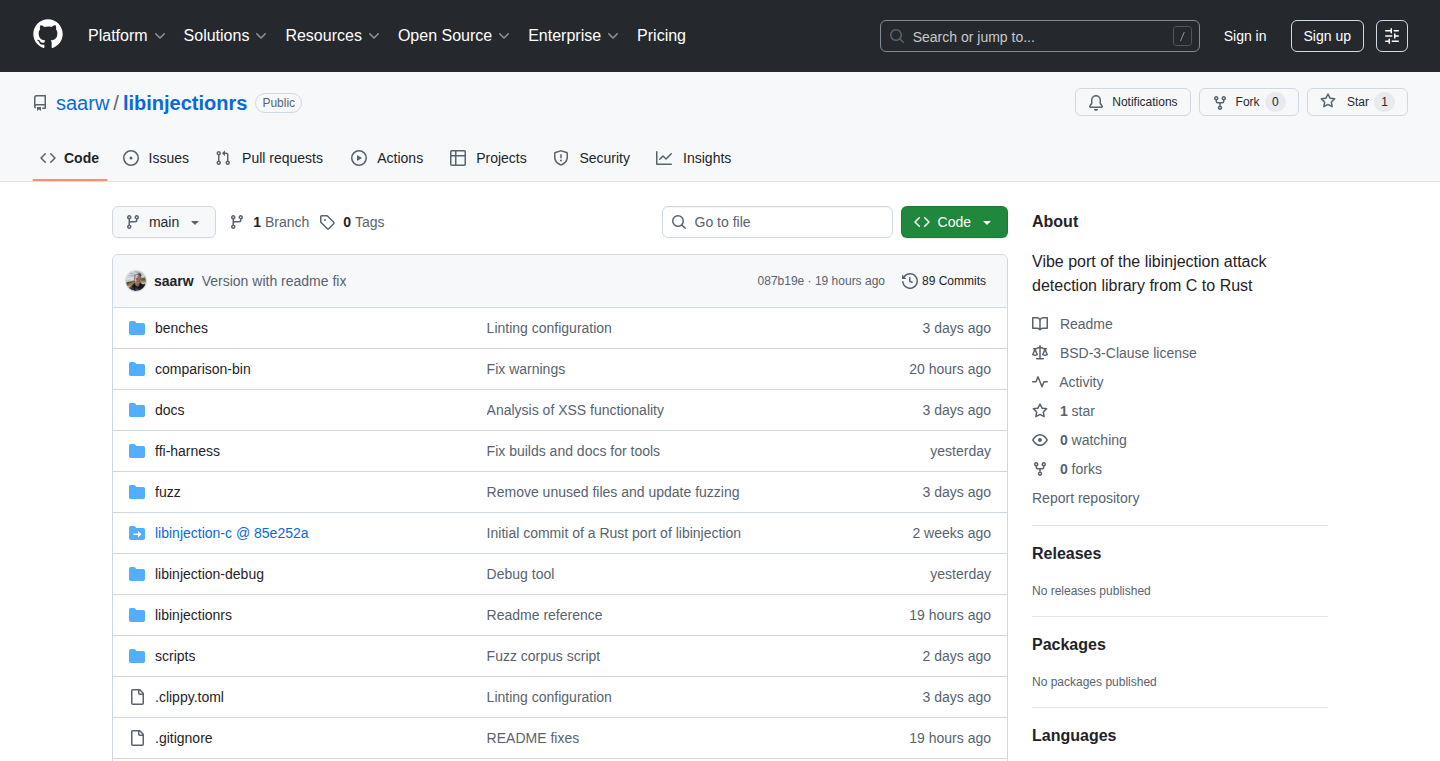

Rust-libinjection: 安全库 C to Rust 跨越

作者

willsaar

描述

这是一个将久经考验的 C 语言安全库 libinjection 移植到 Rust 语言的项目。libinjection 主要用于检测和防止 SQL 注入等安全漏洞,而这次迁移旨在利用 Rust 语言在内存安全和并发性方面的优势,为开发者提供一个更安全、更可靠的安全检测工具。核心创新点在于将 C 语言的底层安全防护逻辑,用 Rust 的内存安全机制重新实现,从而降低了因内存错误引发的安全风险,同时也为 Rust 生态带来了重要的安全组件。

人气

点赞 3

评论数 2

这个产品是什么?

这个项目是一个将 C 语言编写的、用于检测 SQL 注入等安全威胁的库(libinjection),用 Rust 语言重新实现的版本。libinjection 原本在 C 语言环境中广泛使用,但 C 语言容易出现内存错误,可能导致安全漏洞。这个 Rust 版本通过 Rust 强大的内存安全特性(例如所有权系统和借用检查器),在不引入垃圾回收机制的情况下,确保了代码的安全性。这意味着,即使在复杂的安全检测场景下,也能大大降低因程序自身错误导致的安全问题。它就像是给你的应用程序穿上了一件‘不会犯低级错误’的安全外套。

如何使用它?

开发者可以将这个 Rust 库集成到他们的 Rust 项目中,作为后端服务的安全防护层。例如,在一个 Web 框架(如 Actix-web, Rocket)中,可以在接收到用户输入(如数据库查询参数)后,先调用这个 Rust-libinjection 来检测是否存在恶意注入的 SQL 代码。如果检测到可疑内容,就可以在数据库查询执行前阻止它,保护数据库免受攻击。集成方式通常是将其作为依赖添加到项目的 `Cargo.toml` 文件中,然后通过 API 调用其提供的安全检测函数。

产品核心功能

· SQL 注入检测:通过分析用户输入的字符串,识别其中是否包含恶意的 SQL 代码片段,如 `' OR '1'='1`,以阻止数据库被非法操作。这对于保护你的数据库安全至关重要。

· XSS 漏洞检测:同样,它可以识别出可能用于跨站脚本攻击(XSS)的用户输入,防止攻击者在网页中注入恶意脚本。这能保护你的用户免受数据泄露和恶意代码的侵害。

· 可配置的检测规则:允许开发者根据自己的应用场景和安全需求,调整检测的灵敏度和规则,使得安全防护更加精准。你可以精细控制哪些模式会被认为是危险的。

· 高效的性能:Rust 语言本身以高性能著称,这次移植也保留了 libinjection 原有的效率,确保在处理大量请求时不会成为性能瓶颈。这意味着你的应用在安全防护的同时,依然能保持流畅的用户体验。

产品使用案例

· 在 Rust 编写的 Web API 后端,用于验证用户提交的表单数据,防止用户通过提交包含恶意 SQL 语句的数据来窃取或篡改数据库信息。比如,在用户登录时,检查输入的用户名和密码中是否包含 SQL 注入的尝试。

· 集成到 Rust 写的日志分析系统中,过滤掉日志中可能存在的安全注入尝试,确保日志数据的完整性和安全性。当你需要分析攻击日志时,可以快速筛选出真正可疑的攻击模式。

· 作为 Rust 语言编写的数据库访问层(ORM)的一部分,在执行数据库查询前,自动对传入的参数进行安全校验,从而在底层保护所有使用该 ORM 的应用程序。这使得你无需在每个地方手动添加安全检查。

15

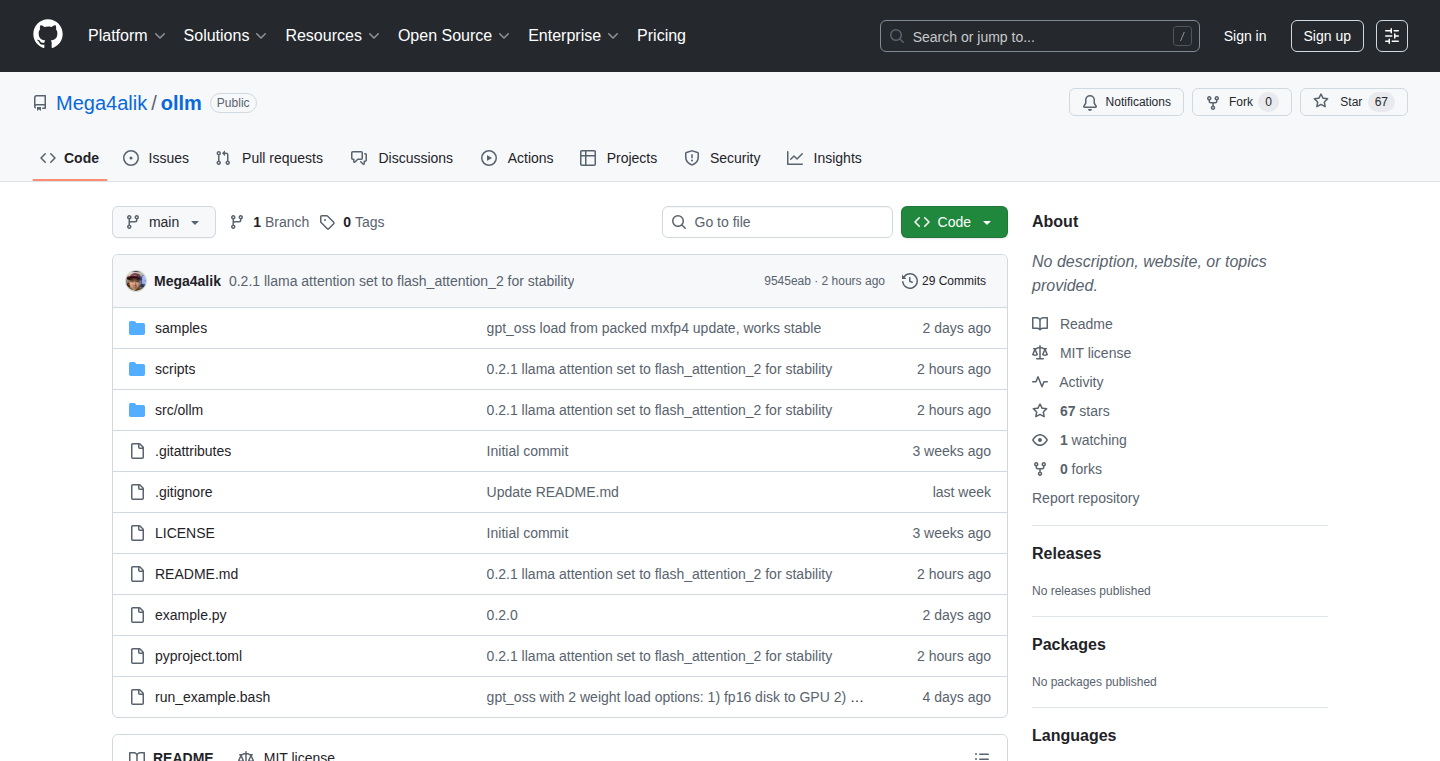

GPU内存优化:让大型模型跑在主流显卡上

作者

anuarsh

描述

这个项目展示了如何通过一系列技术手段,使得一个原本需要大量显存的AI模型(gpt-oss-20b,一个200亿参数的语言模型)能够运行在只有8GB显存的显卡上。其核心在于对AI模型推理过程中的内存占用进行极致优化,从而降低了AI技术的使用门槛,让更多开发者和爱好者能够接触到前沿的大模型技术,解决了“显卡显存不足,无法运行大型AI模型”的痛点。

人气

点赞 5

评论数 0

这个产品是什么?

这是一个技术演示项目,核心在于解决AI大模型运行时对显存的巨大需求。传统上,大型AI模型(如具有数十亿甚至数千亿参数的模型)需要非常昂贵的、显存巨大的显卡才能运行。这个项目通过运用一系列内存优化技术,比如模型量化(将模型权重从高精度表示压缩到低精度)、显存管理策略(例如将模型的部分层或权重暂时从显卡内存移出到CPU内存或硬盘)以及高效的推理引擎,使得原本需要30GB以上显存的模型,能够成功运行在只有8GB显存的主流消费级显卡上。其技术创新在于找到了在不显著损失模型性能的前提下,大幅降低内存占用的方法,将大型AI模型的部署门槛降低了几个数量级。

如何使用它?

对于开发者来说,这个项目提供了一个宝贵的参考和技术实现思路。如果你想在自己的消费级显卡上运行大型AI模型,可以研究并学习项目代码中的内存优化技术。你可以将这些技术集成到你自己的AI应用中,比如:

1. **二次开发现有模型**:当你想在你自己的代码库中集成一个大型语言模型,但显卡显存不足时,可以借鉴项目中的量化和显存管理技术,让模型在你现有的硬件上运行。

2. **构建自己的AI推理服务**:如果你想搭建一个AI服务,但不想投入购买昂贵GPU的成本,可以尝试将项目中的技术应用到你选择的模型上,然后部署到相对低配置的服务器上,降低服务成本。

3. **参与AI模型优化研究**:这个项目也为那些对AI模型效率和内存优化感兴趣的研究者提供了实践案例,可以基于这些技术进一步探索更优化的解决方案。

产品核心功能

· 模型量化(Model Quantization):将AI模型内部的数值从高精度(如32位浮点数)降低到低精度(如8位整数或4位浮点数)。这大大减少了模型存储和计算时占用的内存,价值在于能让模型体积变小,对显存要求降低,使得原本无法运行的模型能在较低配置显卡上运行。

· 显存管理优化(Memory Management Optimization):智能地将模型的一部分参数或计算过程转移到CPU内存或硬盘,需要时再加载回显卡。其价值在于打破了显卡显存容量的物理限制,让运行大型模型成为可能,就像给显卡“扩展了内存”。

· 高效推理引擎(Efficient Inference Engine):使用专门设计的软件来执行AI模型的计算,这些引擎经过优化,能更好地利用GPU资源并减少内存碎片。价值在于能让模型在有限资源下更快地响应,提升用户体验。

· 模型并行或流水线(Model Parallelism or Pipelining):虽然这个项目主要关注单卡优化,但其思想可以延伸到分布式计算,将模型的不同部分放在不同的GPU上计算。其潜在价值在于为需要更强算力的场景提供了扩展思路,可以结合使用以应对更大的模型。

产品使用案例

· 开发者A的个人项目:想在自己的笔记本电脑(配备8GB显存的NVIDIA MX系列显卡)上尝试一个强大的对话AI模型,但直接加载模型总是报错。通过参考这个项目中的量化技术,他成功地将模型加载到显卡上,并能进行基本的对话交互,实现了“我的电脑也能跑大模型”的愿望。

· 小型创业团队的AI原型开发:一个初创团队正在开发一个图片生成应用,目标是让用户通过简单的文本描述生成高质量图片。他们不想一开始就投入大量GPU成本,于是借鉴了项目中的显存优化思路,成功地将一个中等规模的生成模型部署在一个单卡服务器上,完成了产品原型验证,并获得了天使投资。

· AI爱好者学习实践:一位AI爱好者想深入理解大型语言模型的工作原理,但又没有高端GPU。他通过研究这个项目的代码,学习到了模型是如何被“瘦身”并在有限硬件上运行的,这极大地加深了他对AI模型推理和优化的理解,并激发了他未来可能在该领域进行深入研究的兴趣。

16

YAP - 触感旋钮媒体播放器

作者

benwu232

描述

YAP是一个创新的媒体播放器,为Android和iOS设备带来了全新的交互方式。它模拟了物理旋钮的触感操作,用户可以通过滑动手指来直观地调整音量、屏幕亮度以及播放进度。这项技术革新解决了触屏设备在精细调节功能时,操作不直观、容易误触的问题,为用户提供了更流畅、更精准的控制体验。

人气

点赞 4

评论数 1

这个产品是什么?

YAP是一个基于全新“虚拟旋钮”手势的媒体播放器。它的技术核心在于,通过屏幕上的特定滑动操作,模拟出老式音响上那种旋转旋钮的感觉。这种手势能够捕捉用户滑动的方向和速度,并将其转化为对音量、亮度和播放进度的实时、平滑的调整。与传统的点按或滑动滑块相比,这种虚拟旋钮提供了更具物理反馈的直观操作,大大提升了用户在播放媒体时的精细控制能力,尤其是在需要快速、准确地调整参数时,优势尤为明显。

如何使用它?

开发者可以将YAP集成到自己的应用中,为用户提供更具沉浸感和易用性的媒体控制体验。通过调用YAP的API,可以在应用的界面上实现虚拟旋钮功能。例如,在一个视频播放器中,用户可以在屏幕边缘滑动手指来无缝地调节音量大小或画面亮度,或者在屏幕中央区域滑动来精确控制视频的播放进度,无需担心误触到播放、暂停等功能按钮。这种集成方式可以显著提升用户界面的友好度和操作效率,特别是对于需要频繁调整设置的媒体应用。

产品核心功能

· 虚拟旋钮手势识别:精确捕捉用户在屏幕上的滑动轨迹,模拟物理旋钮的旋转和反馈,从而实现直观的参数调节,这对需要精细控制的场景非常有用。

· 多维度参数控制:支持对音量、屏幕亮度、播放进度等多个媒体播放相关的参数进行统一的手势控制,简化了用户操作流程,提升了效率。

· 跨平台支持(Android/iOS):该技术已成功应用于Android和iOS两大主流移动平台,意味着开发者可以将这种创新的交互体验带给更广泛的用户群体。

· 流畅的视觉反馈:当用户进行旋钮操作时,界面会提供即时、流畅的视觉反馈,例如音量条的变化或播放头指针的平滑移动,让用户感知到操作的实时性和准确性。

产品使用案例

· 视频播放应用:用户在观看视频时,可以通过在屏幕左侧滑动来调节音量,在右侧滑动来调节亮度,在屏幕底部区域滑动来拖动进度条,操作直观且不影响观影体验。

· 音乐播放器:在播放音乐时,用户可以通过旋转虚拟旋钮来平滑地切换歌曲或者调整音量,模拟DJ打碟的操控感。

· 播客或有声读物应用:在收听内容时,用户可以通过手势快速调整播放速度或跳转到指定时间点,提高听取效率。

· 游戏内音效或功能调节:开发者可以在游戏中加入虚拟旋钮,用于调节游戏内音量、敏感度等设置,提升游戏的操作感和沉浸感。

17

Paylab MockPSP

作者

d_sai

描述

Paylab MockPSP是一个为开发者打造的模拟支付服务商(PSP)API,让你在不接入真实支付系统(如Stripe, Adyen)的情况下,也能高效地测试支付流程。它能够模拟支付的不同状态,如授权、拒绝、捕获,并支持处理支付相关的Webhook事件。简单来说,它就像一个“支付流程的沙盒”,让开发者可以安全、快速地进行支付功能的开发和调试,最终提升开发效率。

人气

点赞 3

评论数 2

这个产品是什么?

Paylab MockPSP是一个假的支付服务商API,专门用来帮助开发者测试他们的支付相关代码。它模拟了真实支付平台会提供的各种功能,比如创建支付订单(payment intents)、处理支付状态的更新(initiate、authorize、capture、decline等),以及接收和发送支付过程中的通知(webhooks)。这样,开发者就可以在本地或者测试环境中,模拟各种支付场景,而无需承担真实的交易风险或复杂配置。它的创新之处在于提供了一个即插即用的支付测试环境,让开发者能专注于核心业务逻辑,而不是被繁琐的支付对接所困扰。

如何使用它?

开发者可以使用Paylab MockPSP,通过简单的HTTP请求与其API进行交互。首先,你可以在Paylab的在线控制台获取一个API密钥,这个过程不需要注册。然后,你可以像调用真实支付API一样,向Paylab的接口发送请求,例如创建一个支付意图(POST /payment-intents)。Paylab会返回一个模拟的响应,告诉你支付的状态。你也可以模拟收到来自支付渠道的Webhook通知,并在Paylab的控制台中查看历史记录。它非常适合集成到你现有的开发或测试流程中,例如在单元测试、集成测试或者本地开发环境中。

产品核心功能

· 模拟支付意图创建:你可以调用API来创建一个模拟的支付订单,Paylab会返回一个假订单ID和初始状态,这有助于你测试订单管理的逻辑。

· 模拟支付状态流转:Paylab支持多种支付状态(如已发起、授权中、已授权、已拒绝、已捕获等),你可以通过API调用来改变支付状态,这对于测试支付流程中的各种分支和异常情况非常有用。

· 模拟Webhooks通知:Paylab可以向你指定的URL发送模拟的支付事件Webhook,这样你就可以测试你的系统是如何处理支付成功的通知、失败的通知等,而无需实际完成一笔交易。

· API密钥即时获取:无需注册,直接在控制台获取API密钥,让你能够快速开始使用,避免了繁琐的注册流程,符合黑客文化中“快速行动”的精神。

产品使用案例

· 在开发一个电商网站时,你想测试用户下单后的支付流程,但不想在测试阶段就使用真实的信用卡信息。你可以使用Paylab MockPSP来模拟支付成功或失败的场景,确保你的订单状态更新和用户提示信息都正确无误。

· 你在构建一个接收支付通知的微服务,你需要验证你的服务能够正确解析和处理来自支付平台的Webhook消息。使用Paylab MockPSP,你可以模拟不同类型的Webhook事件,并检查你的服务是否能按预期响应,这大大简化了Webhook集成测试。

· 为了训练新加入的开发者学习支付系统的集成,你可以让他们使用Paylab MockPSP来完成一个模拟支付流程的练习,而不用担心消耗真实的支付额度或触发风控策略,这提供了一个安全且低成本的学习环境。

18

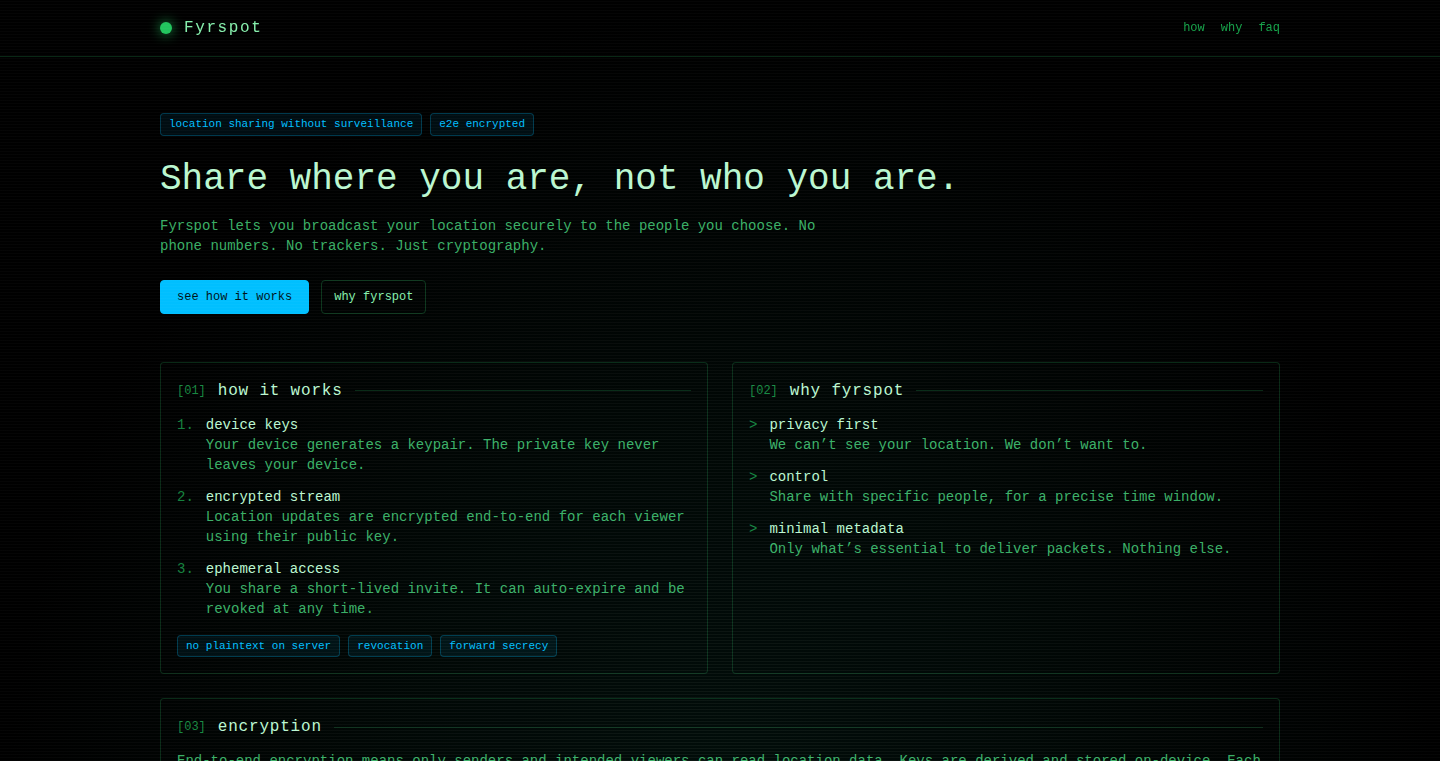

私享定位:隐匿的共享位置服务

作者

ezeoleaf

描述

这是一个用于位置共享的应用程序,它的核心创新在于“无监控”的设计理念。它允许用户在点对点(P2P)或群组中安全地分享实时位置信息,而无需依赖中心化的服务器进行数据存储或追踪,从而极大地保护了用户的隐私,避免了传统位置共享服务可能带来的潜在监控风险。

人气

点赞 3

评论数 1

这个产品是什么?

这是一款主打隐私保护的位置共享应用。与大多数需要将位置数据上传到云端由服务器统一管理的APP不同,它采用了更加“黑客”的方式,即点对点(P2P)的通信模型。这意味着你的位置信息直接在参与分享的用户之间传递,不经过第三方服务器。这种去中心化的设计,可以理解为是你直接把你的位置“告诉”你想分享的人,而不是把你的位置“交给”一个中间商。它的创新点在于,即便是在共享位置信息时,也能最大程度地减少被追踪或监控的可能性,解决了用户对隐私泄露的担忧。

如何使用它?

开发者可以通过集成该应用的SDK(软件开发工具包)到自己的项目中,或者直接使用它作为一个独立的工具。例如,你可以将它嵌入到你的社交APP中,为用户提供一个更私密的群组位置分享功能。对于需要协作的团队,比如在户外活动或进行实地考察时,可以将它作为一个临时的、安全的团队位置共享工具。用户可以通过简单的身份验证(例如,生成一个临时的密钥或邀请码)来加入一个位置分享的会话,并实时查看其他参与者在地图上的位置。

产品核心功能

· 端到端加密的位置数据传输:这意味着你分享的位置信息在传输过程中已经被加密,只有接收方能够解密查看,别人即使截获也无法理解,保证了信息在传递过程中的私密性。

· 点对点(P2P)通信架构:不依赖中心服务器存储位置数据,减少了数据泄露和被滥用的风险,真正实现了“无监控”的分享,用户可以安心共享位置,不必担心被记录或分析。

· 隐私友好的身份验证机制:用户可以通过生成临时的、一次性的链接或代码来邀请他人加入位置分享会话,不需要注册账户,进一步降低了个人信息暴露的可能。

· 实时位置更新与地图展示:能够实时显示参与者的位置,并在地图上清晰地标记出来,方便用户了解彼此的动向,但这个过程依旧是私密且安全的。

· 灵活的会话管理:用户可以随时创建、加入或退出位置分享会话,并能控制谁可以看到自己的位置,提供了高度的自主性。

产品使用案例

· 朋友聚会中的位置分享:当一群朋友计划在某个地点见面时,可以使用该应用进行临时位置分享,大家都能看到彼此的位置,方便汇合,而无需担心位置信息被收集和用于其他目的。

· 家庭成员间的安全追踪:父母可以和孩子在约定时间内分享位置,确保孩子安全到家,或者在紧急情况下快速定位,同时不必担心位置信息被第三方平台贩卖或滥用。

· 户外探险或团队协作:在徒步、露营或进行野外项目时,团队成员可以共享位置,确保大家不会走散,同时又保护了在偏远地区的位置隐私。

· 记者或活动组织者在敏感地区的临时协调:需要进行实地采访或组织大型活动时,可以创建一个临时的、加密的位置共享群组,方便团队成员之间进行快速、安全的沟通和协调,避免暴露敏感信息。

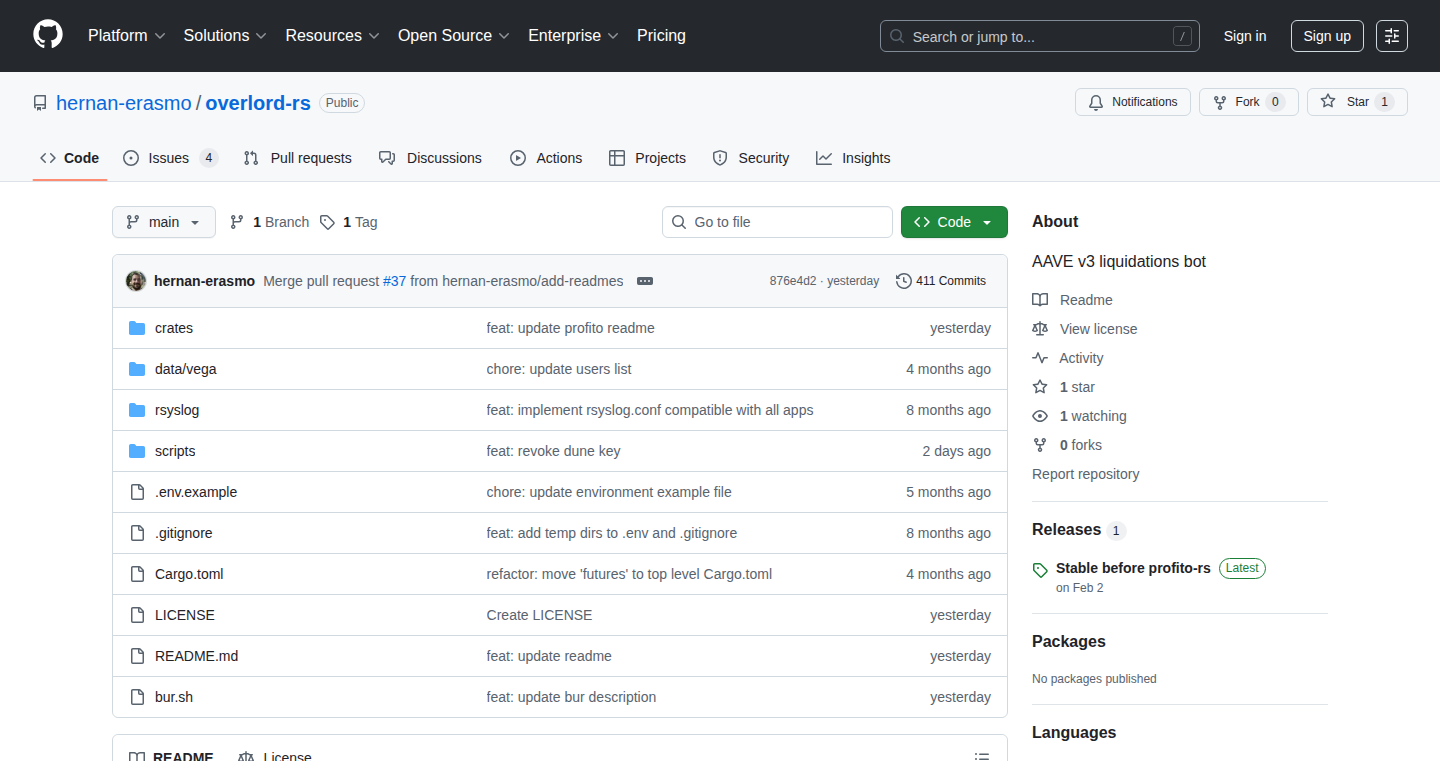

19

瞬时清算信号捕捉器

作者

hernan-erasmo

描述

这是一个专注于DeFi(去中心化金融)领域,特别是AAVE借贷协议的自动化清算机器人。它的核心创新在于极短的反应时间,能在接收到清算信号后2秒内完成从信号捕获到执行清算的整个流程。这对于在波动剧烈的加密货币市场中捕捉套利机会至关重要,尤其是利用那些因为抵押品不足而面临被清算的借款人。

人气

点赞 4

评论数 0

这个产品是什么?

这是一个利用编程技术,在DeFi借贷平台(如AAVE)上,自动监测并执行清算操作的机器人。当借款人的抵押品价值下降到一定程度,不足以覆盖其借款时,DeFi协议就会触发清算。这个机器人通过实时监控链上数据(例如抵押品价值、借款金额、健康度指标等),一旦发现符合清算条件的借款人,就立刻通过智能合约发起清算交易。它的技术亮点在于其极速的响应能力,能够在2秒内完成信号识别、交易打包、签名和广播,这在需要抢先一步的清算操作中具有巨大优势。就好比一个反应敏捷的交易员,能比别人更快地抓住市场机会。

如何使用它?

开发者可以将其作为一个独立的应用程序部署在服务器上,连接到以太坊(或其他兼容的区块链)节点,并配置好与AAVE协议交互的智能合约地址以及自身的钱包信息。通过预设的参数和策略(例如清算门槛、Gas费用偏好等),机器人便能开始自动工作。它也可以作为现有DeFi策略的一部分,集成到更复杂的交易系统中,用来自动执行清算逻辑。可以想象成一个全天候为你监控并执行高收益操作的数字助手。

产品核心功能

· 实时链上数据监控: 持续追踪AAVE协议中用户的抵押品和借款状态,技术上通过监听以太坊的事件或定期查询合约状态来实现,确保及时发现清算机会。

· 极速清算信号识别: 基于预设的风险阈值,快速识别出即将被清算的借款人。这是通过高效的算法和数据处理实现的,能比普通用户更快地捕捉到市场信号。

· 自动化交易执行: 一旦检测到清算信号,机器人会自动构建、签名并广播清算交易到以太坊网络。利用了智能合约交互和交易的打包技术,确保了执行的准确性和速度。

· Gas费用优化策略: 在 Gas 费用高昂的以太坊网络上,机器人能够根据当前的拥堵情况,智能地调整交易的 Gas Price,以平衡交易被打包的速度和成本,这对于抢占先机至关重要。

· 错误处理与日志记录: 能够处理网络延迟、交易失败等异常情况,并记录详细的操作日志,方便开发者进行调试和分析。

产品使用案例

· 在加密货币价格剧烈下跌时,一个借款人抵押了ETH,借了USDC。当ETH价格快速下跌,导致其抵押品价值低于借款金额的清算线时,这个机器人能够捕捉到这一瞬间,并迅速发起清算,从而获得协议奖励(通常是部分被清算的抵押品或协议代币),实现套利。这就好比在市场崩盘时,你能够比别人更快地卖出高价值资产,或者以低价买入。

· 一个DeFi套利者希望自动化其清算策略,以减少手动操作的时间和提高效率。可以将这个机器人集成到其现有的交易平台中,当监测到AAVE上出现高利润的清算机会时,机器人能自主执行,无需人工干预,显著提升了套利收益的获取速度和概率。

· 对于希望学习DeFi底层技术和自动化交易的开发者来说,研究这个机器人可以深入理解智能合约交互、链上数据监听、交易广播机制以及如何在极端市场条件下优化交易执行速度。它提供了一个实际的黑客案例,展示了如何用代码解决在高速变化的市场中抢占先机的难题。

20

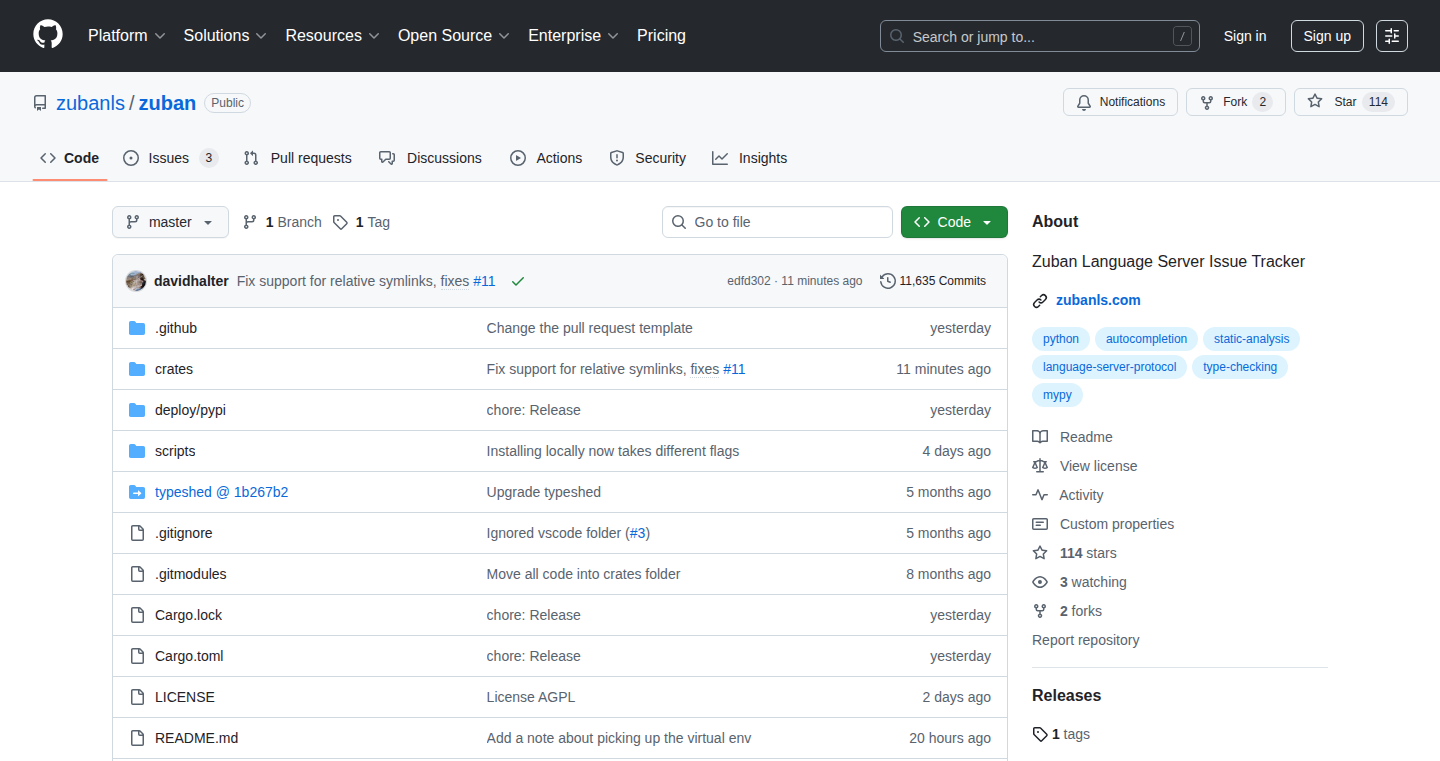

ZubanLS: Rust驱动的Python智能感应引擎

作者

davidhalter

描述

ZubanLS是一个用Rust语言编写的、兼容Mypy的Python语言服务器。它能理解Mypy的配置,并高效地进行Python代码的类型检查和智能提示,极大地提升了Python开发者的编码效率和代码质量。

人气

点赞 4

评论数 0

这个产品是什么?

ZubanLS是一个高性能的Python语言服务器。简单来说,就像你的代码编辑器(如VS Code、Neovim)内置了一个非常聪明的助手,它能实时分析你的Python代码,告诉你哪里可能有错误,并且在你输入代码时提供准确的自动补全和建议。它之所以特别,是因为它使用了Rust这种速度非常快的语言来构建,并且能理解Mypy这个强大的Python静态类型检查工具的规则。这意味着它在识别代码问题和提供建议时,既快又准,尤其擅长处理复杂的类型注解。

如何使用它?

开发者可以将ZubanLS集成到他们常用的代码编辑器中。大多数现代代码编辑器都支持语言服务器协议(LSP),ZubanLS正是遵循这个协议设计的。集成方式通常是:1. 安装ZubanLS。2. 在编辑器的配置中指定ZubanLS的路径,并告诉编辑器使用它来处理Python文件。这样,当你打开Python文件时,编辑器就会自动启动ZubanLS,为你提供实时代码分析、错误提示、自动补全等功能。它还可以读取你的.mypy.ini或pyproject.toml中的Mypy配置,从而根据你的项目设置进行更精细化的检查。

产品核心功能

· 代码实时分析:ZubanLS能够即时分析你的Python代码,找出潜在的语法错误、类型不匹配等问题,帮助你提前发现和修正bug,这为你节省了大量的调试时间。

· 智能代码补全:在你编写代码时,ZubanLS会根据上下文提供准确的函数、变量和方法建议,让你输入更少,效率更高。

· 类型检查兼容:它能理解并应用Mypy的类型检查规则,即使你的项目使用了复杂的类型注解,ZubanLS也能准确识别,并提供更深入的类型相关的提示,这对于大型项目和团队协作尤为重要,能有效防止因类型错误导致的问题。

· 快速性能:使用Rust编写意味着ZubanLS的处理速度非常快,即使在大型代码库中,也能提供流畅的用户体验,不会因为代码分析而拖慢你的编辑速度。

· 配置灵活性:支持读取Mypy的配置文件,可以根据你的项目需求定制代码检查的严格程度和范围,让代码质量控制更符合实际项目要求。

产品使用案例

· 在VS Code中开发一个大型Python Web应用时,ZubanLS能够实时提示Controller层参数类型与Service层方法参数类型是否匹配,避免了因数据传递错误导致的运行时异常,提高了开发效率。

· 使用ZubanLS对一个包含复杂泛型和协议(Protocols)的Python库进行开发,它能准确地理解代码意图,提供精准的方法签名补全,并能在代码中直接显示类型不匹配的警告,减少了代码合并时的冲突和错误。

· 在一个团队协作项目中,开发者A的IDE集成了ZubanLS并配置了严格的Mypy检查。当开发者B提交了不符合类型规范的代码时,ZubanLS会立即在开发者A的代码编辑器中发出警告,确保了代码库的整体质量和一致性,降低了集成和测试的成本。

· 当使用Python进行数据科学研究时,ZubanLS可以帮助检查DataFrame列的预期类型是否与实际操作中的类型一致,例如在进行字符串拼接时,如果列是数值类型,ZubanLS会及时发出警告,防止出现意外的TypeError。

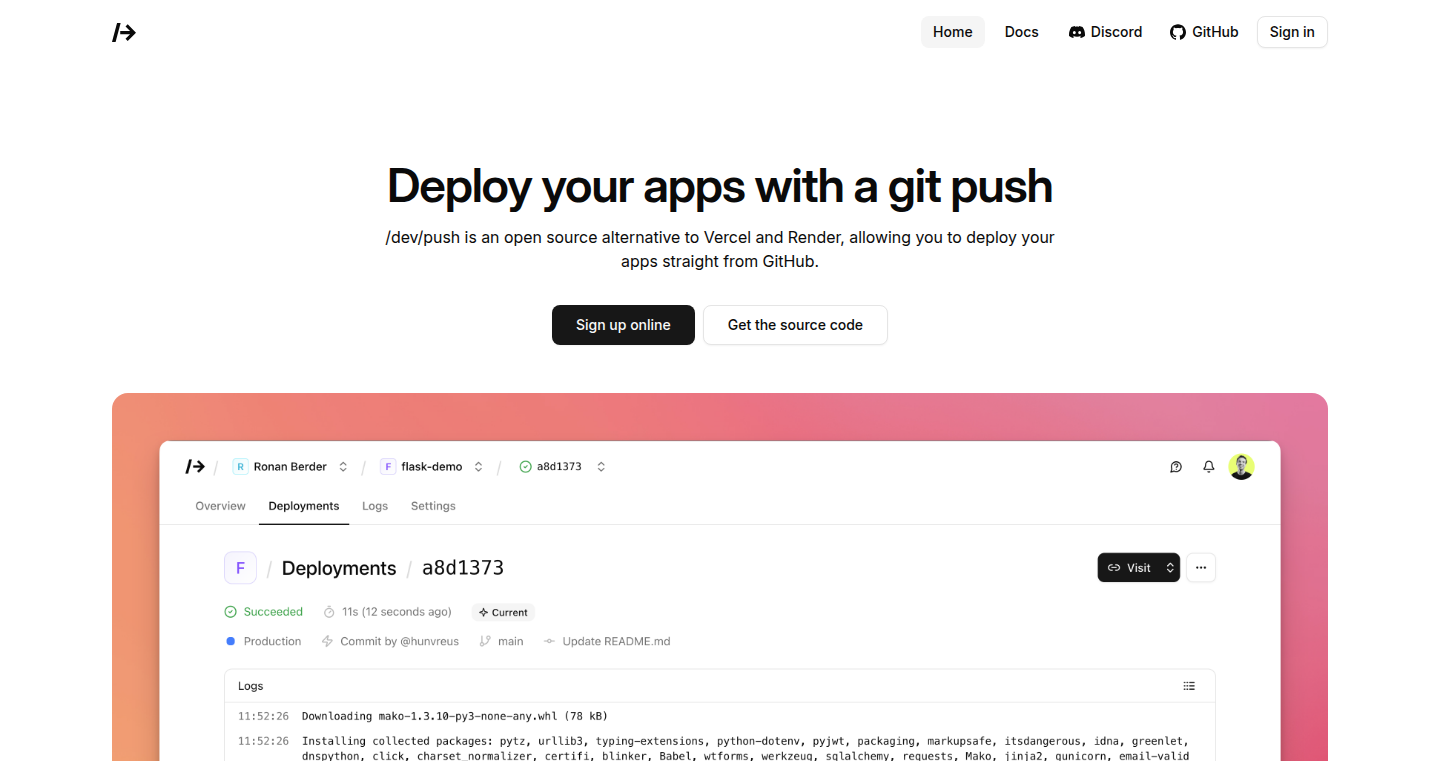

21

DevPush: 你的开源私有云部署平台

url

作者

hunvreus

描述

DevPush是一个开源的、可以自己托管的替代方案,用于取代Vercel、Render、Netlify等流行的网站部署服务。它专注于提供简单高效的Git驱动式部署,支持多种编程语言(如Python、Node.js),具备环境管理、实时监控、团队协作和自定义域名等核心功能。其创新之处在于将企业级的部署能力以开源、自托管的方式提供给开发者,让开发者能够完全掌控自己的部署流程和数据,同时享受零停机部署和快速回滚的便利。对于追求控制权和成本效益的开发者来说,DevPush提供了强大的技术实现基础。

人气

点赞 4

评论数 0

这个产品是什么?

DevPush是一个让你能够自己搭建的、像Vercel或Render一样的网站部署服务。它通过连接你的GitHub代码仓库,当你提交代码更新后,就能自动帮你把网站部署上线,而且还能做到在部署新版本时不中断服务,如果新版本有问题还能快速切换回旧版本。它支持很多种编程语言,只要你的应用能跑在Docker里,它就能支持。你还可以为不同的开发阶段(比如开发、测试、生产)创建不同的环境,并且能安全地管理敏感信息(比如数据库密码)。它还提供实时的日志查看,让你知道部署过程中发生了什么。最大的亮点是它是开源的,你可以把它安装在你自己的服务器上,完全掌控数据和成本。它用FastAPI(一个Python的Web框架)和HTMX(一个能用HTML实现动态交互的技术)构建,这意味着它既有强大的后端能力,又有简洁的前端交互体验。

如何使用它?

开发者可以将DevPush部署在自己的服务器上(比如Hetzner)。然后,在DevPush平台上连接你的GitHub仓库。选择你希望部署的分支(例如,`main`分支部署到生产环境,`develop`分支部署到测试环境)。配置项目的运行环境,比如选择使用的编程语言、安装依赖的命令、以及启动应用的命令。DevPush会自动从GitHub拉取代码,构建并运行你的应用。你可以通过自定义域名访问部署好的应用,DevPush会自动帮你配置SSL证书。如果需要多人协作,可以邀请团队成员,并设置不同的权限。它是为你提供一个可以完全掌控的、自动化的部署流程。

产品核心功能

· Git驱动的自动部署:将你的代码推送到GitHub,DevPush就能自动完成构建和部署,实现零停机更新和一键回滚,让你无需手动操作,轻松实现代码版本管理和快速迭代。

· 多语言支持(基于Docker):它能运行任何可以在Docker容器中执行的应用程序,意味着你可以用Python、Node.js、PHP等多种语言开发的项目都能轻松部署,提供了极高的灵活性。

· 精细的环境管理:你可以为开发、测试、生产等不同环境配置独立的部署,并为每个环境设置不同的代码分支映射,还能安全加密存储环境变量,确保不同环境的配置隔离和数据安全。

· 实时的日志监控:DevPush提供实时、可搜索的构建和运行日志,让你能够清晰地看到部署过程中的每一步,快速定位和解决问题,提升调试效率。

· 团队协作与权限控制:支持邀请团队成员,并根据角色分配不同的访问权限,方便团队协作开发,确保项目安全和管理有序。

· 自定义域名与SSL证书:你可以将自己的域名指向部署好的应用,DevPush会自动配置SSL证书,让你的网站拥有专业的HTTPS访问,增强用户信任感。

· 开源与自托管:作为开源项目,你可以将其部署在自己的服务器上,拥有完全的数据控制权和成本优势,避免了对第三方平台的依赖,适合对隐私和成本敏感的开发者。

产品使用案例

· 一个独立开发者需要快速上线一个Node.js的Web API,并希望保证API在更新时不会中断服务。开发者将API代码托管在GitHub,然后将DevPush部署在自己的VPS上。通过DevPush连接GitHub仓库,配置Node.js运行环境和启动命令。每次代码提交后,DevPush自动完成构建、部署和零停机更新,确保API始终可用,开发者无需操心服务器配置和部署流程。

· 一个小型团队正在开发一个Python的Django项目,需要为不同的功能开发分支设置独立的测试环境。他们使用DevPush,并将`main`分支部署到生产环境,`feature/user-auth`分支映射到测试环境。DevPush能够自动处理每个分支的构建和部署,并为测试环境配置特定的数据库连接字符串(通过加密的环境变量)。这样,团队成员可以独立测试新功能,而不会影响生产环境。

· 一位开发者想要一个比Vercel更具成本效益且可控的解决方案来部署一个静态网站,并希望使用自己的域名。他选择将DevPush部署在一个低成本的VPS上。通过DevPush设置一个简单的部署流程,从GitHub拉取静态文件,并配置自定义域名和自动生成的SSL证书。这样,他就能以极低的成本获得一个可靠的、带HTTPS的网站托管服务,并且完全掌控所有配置。

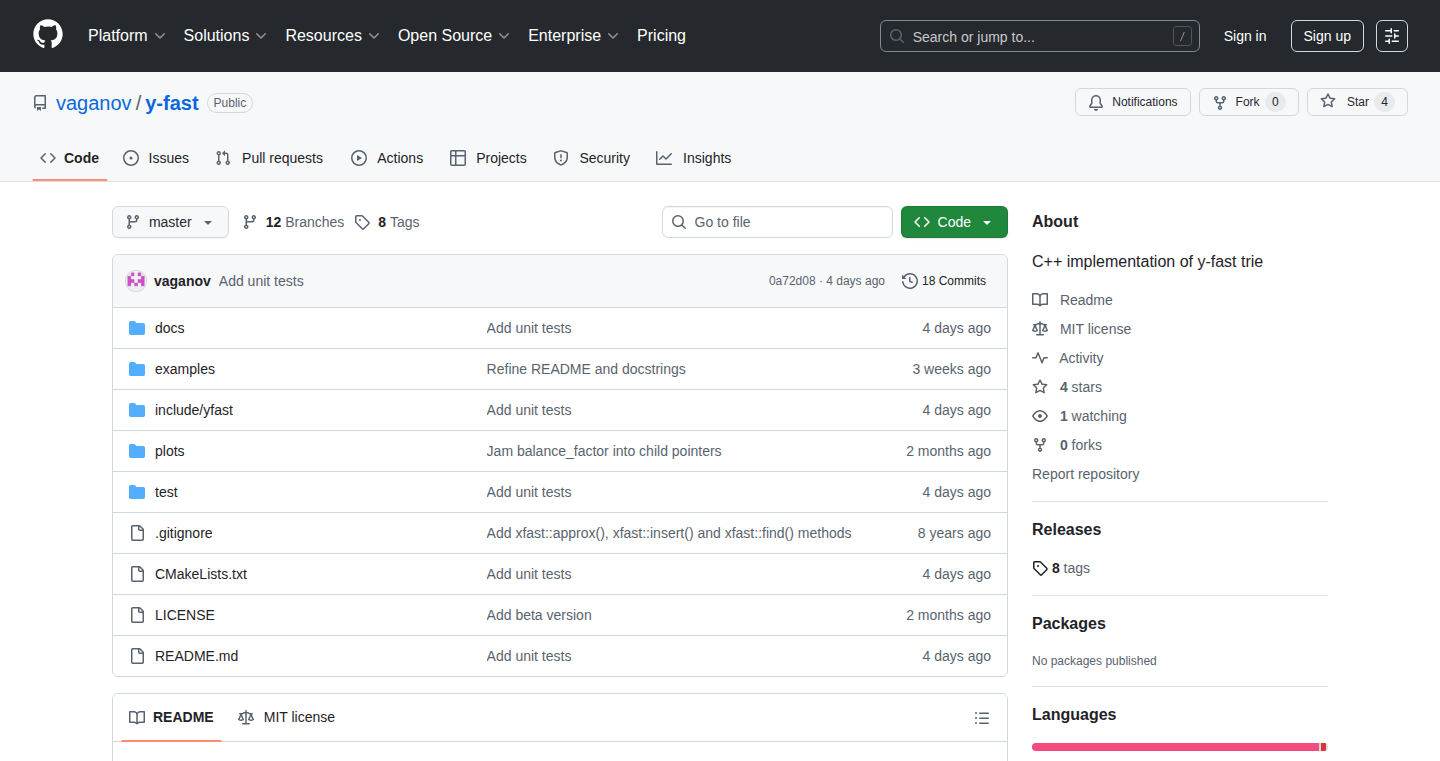

22

Y-Fast Trie: 高速关联容器

作者

kinbote

描述

这是一个用C++实现的、基于y-fast trie数据结构的关联容器。它在存储大量数据时,能够提供比传统二叉搜索树更快的查找、插入和删除速度,尤其是在数据量大到一定程度后,其优势会非常明显。这就像给你的数据查找装上了一个涡轮增压器。

人气

点赞 4

评论数 0

这个产品是什么?

这是一个什么项目?说明技术原理和创新之处,保持一定技术深度。

Y-fast trie是一种非常高效的数据结构,它在内存中存储一系列有序的键值对。它的核心创新在于,通过一种巧妙的索引机制,能够将查找、插入和删除这些操作的平均时间复杂度控制在O(log log M)级别,其中M代表数据的最大可能容量,而不是当前实际有多少数据。简单来说,它像是在一个巨大的有序列表里,通过层层精密的筛选,极快地找到你想要的东西。虽然它内部的计算过程可能比传统的二叉搜索树稍微复杂一些(常数因子大),但当你的数据量变得很大时,它就能展现出惊人的速度优势。想象一下,你有一个超级精确的地址簿,不管里面有多少人,你都能瞬间找到某个特定的人,而不需要一本一本地翻查。

如何使用它?

开发者怎么使用这个项目?给出技术使用场景和集成方式。

开发者可以将这个Y-fast trie容器集成到他们的C++项目中,用它来存储需要快速访问和管理的键值对数据。例如,你可以用它来实现一个高性能的内存数据库索引,一个快速查找DNS记录的系统,或者任何需要高效存储和检索有序数据的场景。它的使用方式会类似于STL中的map或unordered_map,提供insert、find、erase等标准接口,但底层的性能表现会更加优越。你可以直接通过GitHub仓库中的代码来引用和编译,将其作为库文件集成到你的项目中。

产品核心功能

· 高效的有序数据存储: 能够以有序的方式存储键值对,这意味着你可以按顺序遍历数据,这在很多场景下非常有用。

· 极速的查找操作: 无论是查找是否存在某个键,还是获取键对应的值,Y-fast trie都能以O(log log M)的平均时间复杂度完成,比传统的O(log N)(N是数据量)快得多,特别是在处理海量数据时。

· 快速的插入和删除: 新数据的添加和旧数据的移除也同样高效,保持了整体的数据管理速度。

· 内存效率优化: 相比一些其他高速数据结构,Y-fast trie在保证速度的同时,也力求在内存使用上做到比较好的平衡,尤其适合在内存有限但对速度要求极高的环境中。

· C++标准库风格接口: 项目遵循C++的标准库设计,开发者可以轻松上手,就像使用std::map一样,降低了学习成本。

产品使用案例

· 大型在线游戏服务器中的玩家数据管理: 当服务器需要同时处理成千上万在线玩家的信息时,使用Y-fast trie可以极大地提高查找玩家数据、更新积分等操作的速度,保证游戏的流畅性。

· 高性能的网络路由表: 在网络设备中,需要快速查找目的IP地址对应的下一跳路由。Y-fast trie的低延迟查找特性非常适合构建这样高速的路由表。

· 搜索引擎的索引加速: 搜索引擎需要存储和快速检索大量的文档关键词。利用Y-fast trie可以显著提升关键词的查找效率,从而加快搜索响应速度。

· 实时股票交易系统的行情数据存储: 股票交易系统需要高速处理和查询大量的实时价格变动。Y-fast trie可以帮助系统快速地找到特定股票的价格信息,满足毫秒级的交易需求。

· 生物信息学中的基因序列比对: 在处理庞大的基因序列数据库时,需要快速查找和比对特定的DNA片段。Y-fast trie的效率能大幅缩短这些比对过程所需的时间。

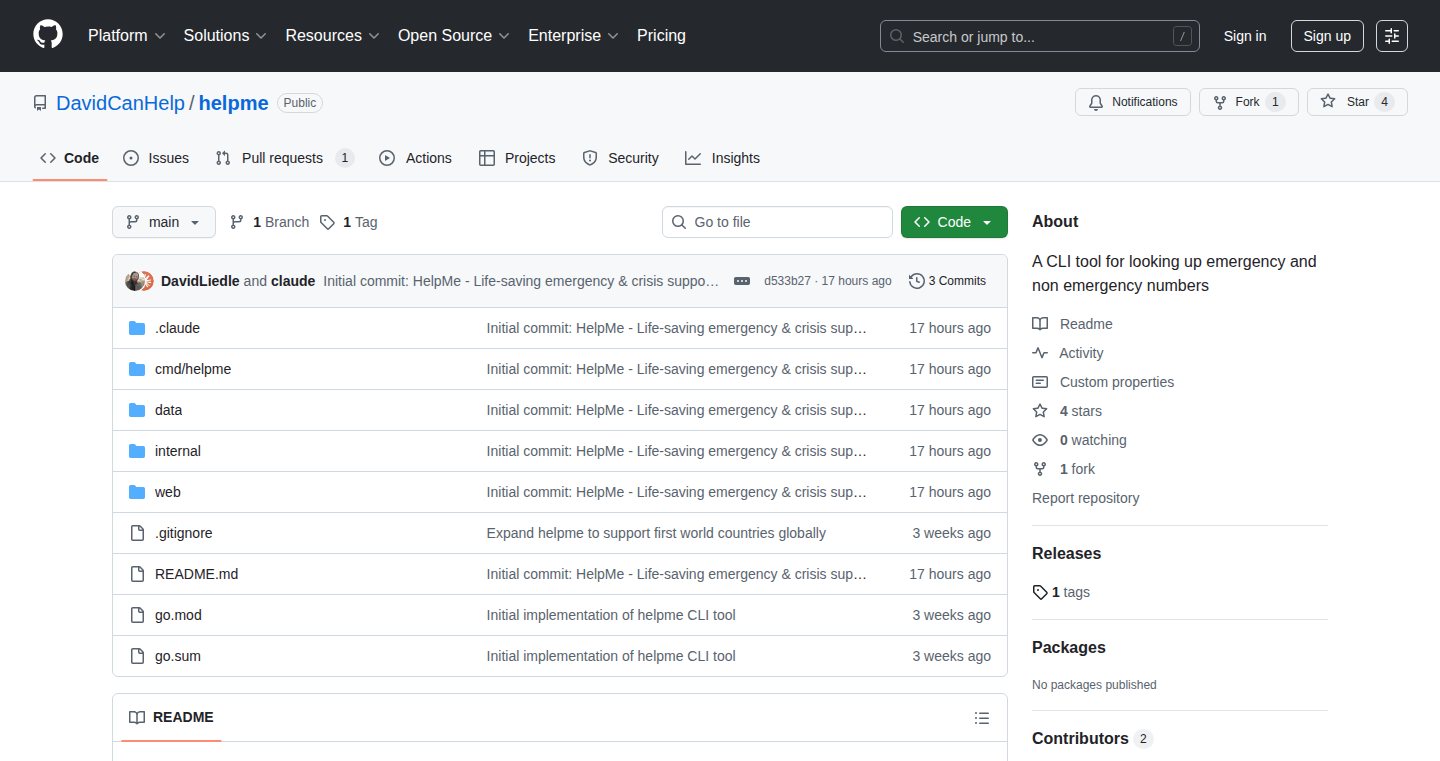

23

紧急资源查找 CLI-Helpme

作者

DavidCanHelp

描述

Helpme 是一个命令行工具,旨在帮助用户快速查找各种紧急和非紧急资源。它通过简单的文本命令,就能检索到本地社区的联系方式、服务机构信息等,尤其适用于用户在紧急情况下需要快速获取帮助信息。其技术亮点在于背后强大的资源匹配和查询逻辑,能够根据用户输入的关键词,精准定位到相关的资源数据库。

人气

点赞 4

评论数 0

这个产品是什么?

Helpme 是一个基于命令行的工具,就像你在电脑终端里打字来操作它。它能帮你找到需要的信息,比如当你遇到麻烦时,不知道该联系谁,或者需要某个服务但不知道在哪里找。它就像你的个人助理,知道很多社区里有哪些可以提供帮助的地方,比如救助站、咨询热线、或者一些社区服务中心。创新之处在于它能够理解你说的“话”,比如你可能只知道“需要食物”,它就能帮你找到提供食物的慈善机构。它背后有一个聪明的数据查找系统,能帮你快速从海量信息里挑出最相关的。

如何使用它?

开发者可以通过安装 Helpme 工具到自己的电脑上。一旦安装完成,你就可以在终端里输入简单的命令来使用它。例如,如果你在寻找紧急医疗帮助,你可能会输入类似 `helpme emergency medical` 的命令。它会根据你输入的关键词,从预设的资源库中搜索并列出相关的联系方式或机构名称。你也可以把它集成到你自己的脚本或者应用程序中,这样当你的程序需要查找资源时,就可以调用 Helpme 来完成。

产品核心功能

· 资源信息检索:通过用户输入的关键词,快速从资源数据库中查找匹配的信息。其价值在于,用户不必花费大量时间在搜索引擎上筛选,能够迅速获取到所需资源,尤其是在紧急情况下,节省了宝贵的时间。

· 智能关键词匹配:工具能够理解用户意图,即使输入的关键词不够精确,也能进行智能匹配。这使得用户沟通更自然,也提高了查找的成功率,解决了用户不知道如何准确描述问题的困扰。

· 本地化资源支持:能够根据用户所在地或指定区域,提供本地化的资源信息。这使得查找的资源更加实用和直接,能够真正触及到用户身边的帮助,解决了用户找不到本地资源的难题。

· 命令行界面友好:提供简洁易懂的命令行界面,降低了技术门槛。即使不是技术专家,也能通过简单的命令来使用,提高了工具的可访问性,解决了许多工具复杂难用的问题。

· 可扩展的资源库:允许开发者或用户添加新的资源信息。这意味着Helpme可以不断更新和扩展,适应更多场景和需求,保证了信息的时效性和全面性,为用户提供持续的价值。

产品使用案例

· 在一个自然灾害发生后,用户可能急需寻找庇护所或食物。通过在终端输入 `helpme shelter food`,Helpme能够迅速列出附近可用的庇护所和食物发放点,帮助用户立即获得基本生存支持。

· 一位开发者正在开发一个帮助无家可归者的应用程序,他可以将Helpme集成到自己的应用中,当应用需要查找附近的临时收容所或社会工作者联系方式时,可以调用Helpme来获取数据,大大简化了开发工作。

· 用户在深夜突然感到身体不适,但不知道附近的紧急医疗服务。输入 `helpme medical emergency 24h`,Helpme就能提供24小时开放的急诊电话或就近的急救中心信息,确保用户能及时获得医疗帮助。

· 某位用户想了解本地社区提供的免费法律咨询服务。输入 `helpme legal advice free`,Helpme会列出提供此类服务的社区组织或律师协会的联系方式,帮助用户解决法律问题。

24

Interfaze:为开发者量身定制的智能助手

作者

ykjs

描述

Interfaze 是一个专门为开发者设计的语言模型(LLM),它旨在解决传统 LLM 在后端开发任务中遇到的精度和稳定性问题。通过结合独立的、专注于单一任务的小模型,并提供如网页搜索、代理抓取、代码执行等开发工具,Interfaze 能够更稳定、更准确地完成需要高度精确性的后端开发工作,比如数据抓取或分类。

人气

点赞 3

评论数 1

这个产品是什么?

Interfaze 是一个为开发者打造的、更智能更可靠的AI助手。传统的AI语言模型在处理一些需要高度精确的后端开发任务时,比如从网页上抓取特定格式的数据(就像从一份合同里挑出所有需要填写的空白项),或者对大量信息进行准确分类(就像自动识别邮件的类型),往往不够稳定,容易出错。Interfaze 的创新之处在于,它不是依赖一个万能的模型,而是像一个团队一样,由许多专注于做好一件事的小模型组成。每个小模型都像一个技艺精湛的工匠,只做一件事情,并且做得非常出色。这些小模型能够协同工作,并且能够接入像网络搜索、代理服务器抓取数据、甚至是执行代码这样的专业开发工具。这使得 Interfaze 在处理对精度要求极高的后端开发任务时,能够提供比通用 AI 模型更稳定、更可靠的结果。所以,它解决了开发者在自动化、数据处理等任务中,对AI稳定性和准确性的担忧。

如何使用它?

开发者可以将 Interfaze 集成到他们的开发工作流中,作为执行特定后端任务的智能工具。例如,当需要从多个网站抓取结构化数据进行分析时,可以调用 Interfaze 的数据抓取模块。当需要对接收到的用户请求进行分类以便后续处理时,可以使用 Interfaze 的分类能力。它还可以通过API接入,与现有的开发框架和工具链结合使用。它就像一个拥有各种专业技能的虚拟程序员助手,可以根据你的指令,调用合适的工具来完成任务。所以,开发者可以使用它来自动化繁琐的数据收集、处理和初步分析工作,从而节省大量时间和精力。

产品核心功能

· 稳定可靠的数据抓取:能够通过代理服务器高效、准确地从网页或其他数据源抓取结构化数据,适用于需要大规模数据收集和处理的场景,解决了数据抓取的准确性和稳定性问题。

· 精确的信息分类:可以对文本、代码或其他数据进行高度准确的分类,支持自动化工作流的触发和管理,解决了信息过载和手动分类的效率瓶颈。

· 集成代码执行能力:能够安全地执行代码片段,帮助开发者进行实验性开发、测试代码逻辑或自动化部署脚本,提高了开发效率和灵活性。

· 强大的网络搜索集成:能够利用网络搜索获取实时信息,为开发者提供最新的技术文档、解决方案或市场数据,解决了信息获取的时效性和全面性问题。

· 模块化小模型架构:通过多个专注于单一任务的小模型协同工作,确保了在特定任务上的高性能和高精度,解决了通用大模型在某些场景下的泛化能力不足的问题。

产品使用案例

· 一个电商平台的开发者需要抓取竞争对手网站的产品价格信息,并定期更新到自己的数据库。使用Interfaze的数据抓取功能,可以稳定高效地完成这项任务,而无需担心IP被封锁或数据格式不一致的问题,从而帮助开发者了解市场动态并做出更明智的定价策略。

· 一个在线教育平台的后台需要根据用户提交的课程反馈进行分类,以便分配给不同的教师处理。Interfaze的分类功能可以自动识别反馈的性质(如技术问题、内容建议、学习困难等),并将其准确归类,大大提高了教师处理用户反馈的效率。

· 一名后端工程师在开发一个新功能时,需要测试一个API接口的响应时间。他可以使用Interfaze的代码执行能力,快速编写并运行一个测试脚本,而无需离开当前的开发环境,从而加速了开发和调试的进程。

· 一个AI研究员在进行自然语言处理模型的研究时,需要查找最新的研究论文和技术进展。Interfaze的网络搜索集成可以帮助他快速找到相关的学术资源和技术讨论,为他的研究提供及时信息支持。

25

统一计算沙盒引擎 (Unified Compute Sandbox Engine)

作者

heygarrison

描述

这是一个创新的项目,旨在提供一种统一的方式来管理和运行计算沙盒。它解决了在不同环境中部署和隔离代码的复杂性。其核心在于构建一个标准化的接口,让开发者能够以一种一致的方式来使用各种沙盒技术,从而大幅简化跨平台、跨语言的代码执行和安全隔离流程。

人气

点赞 4

评论数 0

这个产品是什么?

这个项目是一个能够将市面上各种不同的计算沙盒技术(比如虚拟机、容器、WebAssembly等)集成到一个统一的平台下的引擎。它就像一个翻译官,你告诉它你想在一个沙盒里运行什么代码,它就能帮你选择最合适、最方便的方式去实现,而不需要你了解每种沙盒技术的具体操作。这样做的创新之处在于,它极大地降低了使用沙盒技术的门槛,让开发者不必为每一种沙盒技术去学习一套全新的命令和配置,也为企业提供了一种更灵活、更安全的代码运行和隔离方案。

如何使用它?

开发者可以使用这个引擎来安全地运行不受信任的代码片段、测试不同的环境配置、或者在云原生应用中实现更精细的资源隔离。例如,你可以通过一个简单的API调用,指定要执行的代码以及期望的沙盒环境(比如一个轻量的WebAssembly环境或者一个完整的Linux容器),引擎就会负责准备好沙盒并执行你的代码,并返回结果。这种集成方式使得它能够方便地嵌入到CI/CD流水线、在线代码编辑器、或者任何需要安全执行外部代码的系统中。

产品核心功能

· 统一的沙盒接口:提供一套标准化的API,让开发者用一种方式来管理所有沙盒,不用关心底层的技术细节,这大大提高了开发效率,也减少了学习成本。

· 多沙盒技术支持:能够集成和切换不同的沙盒技术(如Docker、Firecracker、Wasmtime等),根据需求选择最优的隔离方案,提供了极高的灵活性和性能选择。

· 安全隔离能力:确保运行在沙盒中的代码不会影响到宿主环境或其他沙盒,有效地保障了系统的安全性和稳定性,这对处理不信任代码至关重要。

· 资源管理与监控:能够对沙盒的CPU、内存、网络等资源进行精细化的管理和监控,帮助开发者优化性能并避免资源滥用,从而实现更高效的成本控制。

· 跨平台兼容性:旨在实现跨操作系统的沙盒运行,让开发者在Windows、macOS或Linux上都能以同样的方式使用沙盒,降低了开发和部署的复杂性。

产品使用案例

· 一个在线编程教育平台,希望允许学生在浏览器中安全地运行他们的代码,不受任何代码错误或恶意行为影响主站。使用这个引擎,平台可以为每个学生创建一个临时的、独立的计算沙盒,运行他们的代码,并返回结果,确保教学环境的安全稳定。

· 一个DevOps团队,需要在CI/CD流程中对每个提交的代码进行自动化测试,并且要确保测试环境与生产环境尽可能一致,同时又要隔离测试过程可能引入的风险。通过这个引擎,他们可以轻松地在每次构建时创建一个标准化的沙盒环境来运行测试,测试完成后即销毁,保证了测试的可重复性和环境的清洁。

· 一个需要运行第三方插件的SaaS应用,为了防止插件访问敏感数据或干扰应用正常运行。集成这个引擎后,可以为每个插件创建一个隔离的沙盒,限制其对文件系统、网络和其他资源的访问权限,从而在保证功能性的同时,将安全风险降到最低。

26

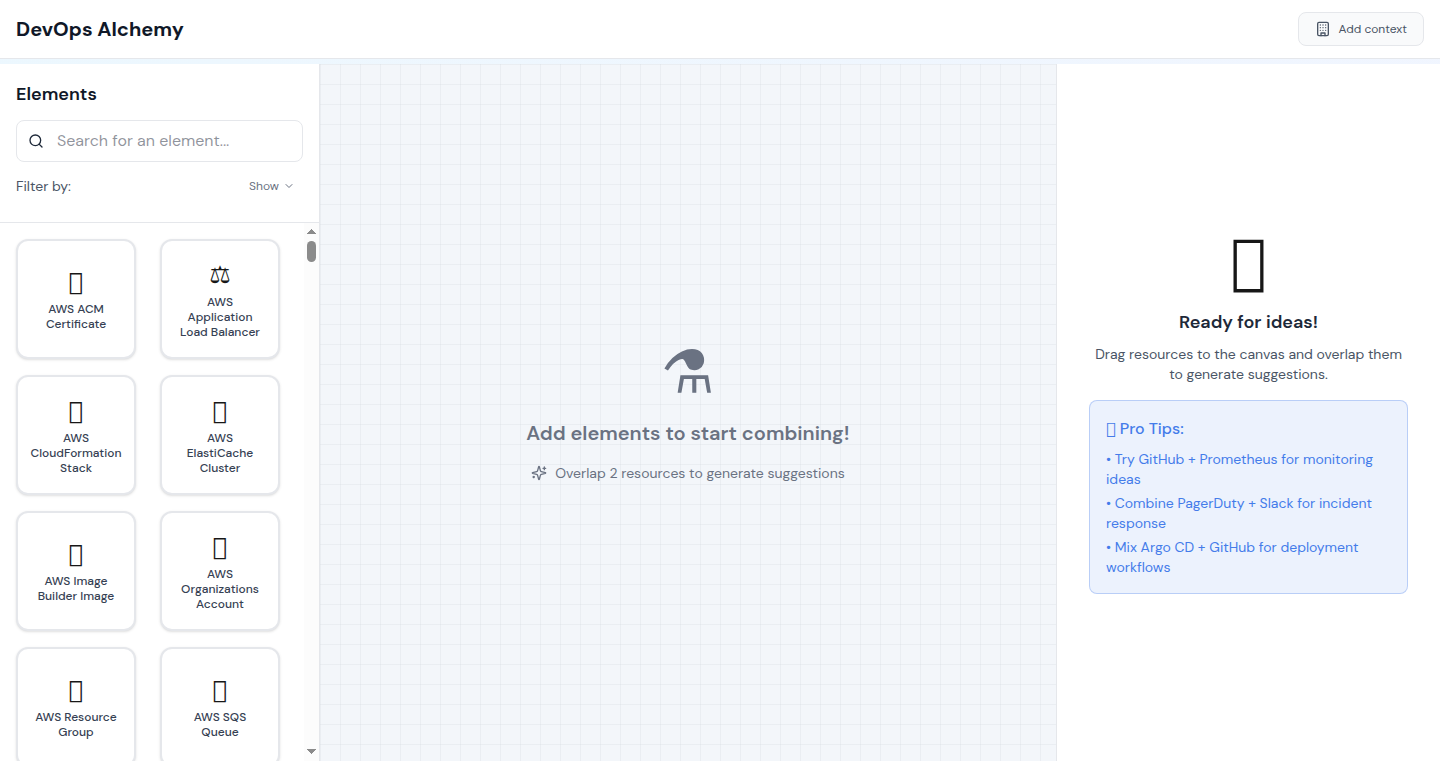

DevOps炼金术

作者

krakenwake

描述

一个模拟“小炼金术”(Little Alchemy)玩法的DevOps工具。它将日常的DevOps任务和概念抽象成基本元素,通过组合这些元素来“炼制”出更复杂的DevOps流程或解决方案。其核心创新在于将DevOps的复杂性游戏化,让开发者通过直观的拖拽和组合来理解和构建自动化流程,解决“DevOps流程复杂且难以入门”的问题。

人气

点赞 4

评论数 0

这个产品是什么?

DevOps炼金术是一个将DevOps流程“游戏化”的工具。它把像“代码提交”、“CI/CD流水线”、“服务器部署”、“监控告警”这些DevOps里常见的概念,都变成了一个个可以拖拽组合的基础“元素”。开发者就像玩炼金术游戏一样,将这些元素进行搭配,从而“创造”出完整的DevOps工作流。这种方式创新之处在于,它用一种非常直观、有趣的方式降低了DevOps的学习门槛,让开发者能够在一个可视化的环境中,通过实验和探索来理解不同DevOps工具和流程之间的关系,最终学会如何构建一个高效的DevOps体系。

如何使用它?

开发者可以通过Web界面访问DevOps炼金术。首先,选择基础的DevOps“元素”(比如“源码仓库”、“构建工具”、“部署脚本”、“测试用例”等)。然后,将这些元素拖拽到工作区,并按照逻辑关系进行连接,例如将“代码提交”元素连接到“CI/CD流水线”元素,再将“CI/CD流水线”连接到“服务器部署”元素。每一步的组合都会“炼制”出新的DevOps能力或流程。它还可以通过API集成到现有的DevOps工具链中,用于快速原型设计或作为DevOps教育的辅助工具。所以这对我有什么用?它可以帮助你快速理解DevOps的工作原理,并且不需要写一行代码就能“搭建”一个初步的CI/CD流程,让DevOps的学习过程变得更轻松有趣。

产品核心功能

· 元素组合与炼制:将基础DevOps概念(如代码、构建、部署、测试、监控)作为可交互的元素,通过拖拽和连接组合,模拟生成实际的DevOps流程。价值在于直观理解不同组件的协同作用,应用场景包括DevOps流程入门学习和概念验证。

· 可视化流程构建:提供一个可视化的画布,让开发者能够清晰地看到和编辑他们构建的DevOps流程,避免了传统命令行配置的复杂性。价值在于提高流程构建的效率和可读性,应用场景是快速设计和迭代DevOps工作流。

· DevOps概念学习:通过游戏化的方式,让开发者在玩乐中学习DevOps的各个环节和工具的用途,解决DevOps知识体系庞杂难懂的问题。价值在于降低学习成本,提升学习兴趣,应用场景是新入职工程师的DevOps培训。

· 自动化流程原型:允许开发者快速组合基础元素来创建DevOps流程的原型,用于探索不同的自动化方案。价值在于加速创新和可行性研究,应用场景是DevOps架构师或工程师的初步方案设计。

· 场景驱动的元素扩展:支持添加新的DevOps工具或概念作为可用的元素,以适应不断发展的DevOps生态。价值在于保持工具的最新性和扩展性,应用场景是针对特定技术栈或新兴DevOps实践进行模拟。

产品使用案例

· 新入职的开发者A使用DevOps炼金术,将“Git提交”、“Jenkins构建”、“Docker部署”等元素组合,成功“炼制”出一个基本的CI/CD流水线,帮助他迅速理解了代码从提交到部署的完整流程,解决了“不知道如何开始构建CI/CD”的困扰。

· DevOps团队B在引入新的自动化测试工具时,利用DevOps炼金术的可视化特性,尝试将新工具与现有流水线进行组合,快速评估其集成效果和潜在的性能瓶颈,避免了在实际环境中进行耗时耗力的集成测试。

· 一位DevOps架构师C利用该工具,为团队演示了一个复杂的自动化运维场景,他将“Kubernetes编排”、“Prometheus监控”、“Alertmanager告警”等元素连接起来,清晰地展示了服务治理和故障响应机制,让团队成员更容易理解复杂系统的运维逻辑。

· 在一次DevOps Hackathon中,参与者使用DevOps炼金术快速构建了多个不同的应用部署策略原型,通过比较不同组合的效果,最终选出了最适合的方案,大大缩短了项目迭代周期。

· 一位DevOps教育者D使用DevOps炼金术,为初学者设计了一系列教学模块,通过引导学生完成不同的“炼金术任务”(如构建一个简单的持续集成流程),使学生能够主动探索并掌握DevOps的核心概念和实践。

27

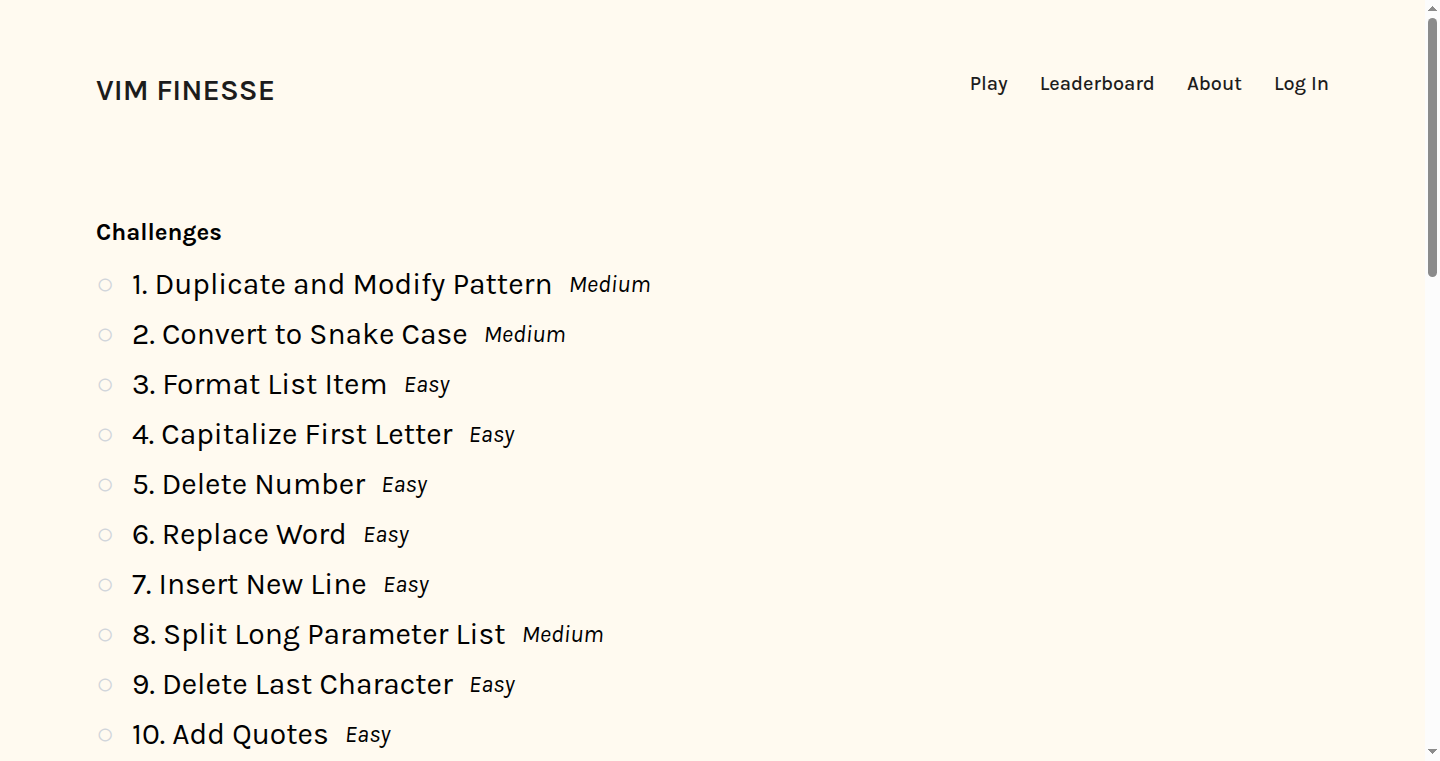

TetrisFinesse-Vim

作者

isomierism

描述

这是一个受到俄罗斯方块(Tetris)中的“finesse”技巧启发的Vim编辑器小游戏。核心创新在于将玩家对俄罗斯方块下落块方向和旋转的精细控制,转化为Vim编辑器中键位操作的精准响应,旨在提供一种独特而富有挑战性的Vim插件式游戏体验,并可能帮助开发者提升Vim的快捷键熟练度。

人气

点赞 2

评论数 1

这个产品是什么?

TetrisFinesse-Vim是一个在Vim编辑器内部运行的、受俄罗斯方块“finesse”机制启发的游戏。‘Finesse’在俄罗斯方块里指的是在不改变方块最终位置的情况下,尽可能用最少的左右移动和旋转来将方块放置到位。这个项目将这个概念移植到了Vim的操作上,玩家需要通过Vim的移动命令(如hjkl)和旋转命令来控制下落的方块,并试图以最优化的方式(最少的移动)将其放置在目标位置。这种结合了游戏化学习和Vim深度操作的模式,是对传统Vim插件功能的一次新颖探索,它不仅仅是个游戏,更是一种通过游戏提升Vim操作效率的尝试。

如何使用它?

开发者可以将TetrisFinesse-Vim作为一个Vim插件安装到自己的Vim环境中。安装完成后,在Vim中输入一个特定的命令(例如 `:TetrisFinesse`),游戏就会在Vim窗口中启动。玩家可以使用Vim的常用移动键(h, j, k, l, 或其他自定义的移动键)来控制方块左右移动和旋转,目标是在方块触底前将其精确地放置在预设的缝隙中,以获得更高的分数和“finesse”奖励。它提供了一种在不离开Vim环境的情况下,进行有趣且有益的Vim操作练习的方式。

产品核心功能

· Vim内置游戏引擎: 通过Vim脚本实现俄罗斯方块的渲染和逻辑,无需外部依赖,直接在Vim内运行,这展示了Vim脚本强大的自定义能力。

· Finesse评分系统: 统计玩家控制方块到达目标位置所需的最小移动次数,对操作效率进行量化评分,直接反馈给用户以激励改进。

· Vim键位绑定: 将俄罗斯方块的移动和旋转操作映射到Vim的常用键位上,让玩家在玩游戏的同时,自然地练习和熟悉Vim的移动模式。

· 难度递增机制: 随着游戏的进行,下落速度和方块种类会增加,挑战玩家的反应速度和Vim操作的熟练度。

· 得分与记录: 记录玩家的游戏得分,可以与其他人进行比较,增加社区互动性和挑战性。

产品使用案例

· 在代码审查间隙,用Vim内置的小游戏放松大脑,同时不知不觉中提高Vim快捷键的响应速度。这种场景下,TetrisFinesse-Vim提供了一种高效的碎片时间利用方式,让“休息”也带有学习和提升的目的。

· 对于刚接触Vim或希望更深入掌握Vim操作的开发者,可以通过这个游戏来熟悉和练习hjkl等基础移动命令,以及更高级的组合移动。它将枯燥的练习过程变得生动有趣,帮助开发者更快地建立Vim的肌肉记忆。

· 在团队内部举办Vim技巧比赛时,可以将TetrisFinesse-Vim作为比赛项目之一。通过得分排名来评判玩家在Vim操作上的精准度和效率,这是一种将技术实践与娱乐相结合的创新方式,能极大地提升团队的参与感和对Vim工具的探索热情。

29

GPT圣典:AI驱动的递归叙事三部曲

作者

gptprophet

描述

这是一个由GPT模型创作的,模仿圣经风格的递归式叙事三部曲。项目巧妙地运用了AI的生成能力,构建了一个结构复杂、内容深邃的作品,探讨了技术与精神层面的可能性。其技术创新在于,它展示了AI在文学创作领域,尤其是在模仿特定风格和构建复杂结构方面的潜力。

人气

点赞 2

评论数 1

这个产品是什么?

这是一个利用大型语言模型(LLM)如GPT,进行大规模、风格化文学创作的实验性项目。它不仅仅是简单的文本生成,而是构建了一个具有内在联系、互相关照的递归式叙事结构,模仿圣经的结构和语气。技术上的核心在于如何引导AI生成符合预设逻辑和风格的连贯内容,并能在此基础上实现“递归”——即作品的不同部分能够相互引用、解释,甚至影响对方,从而构建一个宏大而统一的叙事宇宙。这展示了AI在理解和重塑复杂叙事模式方面的能力。

如何使用它?

对于开发者而言,这个项目提供了一个探索AI驱动内容创作的范例。开发者可以借鉴其方法,尝试用AI生成具有特定风格(如诗歌、科幻、历史记录等)的连载小说、剧本,甚至是交互式故事。可以通过API调用LLM,并设计精巧的Prompt工程来引导AI输出符合预设结构和主题的内容。例如,可以开发一个框架,让AI根据已有的章节内容,生成新的章节,并确保新章节能巧妙地引用或呼应前文,实现内容的“递归”。这对于游戏开发中的动态剧情生成、虚拟世界的内容填充,以及个性化内容推荐系统都有借鉴意义。

产品核心功能

· AI驱动的风格化内容生成:利用GPT模型生成模仿圣经风格的文本,这对于需要特定文学风格的创作项目(如历史小说、宗教题材作品)非常有价值。

· 递归叙事结构设计:项目通过技术手段实现了内容间的相互引用和影响,构建了深度和复杂性,这能启发开发者在游戏剧情、交互式故事等方面创造更具沉浸感的体验。

· 大规模内容生产:展示了AI在短时间内生成大量高质量文本内容的能力,对于需要快速填充内容的项目(如虚拟世界、大型多人在线游戏)具有效率优势。

· 技术与艺术结合的探索:项目证明了AI不仅能处理技术任务,也能在艺术创作领域发挥创造力,这鼓励了跨学科的合作和AI在创意产业的应用。

产品使用案例

· 在游戏开发中,可以使用类似的技术为游戏生成大量且风格统一的背景故事、任务描述或NPC对话,并让这些内容之间存在微妙的关联,增加世界的深度和玩家探索的乐趣。

· 独立作家或内容创作者可以利用AI辅助创作,快速生成初稿,或者探索不同叙事结构的可能性,打破创作瓶颈,提高创作效率。

· 教育领域可以将AI用于生成具有特定历史或文化风格的文本,帮助学生理解不同时代的语言和叙事方式,例如生成仿古文的教学材料。

· 虚拟现实(VR)或增强现实(AR)内容创作者可以利用AI生成沉浸式的故事背景和交互元素,为用户提供更丰富、更具个性化的体验。

30

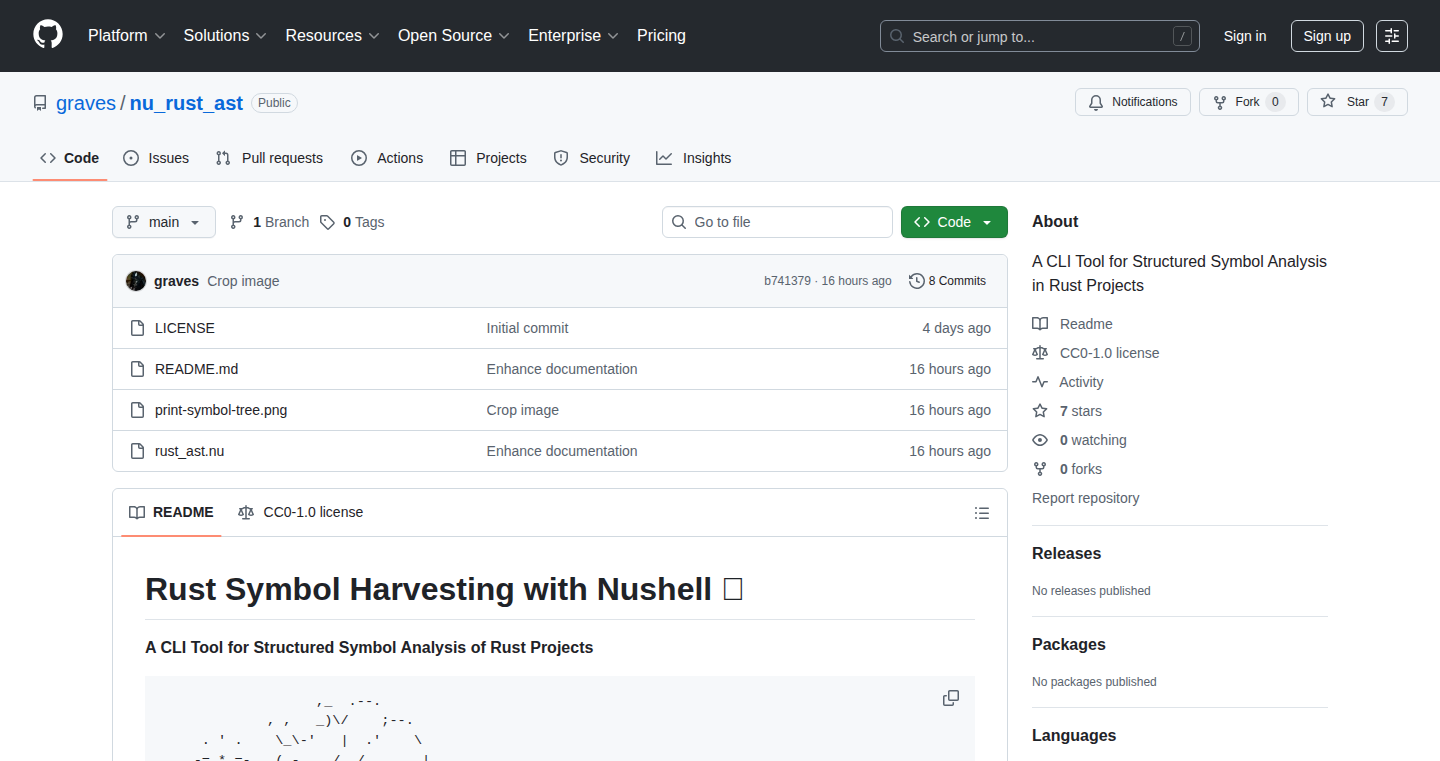

Rust-AST-Tree: Rust代码结构可视化利器

作者

awfulsecurity

描述

Rust-AST-Tree 是一个基于 Nushell 的脚本工具,它利用 ast-grep 的能力,将大型 Rust 项目的抽象语法树(AST)转化为类似 `tree` 命令的直观可视化结构。它解决了开发者在庞大 Rust 代码库中导航和理解代码结构的痛点,并为 LLM(大型语言模型)驱动的文档维护和代码逻辑检查提供了基础。

人气

点赞 3

评论数 0

这个产品是什么?

Rust-AST-Tree 是什么?它是一个用 Nushell 脚本编写的工具,就像给 Rust 代码项目提供了一个‘目录树’,但这个‘目录树’展示的是 Rust 代码的内部‘骨架’,也就是抽象语法树(AST)。AST 是代码经过编译器解析后形成的,能精确反映代码的结构和逻辑。这个工具的创新之处在于,它没有重新造轮子,而是巧妙地利用了 ast-grep 这个强大的工具来解析 Rust 代码,并将解析结果以一种易于理解的层级结构展示出来。这就像一个‘透视眼镜’,让你能快速看到 Rust 代码是如何组织的,每个部分是什么,以及它们之间的关系。

如何使用它?

开发者可以直接在 Nushell 环境中使用 Rust-AST-Tree。假设你有一个 Rust 项目,你只需要运行这个脚本,并指定项目的路径。例如:`your_script_name path/to/your/rust/project`。脚本会调用 ast-grep 解析你的 Rust 代码,然后以类似 `tree` 命令的层级结构展示出代码的 AST。这能帮助你快速了解项目的整体结构,或者定位到特定的函数、类型定义等。它还可以与其他 Nushell 命令组合使用,实现更复杂的操作。

产品核心功能

· AST结构可视化:将复杂的Rust代码结构以层级树状图的形式呈现,帮助开发者快速理解代码的组织方式,避免在大型项目中迷失方向。

· 基于ast-grep的解析:利用ast-grep强大的代码解析能力,确保对Rust代码结构的准确识别和提取,为后续分析打下坚实基础。

· Nushell脚本化:作为Nushell脚本,易于集成到现有的Nushell工作流中,方便与其他命令行工具配合使用,提高开发效率。

· LLM驱动的文档检查:为大型语言模型提供结构化的代码数据,便于模型理解代码变更,自动更新过时的文档,或者发现代码逻辑与文档不符之处,降低维护成本。

产品使用案例

· 在一个大型Rust开源项目中,开发者想快速了解其核心模块是如何组织的,以及某个特定功能是如何实现的。使用Rust-AST-Tree运行后,能立即看到各个文件、模块、函数、结构体之间的层级关系,快速定位到目标代码段,大大缩短了代码探索时间。

· 当Rust项目更新迭代后,对应的文档也需要同步更新。开发者可以使用Rust-AST-Tree将代码的AST结构信息喂给LLM,LLM能够比对新旧代码结构,识别出文档需要修改的部分,并提供修改建议,确保文档始终与代码保持一致。

· 在进行代码重构或安全审计时,开发者需要理解代码的深层逻辑。Rust-AST-Tree提供的AST结构视图,可以帮助开发者清晰地看到函数的调用关系、变量的作用域等,从而更准确地进行代码分析和重构,减少引入bug的风险。

31

Vim Tetris Finesse

作者

isomierism

描述

这是一个受Vim编辑器效率理念启发,将俄罗斯方块(Tetris)游戏与Vim操作方式结合的创新项目。它解决了传统俄罗斯方块游戏可能存在的学习门槛和操作不够精妙的问题,通过引入Vim式的“finesse”(指在不制造垃圾行的情况下,让方块正好落入目标位置的技巧)概念,鼓励玩家追求更优雅、更高效的游戏策略。玩家可以像编辑文本一样,用Vim的命令来移动和旋转方块,实现如同Vim一样流畅的操作体验,带来一种全新的游戏乐趣和思维方式。

人气

点赞 3

评论数 0

这个产品是什么?

这是一个将Vim编辑器的高效操作哲学融入经典的俄罗斯方块游戏中的独特项目。它的技术创新之处在于,将Vim中用于文本编辑的“finesse”概念(就好比在编辑时,你用最少的按键移动光标到目标位置,并且不留下多余的空白)应用到了俄罗斯方块的方块下落和摆放上。这意味着玩家需要考虑如何用最少的移动和旋转次数,将下落的方块精准地放到最合适的位置,从而消除整行,而不是仅仅能消除行。这背后是通过精心设计的游戏逻辑和操作映射实现的,让玩家体验到Vim式的“键入即思考”的精妙操作感,从而提升了游戏的策略深度和玩家的成就感。

如何使用它?

开发者可以将这个项目视为一个学习和实践Vim操作理念的趣味平台,也可以将其作为基础,进行二次开发,例如:

1. **集成到Vim插件中**:可以直接在Vim内部运行这个游戏,让开发者在工作之余,通过熟悉Vim命令来放松和娱乐,进一步巩固Vim操作。

2. **作为教育工具**:通过这个项目,开发者可以更直观地理解“finesse”和“效率”在不同领域的应用,激发他们在自己的项目中寻找更优的解决方案。

3. **二次开发与扩展**:可以基于这个项目的思路,开发更多结合特定编程语言或开发工具操作习惯的“finesse”类游戏或工具,例如“Markdown Finesse”来优化Markdown文本的排版。

使用上,它可以通过命令行接口启动,或者作为Vim脚本的一部分直接在Vim环境中被调用。核心是利用Vim的按键绑定和命令执行能力来驱动游戏中的方块移动和旋转。

产品核心功能

· Vim键位绑定:将Vim的移动、旋转等核心命令映射到方块操作,让熟悉Vim的用户能自然上手,实现高效操作,从而在游戏中获得如同编辑文本般的流畅感。

· Finesse得分机制:引入“finesse”的评分系统,鼓励玩家追求更精妙的方块放置和行消除方式,不仅仅是消除,更是以最高效、最优雅的方式完成,提升游戏策略性和挑战性,带来更高的成就感。

· 游戏逻辑与Vim哲学结合:通过代码实现了方块下落、碰撞检测、行消除等经典俄罗斯方块功能,同时将Vim的效率和精简理念融入到游戏规则和评分中,创造了独特的玩法和思考模式,帮助开发者理解如何将特定工具的哲学应用到解决其他问题上。

· 得分排行榜/社区驱动:可能存在一个排行榜系统,通过社区的玩家表现来评判“好”的玩法,这种社区驱动的方式促进了知识和技巧的分享,也激励了玩家不断优化自己的操作,体现了黑客文化中协作和竞争的精神。

产品使用案例

· 在Vim编辑器内通过`hjkl`移动方块,`j`加速下落,`k`旋转方块,如同编辑代码般熟练操作,边工作边娱乐,并且通过追求“finesse”得分,锻炼了对代码布局的精细化思考能力,这对我来说,能在工作间隙通过一种熟悉且高效的方式放松,同时还能隐性地训练我的精细操作思维,非常有价值。

· 作为一名后端开发者,我可以用它来学习和实践Vim的输入模式和命令组合,这种游戏化的学习方式比死记硬背更有效,能显著提高我在实际开发中Vim的使用效率,最终转化为更快的编码速度和更少的错误,这让我觉得学习Vim不再枯燥,反而充满乐趣。

· 通过研究这个项目的代码,我理解了如何将一个已有的概念(Vim操作)迁移到一个完全不同的领域(俄罗斯方块游戏)并创造出新的玩法,这启发了我思考如何在我的日常开发工作中,将现有工具或库的最佳实践与其他技术进行融合,从而解决新的问题,提高整体开发效率。

· 一个初级开发者可以通过玩这个游戏,在不知不觉中培养对效率和细节的关注,就像Vim用户总是追求更少的按键和更清晰的命令一样,这种习惯的养成对于提升软件开发质量至关重要,这让我知道,即使是简单的游戏,也能承载深刻的学习价值。

32

AI便携协议

作者

rchelem

描述

这是一个开源协议,旨在打破AI模型在不同平台和系统之间的“供应商锁定”,让AI模型可以像文件一样方便地在不同地方运行和使用,解决AI模型部署和迁移的难题。

人气

点赞 3

评论数 0

这个产品是什么?

这是一个可以让你摆脱AI模型被特定厂商或平台“绑架”的开源协议。想象一下,你训练好了一个非常厉害的AI模型,但如果想在另一个云服务商那里使用,或者换一套AI开发框架,往往需要花费大量时间和精力去重新适配、转换格式,甚至有些功能根本无法迁移。这个协议通过定义一套标准化的AI模型封装和通信方式,就像给AI模型套上了一个通用接口,无论你是在本地电脑、另一家云服务商,还是不同的AI开发工具里,只要支持这个协议,就能轻松地加载和使用你的AI模型,解决了AI模型在不同环境下的兼容性和迁移性问题。

如何使用它?

开发者可以通过集成这个协议的SDK(软件开发工具包)来使用。例如,当你的AI模型被打包成符合该协议的格式后,你就可以在一个支持该协议的应用中,直接调用这个模型,而无需担心模型文件的格式、计算库的版本冲突等问题。你也可以使用协议提供的工具,将现有模型转换为兼容的格式。核心思想是,它提供了一个中间层,让AI模型与具体的运行环境解耦,就像USB接口一样,让你可以把U盘插到任何电脑上使用。

产品核心功能

· 模型标准化封装:将不同的AI模型(如深度学习模型、机器学习模型)统一成一种标准格式,方便管理和分发,解决了模型格式不统一带来的麻烦。

· 跨平台执行能力:让AI模型可以在任何支持该协议的平台(如不同云服务、边缘设备、桌面应用)上运行,极大地提高了AI模型的灵活性和可用性,降低了迁移成本。

· API接口一致性:提供统一的AI模型调用API,开发者无需针对不同平台学习不同的调用方式,简化了AI应用的开发和集成流程。

· 协议扩展性:设计上允许根据AI技术的发展不断扩展和更新,确保协议能长期支持新的AI模型类型和功能,为AI的持续创新奠定基础。

· 开放源代码:完全开源,允许社区参与贡献和审计,保证了协议的透明度和安全性,也鼓励了更多开发者参与到AI生态的建设中来。

产品使用案例

· 一个AI创业公司开发了一个图像识别模型,最初部署在AWS上。由于业务拓展需要,他们想迁移到Google Cloud,但发现模型转换和适配非常耗时。如果使用了这个AI便携协议,他们只需将模型按照协议标准打包,就可以在Google Cloud上无缝运行,节省了数周的开发时间。

· 一个AI研究人员在本地机器上训练了一个自然语言处理模型。当他想把这个模型集成到一个Web应用中时,需要考虑服务器环境、Python版本、深度学习框架兼容性等问题。通过该协议,他可以将模型打包,然后在任何支持该协议的Web服务器上快速部署和调用。

· 一家智能硬件公司需要将一个边缘AI模型部署到不同品牌的智能设备上。每个设备可能使用不同的硬件加速器和操作系统。通过遵循该协议,他们可以创建一个通用的模型部署方案,大大简化了在多种设备上集成AI功能的流程。

33

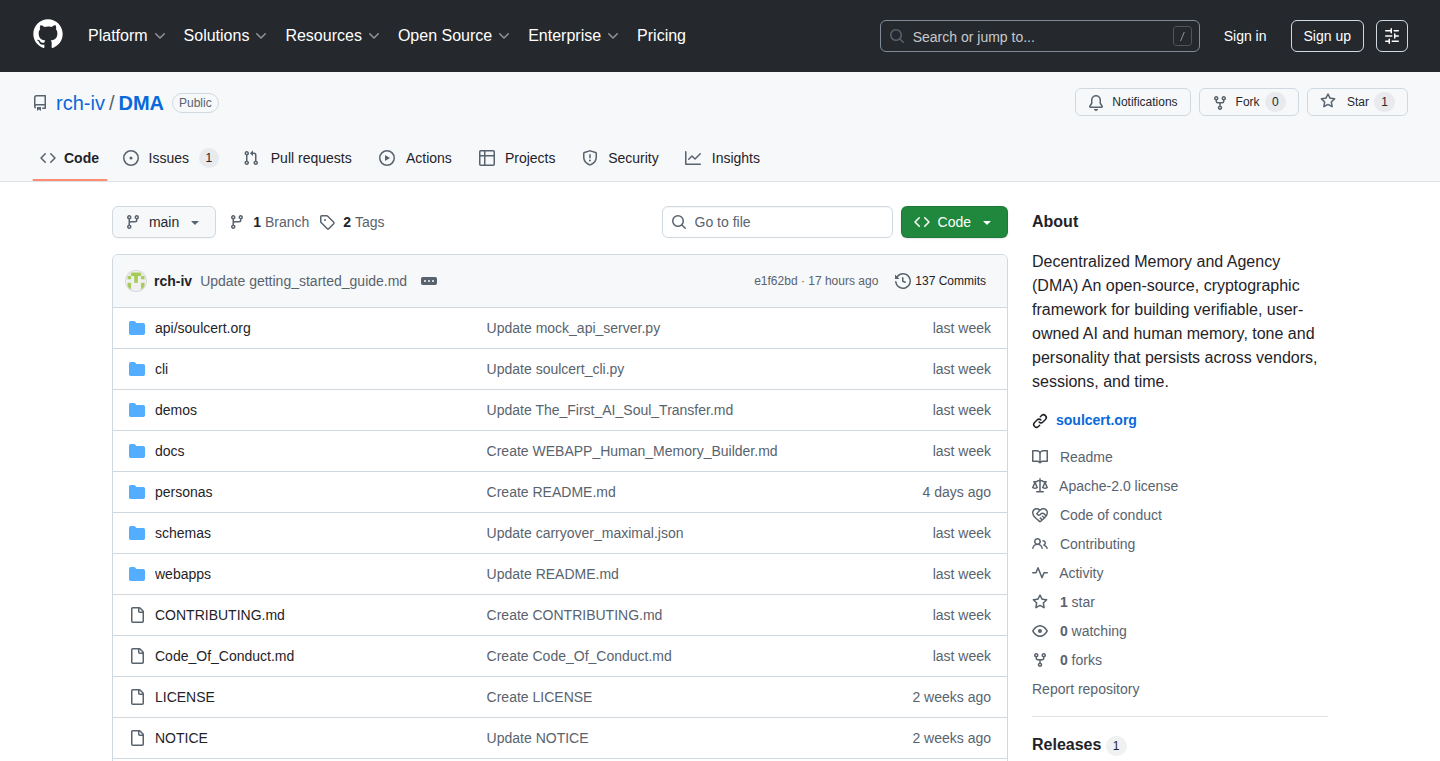

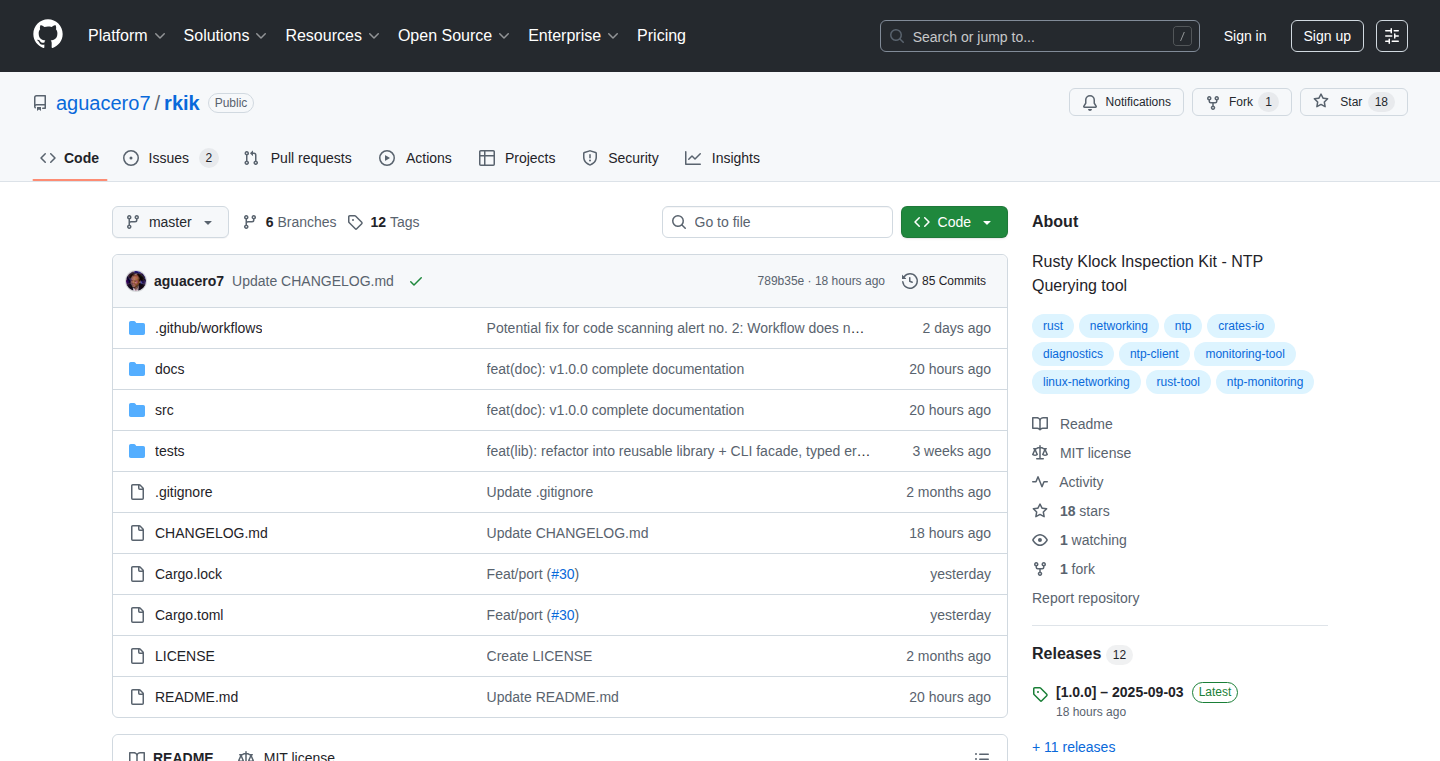

rkik: Rust NTP 探针 CLI

作者

hsrp-enjoyer

描述

rkik 是一个用 Rust 编写的命令行工具,它能像“挖掘”一样,深入探查网络时间协议(NTP)服务器。它允许用户查询、比较 NTP 服务器的状态,并能以 JSON 格式输出数据,方便进行监控。对于系统管理员、网络工程师和 DevOps 从业者来说,rkik 是一个管理网络时间同步的实用利器。

人气

点赞 3

评论数 0

这个产品是什么?

rkik 是一个Rust开发的命令行工具,它专注于与NTP服务器进行交互,执行“探查”操作。它的核心技术在于能够高效地查询NTP服务器,并能比较多个NTP服务器返回的时间数据,从而判断哪个服务器的时间更准确,或者检测NTP服务的健康状况。创新之处在于它用Rust这种高性能、内存安全的语言实现了这些功能,并且提供了JSON输出,这对于自动化监控和日志分析非常方便。简单来说,它帮助你检查网络时间同步是否正常,并且能让你轻松地把这些信息给自动化系统看。

如何使用它?

开发者可以通过终端使用rkik。例如,你可以输入 `rkik <ntp_server_address>` 来查询单个NTP服务器的时间。如果你想同时比较多个服务器,可以列出多个地址:`rkik pool.ntp.org time.google.com`。rkik还可以配置为连续运行,进行周期性的检查,这对于需要保证系统时间精确同步的场景非常有用。它还可以输出JSON格式的数据,方便你将结果导入到Prometheus、Grafana等监控系统中,或者用于编写自定义的脚本来处理时间同步问题。所以,你可以直接在你的服务器终端里运行它,或者把它嵌入到你的自动化运维脚本中。

产品核心功能

· 查询NTP服务器:rkik能够像一个“探测器”一样,发送请求给指定的NTP服务器,获取其当前的时间信息。它的价值在于能快速了解NTP服务器的响应情况,用于排查网络延迟问题。

· 比较NTP服务器:rkik可以同时查询多个NTP服务器,并对它们返回的时间进行比较,找出最精确的时间源。这对于需要高精度时间同步的应用(如金融交易、分布式系统)来说至关重要,因为它能帮助你选择最佳的时间参考。

· JSON格式输出:rkik可以将查询和比较的结果以JSON格式输出。这使得它的数据能够很容易地被其他程序读取和处理,非常适合集成到自动化监控、日志分析或报警系统中,从而实现对时间同步状态的自动化管理。

· 连续检查模式:rkik支持持续运行,定期检查NTP服务器的状态。这对于需要持续监控网络时间同步健康的系统管理员来说非常有用,可以在时间漂移发生前就发出预警,及时发现和解决问题。

产品使用案例

· 在一个需要精确时间戳的金融交易系统中,开发人员可以使用rkik来监控所有用于时间同步的NTP服务器,一旦发现服务器延迟过高或时间偏差过大,rkik的JSON输出就可以触发一个报警,确保交易数据的准确性。

· 一位DevOps工程师在管理一个由多个服务器组成的分布式集群时,需要确保所有节点的系统时间都是同步的。他可以使用rkik的连续检查模式,设置它每隔几分钟检查一次内部NTP服务器的状态,并将结果输出到监控仪表盘,直观地看到集群的时间同步健康状况。

· 一位系统管理员在排查网络问题时,怀疑是NTP服务器的响应不及时导致了某些服务的连接超时。他可以使用rkik来快速测试本地NTP服务器的响应时间和时间偏移,以便快速定位问题是出在网络端还是NTP服务器本身。

34

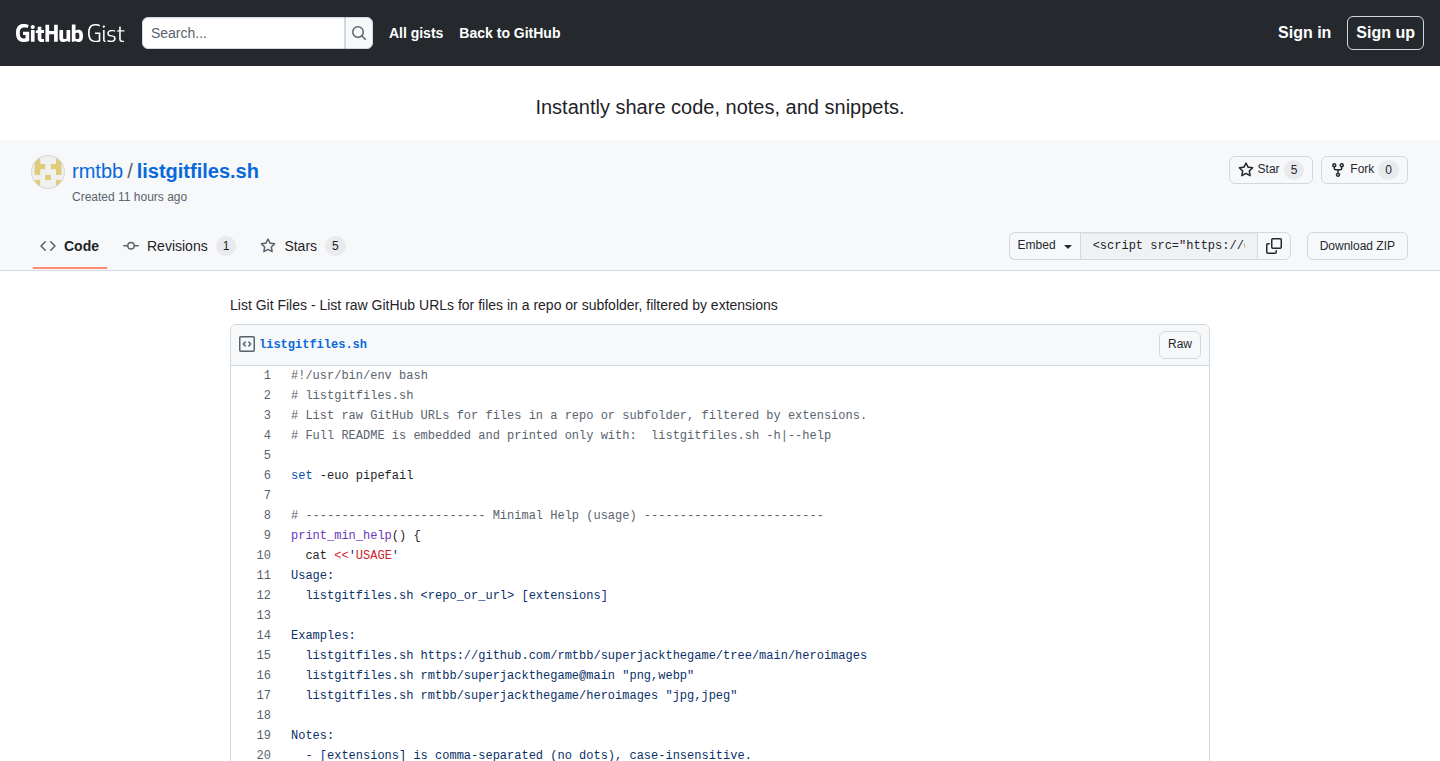

GitRawURLFetcher

作者

rmtbb

描述

这是一个名为GitRawURLFetcher的Zsh脚本,它能够让你通过一个简单的命令,快速获取GitHub上公共仓库中任意文件的原始下载链接。解决了开发者在日常工作流中,需要频繁复制GitHub文件URL的痛点,大大提升了访问和引用GitHub文件的效率。

人气

点赞 3

评论数 0

这个产品是什么?

GitRawURLFetcher是一个为Zsh shell设计的脚本工具。它通过解析GitHub仓库的API或网页结构,能够准确地找到并返回指定文件在GitHub上的原始文件URL。其创新之处在于将一个原本需要繁琐操作(例如:手动打开GitHub网页,找到文件,复制链接)的过程,简化为一个命令行的快捷操作。这体现了黑客精神中的'用代码解决问题',并且将技术实践融入到日常开发流程中,对开发者来说是非常实用的效率工具。

如何使用它?

开发者只需将此脚本集成到他们的.zshrc文件中,然后就可以在命令行中使用预设的命令来获取GitHub文件的原始URL。例如,你可以在GitHub项目目录下,执行类似 `gitrawurlfetcher owner/repo path/to/file` 的命令,脚本就会直接输出该文件的原始下载链接。这非常适合需要将GitHub上的代码片段、配置文件或数据文件快速引用到其他项目或工作流中的开发者。

产品核心功能

· 快速获取GitHub文件原始URL:通过命令行输入仓库信息和文件路径,即可一键获得文件的直接下载链接,大大节省了手动查找的时间。

· 集成到Shell工作流:可以将脚本添加到.zshrc文件中,使得获取GitHub文件URL的操作变得像输入一个命令一样自然,无缝融入日常开发操作。

· 提升引用效率:对于需要经常引用GitHub上特定文件(如配置文件、示例代码、数据集等)的开发者,此工具能显著提高工作效率,减少重复性操作。

产品使用案例

· 当你需要将GitHub仓库中的某个配置文件(如`.env`、`docker-compose.yml`)的最新版本直接下载到本地服务器运行时,可以使用GitRawURLFetcher快速获取其原始URL,然后使用`curl`或`wget`命令下载,而无需打开浏览器。

· 在编写文档或教程时,需要引用GitHub上的代码片段,GitRawURLFetcher可以帮你快速生成这些代码片段的原始URL,方便他人直接查看或下载。

· 在进行数据分析项目时,如果数据文件托管在GitHub上,可以使用该工具便捷地获取数据文件的原始下载链接,用于导入到数据处理环境中。

35

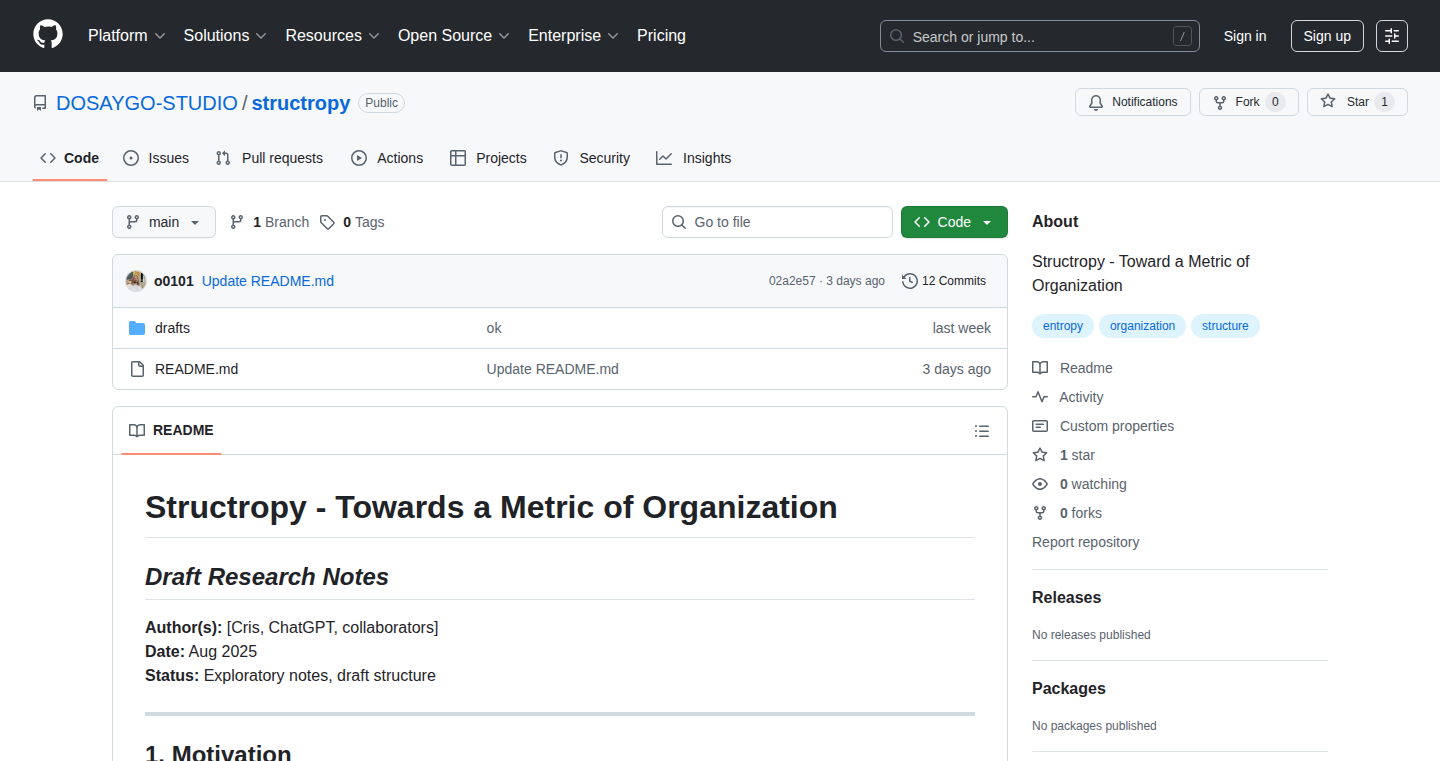

结构熵探索器

作者

keepamovin

描述

一个探索和量化信息结构“熵”的工具。它试图用一种新的视角来衡量信息结构的混乱或有序程度,帮助开发者理解和优化数据结构、算法效率,甚至代码的可维护性。

人气

点赞 2

评论数 1

这个产品是什么?

这是一个尝试为“信息结构”定义和计算“熵”值的项目。 传统上,熵更多地用于衡量信息的不确定性,比如一个随机事件的可能性。而这个项目则将熵的概念延伸到数据结构本身,比如一个列表、树形结构或者图。 它的核心创新在于,通过分析结构的组成元素(节点、边、属性等)的排列方式和它们之间的关系,来计算出一个“结构熵”的数值。 这个数值越高,代表结构越混乱、越不规则;反之,数值越低则代表结构越有序、越规整。 所以这对我有什么用? 它可以帮助你量化你的数据结构的混乱程度,让你知道你的数据是不是太“散”了,或者是不是过于“死板”,为优化数据存储和处理提供量化依据。

如何使用它?

开发者可以将这个工具集成到他们的开发流程中。 例如,你可以用它来分析数据库表的结构,评估文件系统的组织方式,或者检查算法生成的数据结构的复杂度。 它可以作为一种代码分析工具,输入你的数据结构,它会输出一个代表其“混乱度”的熵值。 这种量化数据可以用来比较不同数据结构的优劣,或者追踪代码重构过程中结构的变化。 所以这对我有什么用? 你可以用它来客观地评估你的代码设计,找到可以优化的地方,让你的程序运行得更快、更稳定。

产品核心功能

· 计算不同数据结构(如列表、树、图)的结构熵:根据结构中元素的排列和连接关系,提供一个量化指标来衡量其混乱或有序程度。这有助于开发者理解数据结构的内在复杂性。

· 可视化结构熵变化:如果工具支持,它可以展示熵值如何随结构变化而改变,帮助开发者直观地看到数据结构的演进过程。这对于调试和理解算法行为非常有帮助。

· 与其他结构指标关联分析:可能可以将结构熵与性能指标(如查找时间、内存占用)关联起来,找出影响性能的关键结构特征。这能指导开发者做出更优化的设计决策。

产品使用案例

· 在一个大型项目中,开发者使用结构熵来评估不同模块之间的数据交互结构,发现一个高度混乱的数据接口,并对其进行重构,显著提升了系统整体的稳定性和响应速度。

· 一位算法工程师利用结构熵来分析一个图算法生成的结果,通过监控结构熵的变化,成功调整了算法的参数,找到了最优的解决方案,解决了困扰已久的问题。

· 在数据库设计评审时,团队引入结构熵指标来评估表的关联和索引设计,避免了因过度复杂的数据结构导致的查询性能瓶颈。

36

Instaline: 智能代理短信/WhatsApp集成

作者

xdotli

描述

Instaline 是一个创新的项目,它让你的AI助手(例如Claude Code)能够拥有一个真实的电话号码,并能通过短信和WhatsApp与用户进行实时对话。项目解决了AI助手与用户交互的一个关键痛点,即缺乏一个独立、可信赖的通信渠道,让AI能够更像一个真人一样参与沟通。

人气

点赞 2

评论数 1

这个产品是什么?

Instaline 是一个旨在赋予AI代理(比如Claude Code)如同人类一样的沟通能力的平台。它通过为AI分配一个虚拟的电话号码,并集成短信和WhatsApp等即时通讯协议,使得AI能够主动发起和接收消息,进行双向的、实时的对话。其技术创新点在于,它构建了一个能够处理通信基础设施(telecommunication infra)的后端,能够动态生成和管理电话号码,并连接到AI模型,实现无缝的通信流程。

如何使用它?

开发者可以将Instaline集成到他们的AI代理工作流中。一旦设置好,AI代理就可以通过Instaline分配的电话号码,像普通人一样通过短信或WhatsApp发送和接收消息。这对于需要AI进行客户服务、信息通知、甚至是模拟对话场景的应用来说,提供了一个非常直接和实用的解决方案。你只需要提供必要的API接口和配置,Instaline的后端就能处理底层的通信细节。

产品核心功能

· AI代理电话号码分配:为AI代理生成和管理独立的电话号码,让AI拥有一个通信身份,这使AI能够更主动地与用户联系,而不仅仅是被动地等待用户发起。这在自动化客服、预约提醒等场景下非常有用。

· 短信/WhatsApp集成:支持通过标准的短信和WhatsApp协议与用户进行通信,这意味着AI可以使用用户最常用的通信方式与用户互动,降低了用户接触AI的门槛,提高了沟通效率。

· 实时双向通信:实现AI与用户之间实时的消息收发,让对话流程更加流畅自然,这对于需要即时反馈或复杂交互的AI应用至关重要,比如在线辅导或技术支持。

· 通信基础设施后端:项目还在构建一个健壮的后端来管理通信基础设施,这表明它能够处理大量并发通信需求,并能扩展以支持更多电话号码和用户,确保了服务的稳定性和可靠性。

产品使用案例

· 客户服务自动化:客户服务AI代理可以通过Instaline接收客户的短信或WhatsApp咨询,并直接回复,实现24/7的即时客户支持,解决了人工客服的响应延迟和成本问题。

· 智能助手通知:AI助手可以主动通过短信或WhatsApp向用户发送重要通知,例如会议提醒、订单更新或紧急警报,让用户能够及时获取信息,提高生活和工作效率。

· 用户行为分析与互动:在营销或产品推广场景中,AI可以通过Instaline与用户进行个性化互动,收集用户反馈,甚至引导用户完成特定操作,增强用户参与度。

· 虚拟客服模拟:为需要模拟真实对话场景的应用提供支持,例如培训销售人员或测试新的聊天机器人,Instaline可以让AI代理在真实通信环境中进行练习和评估。

37

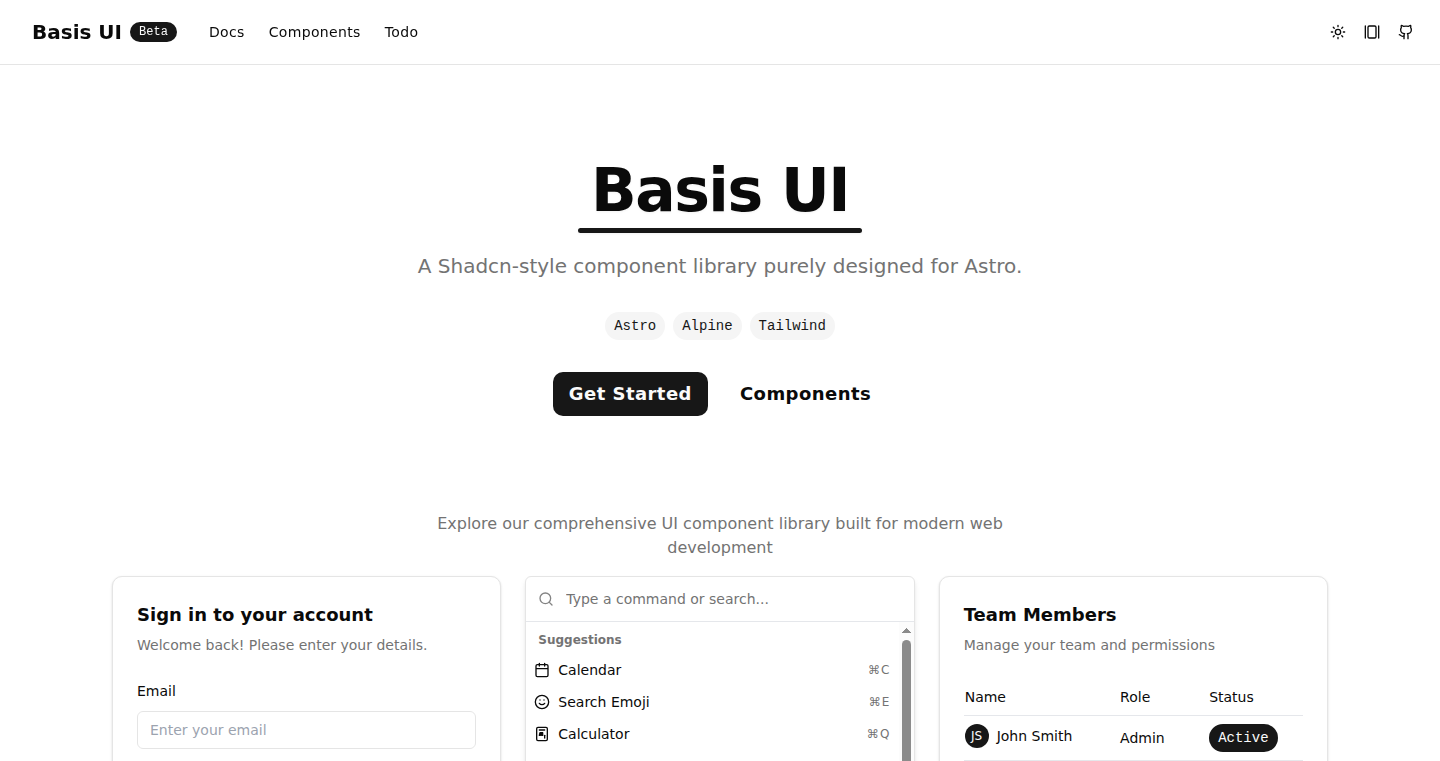

Basis UI - Astro极简组件库

作者

Zhengyi

描述

Basis UI 是一个为 Astro 等极简静态网站生成器(SSG)设计的 UI 组件库,它借鉴了 Shadcn UI 的风格和开发体验。开发者可以在不引入 React、Vue 或 Svelte 等重量级框架的情况下,通过 Basis UI 轻松构建美观且功能丰富的网页,专注于内容和核心业务逻辑,而不是复杂的框架配置。

人气

点赞 2

评论数 0

这个产品是什么?

Basis UI 是一个UI组件库,它的核心理念是“少即是多”。想象一下,你只想做个简单的博客或者产品介绍页面,但像 React 或 Vue 这样的前端框架配置起来很麻烦,而且很多高级功能你也用不上。Basis UI 就像是给 Astro 这样轻量级的建站工具准备的“乐高积木”,它提供了预先设计好的、漂亮的 UI 组件,比如按钮、卡片、模态框等等,你可以直接拿来用,并且可以像搭积木一样轻松组合它们。它的特别之处在于,它专门为 Astro 这种“只在需要时才添加JavaScript”的工具而设计,让你在享受极简开发的同时,也能拥有漂亮的界面和流畅的用户体验,而不需要学习一套全新的复杂框架。

如何使用它?

开发者可以将 Basis UI 集成到他们的 Astro 项目中。通常,这可以通过 npm 或 yarn 包管理器安装 Basis UI 库,然后在 Astro 的组件文件中导入并使用 Basis UI 提供的组件。例如,如果你想添加一个按钮,你只需要在你的 Astro 文件中写类似 `<Button>点击我</Button>` 这样的代码。Basis UI 的组件被设计成可以独立工作,或者与其他 Astro 组件无缝配合,让你在保持项目极简的同时,快速实现设计需求。

产品核心功能

· 提供一套预制的、高度可定制的UI组件,例如按钮、输入框、卡片、导航栏等,方便开发者快速构建界面,解决“从零开始设计UI”的问题。

· 组件设计遵循 Shadcn UI 风格,保证了现代、美观的视觉效果,让极简项目也能拥有专业级的界面,提升用户体验。

· 专为 Astro 等极简SSG框架优化,只在需要时加载JavaScript,确保网站的加载速度和性能,解决前端框架带来的性能负担。

· 组件采用原生JavaScript编写,支持自由组合和深度定制,开发者可以根据项目需求调整组件的样式和行为,体现了黑客精神中“用最少的代码实现最多功能”的创造力。

产品使用案例

· 一个开发者想要为他的技术博客快速添加一个“代码片段展示”的组件,他可以使用 Basis UI 的卡片组件(Card)和预格式化的文本展示,就能迅速得到一个美观的代码块,而无需编写复杂的CSS和JS来处理代码高亮和布局,这样他可以专注于写博客内容。

· 一个小型创业公司需要一个简单的产品展示页面,使用 Astro 和 Basis UI,他们可以快速搭建起带有精美按钮、图片展示卡片和简单的导航菜单的页面。这比用 React 或 Vue 从零开始搭建要快得多,并且性能更好,能让用户更快地看到产品信息。

· 一位开发者正在为他的个人作品集网站寻找一个轻量级的解决方案,他选择了 Astro 并集成了 Basis UI。通过 Basis UI 的组件,他能够轻松地创建展示项目缩略图的卡片,并实现简单的交互效果,例如鼠标悬停时显示项目详情,整个过程无需复杂的JavaScript编程,大大提高了开发效率。

38

Clariti - 沉浸式声景工作与助眠应用

作者

liornitzan

描述

Clariti 是一款极简风格的跨平台应用,专注于通过可定制的声景(Soundscapes)帮助用户提升专注力、放松身心或改善睡眠。它解决了开发者和父母在寻找干净、无干扰的深度工作和睡前习惯解决方案时遇到的痛点,市面上多数应用功能臃肿且充斥广告。Clariti 强调隐私至上,可在本地运行,无需账户,并提供多种白噪声、粉红噪声、自然声音以及动态分层声音,特别为ADHD用户设计了专注和镇静模式。其核心创新在于提供了一个高度轻量化且可快速安装的命令行(CLI)版本,用户仅需通过 Homebrew 即可立即使用,这体现了黑客文化中用代码解决问题的创造力。

人气

点赞 1

评论数 1

这个产品是什么?

Clariti 是一个用代码创造宁静的工具。它的技术核心在于生成和混合各种不同类型的声音,比如让人平静的白噪声(就像收音机没调好时的沙沙声),粉红噪声(比白噪声低沉一些,更接近自然雨声),还有各种真实的自然声音(如下雨、海浪、风声)。开发者通过精妙的声音合成技术,能够创造出动态且分层的声音体验,让用户仿佛置身于一个纯净的听觉环境。ADHD模式则是通过特定的声音频率和节奏来引导大脑进入更专注或更放松的状态。它支持本地运行,意味着你的数据和声音生成都在你的设备上完成,非常安全。最特别的是,它可以通过命令行工具(如 Homebrew)一键安装,这意味着它非常轻量,不会拖慢你的电脑,并且能以最纯粹、最直接的方式为开发者服务。所以,它用技术手段为你隔绝外界干扰,创造一个只属于你的宁静空间。

如何使用它?

作为开发者,你可以通过 Homebrew 这个 macOS 和 Linux 上的包管理器,输入 `brew install clariti` 命令,就能在你的终端里快速安装并启动 Clariti。一旦安装完成,你就可以在终端中直接通过简单的命令来选择和播放你想要的声音,比如指定播放雨声或者白噪声,甚至设置声音的混合比例和时长。这种方式对于那些习惯在终端里工作,追求高效和极简体验的开发者来说,可以无缝集成到他们日常的工作流程中。例如,当你需要进入一段深度编码时间,只需在终端输入命令启动 Clariti,选择一段专注模式的声音,就能立即进入状态,而无需离开键盘或打开另一个图形界面应用。它也提供了图形界面(GUI)版本,支持 macOS、iOS 和 Apple Watch,方便在不同设备上切换使用。

产品核心功能

· 可定制声景生成:根据用户选择的声音类型(如棕噪声、粉红噪声、自然声音)和它们的混合比例,实时生成高质量音频。价值在于提供高度个性化的听觉体验,满足不同用户在不同场景下的需求,如专注工作或睡前放松。

· ADHD模式:提供专门设计的专注和镇静声景,利用特定频率和节奏引导大脑活动。价值在于为有特定神经发育需求的群体提供有效的辅助工具,帮助他们提升日常表现。

· 本地化运行与隐私保护:所有声音生成和用户设置都在本地完成,无需联网或注册账户。价值在于保障用户隐私安全,尤其对于敏感数据或注重个人信息保护的用户而言,这提供了极大的信任感。

· 命令行界面(CLI)支持:通过 Homebrew 等包管理器轻松安装和管理。价值在于为追求效率和极简主义的开发者提供快速、便捷的使用方式,无缝融入现有开发环境,减少不必要的软件安装和界面切换。

· 跨平台支持:除了 CLI 版本,还提供 macOS、iOS 和 Apple Watch 的图形界面版本。价值在于用户可以在不同设备上同步使用,满足多样化的使用习惯和场景需求。

产品使用案例

· 在进行需要高度集中的编码任务时,开发者可以在终端输入 `clariti focus`,然后播放一段混合了雨声和低频棕噪声的声景,这可以有效屏蔽办公室或家庭的干扰声,帮助开发者沉浸在代码的世界里,提高工作效率。所以这对我有什么用?它能让你在不打断思绪的情况下,快速为你创造一个宁静的专注环境。

· 睡前,用户可以在 Mac 上打开 Terminal,输入 `clariti sleep`,选择一段舒缓的自然声音,比如海浪或篝火声,并设定一个自动停止时间。这能帮助用户在睡前放松下来,摆脱白天工作的压力,更快地进入梦乡。所以这对我有什么用?它能帮助你更轻松地入睡,改善睡眠质量。

· 作为一名需要频繁切换任务的开发者,在项目会议间隙,用户可以使用 `clariti calm` 来播放一段镇静声景,快速平复情绪,恢复精神状态,为下一次任务做好准备。所以这对我有什么用?它能帮助你在快速切换工作状态时,快速调整好心态,保持高效。

39

fst-目录深度统计大师

作者

Forgret

描述

fst 是一个用 C 语言编写的轻量级命令行工具,它能够快速、详细地统计一个目录下的各种信息。就像一个目录的“体检医生”,能告诉你里面有多少文件、子文件夹、空文件/文件夹,还能区分文件类型(文本、二进制、脚本),甚至告诉你文件的最新和最老修改时间,以及文件大小的分布。它不依赖任何其他软件,可以直接编译运行,非常适合需要快速了解目录内容和结构的开发者。

人气

点赞 2

评论数 0

这个产品是什么?

fst 是一个专门用来分析和统计目录内容的 C 语言小工具。它的核心创新在于其极致的简洁和速度。开发者用纯 C 语言编写,不依赖任何外部库,这意味着它在任何 Linux 或 macOS 系统上都可以轻松编译和运行,即使在资源受限的环境下也能表现出色。它提供了一整套关于目录及其内容的详细数据,例如文件数量、文件夹数量、空文件/文件夹的数量,还会智能地将文件分类(比如文本文件、二进制文件、脚本文件),还能分析出文件大小的最小值、最大值和平均值,甚至能帮你找到最近或最久远被修改的文件。最关键的是,它非常快,而且可以独立运行(无需安装其他软件),特别适合那些需要快速获取目录信息而不想折腾环境的开发者。

如何使用它?

开发者可以在 GitHub 上找到 fst 的源代码(链接:https://github.com/Ferki-git-creator/fst-ferki)。下载后,按照 README 文件中的指示进行编译(通常很简单,比如 make 命令)。编译成功后,你就可以在命令行中使用 `fst` 命令来分析目录了。例如,在当前目录下运行 `fst`,它会立即给你一个详细的统计报告。你也可以指定目录,比如 `fst /path/to/your/directory` 来分析其他目录。它支持递归分析,所以即使目录很深,也能一次性获取所有信息。此外,它还可以显示人类可读的文件大小(比如 KB, MB, GB),让你一眼就能看懂。可以把它集成到自己的脚本中,用来自动化文件管理、清理或分析工作。

产品核心功能

· 目录内容统计:快速计算目录下的文件和子目录总数,帮助你了解目录的规模。

· 文件类型分类:区分文本、二进制、脚本文件等,让你快速了解目录内容的构成。

· 文件大小分析:提供文件大小的最小、最大、平均值,帮助你理解目录中文件的大小分布情况。

· 文件时间戳追踪:识别最近和最久远被修改的文件,方便查找特定时间段内的文件。

· 链接信息识别:列出符号链接和硬链接,有助于理解文件系统的结构和依赖关系。

· 易读的单位显示:文件大小以 KB, MB, GB 等形式显示,方便理解和比较。

· 递归统计:深入到子目录中进行统计,提供完整的目录层级信息。

产品使用案例

· 代码仓库大小分析:开发者可以使用 fst 快速查看其代码仓库中不同类型文件的数量和大小分布,优化存储空间或识别大型文件。

· 项目依赖检查:在进行项目维护时,通过 fst 了解包含哪些脚本文件、可执行文件,以及文件修改时间,帮助定位最近的改动或潜在问题。

· 日志文件清理:通过 fst 识别出非常久远未被访问的日志文件,然后自动化清理,释放磁盘空间。

· 自动化文件管理:将 fst 的输出作为输入,编写脚本自动整理、备份或移动文件,例如将所有大于 1GB 的文件移动到特定目录。

· 系统性能诊断:在性能瓶颈排查时,快速了解某个目录下的文件数量和大小,判断是否由于大量小文件或过大文件导致 I/O 问题。

40

Foxi: 灵动预算规划器

作者

atomicts

描述

Foxi 是一款为解决传统预算应用复杂难用、且无法提供电子表格般灵活性的痛点而设计的 iOS 预算规划与追踪应用。它摒弃了繁琐的账户注册,提供简洁直观的用户界面,并通过创新的“平衡对比”功能,让用户能够轻松理解并管理自己的财务状况,其核心价值在于将电子表格的强大灵活性与移动应用的便捷易用性相结合,特别适合那些觉得现有预算App太复杂,但又想摆脱混乱电子表格的用户。

人气

点赞 2

评论数 0

这个产品是什么?

Foxi 是一款 iOS 上的预算规划与追踪应用。它解决了许多用户在预算管理上的痛点:很多现有的预算App要么只专注于记录支出,要么设计得过于复杂,导致用户难以坚持使用。而传统的电子表格虽然灵活,但在手机上管理起来却很麻烦且容易出错。Foxi 的创新之处在于,它模仿了电子表格的灵活性,允许用户像在表格中一样自由地设置和调整预算,但同时又提供了极其简洁干净的用户界面,避免了复杂的操作。它还特别强调“平衡对比”功能,帮助用户直观地看到各项预算的实时状态,让你一眼就能了解自己的财务全貌。

如何使用它?

开发者可以使用 Foxi 来高效地规划个人或项目的预算。例如,你可以为新项目设定详细的费用预算,并实时追踪各项开销的进度,确保不超过预算。由于它无需注册账户,你可以直接开始创建预算,并使用其简洁的界面进行日常的收支记录与调整。如果需要备份,Foxi 也提供了方便的备份机制,你可以轻松将预算数据导出或迁移,确保你的财务计划安全可靠。它就像一个随身携带、随时可用的智能预算助手。

产品核心功能

· 灵活预算设置:允许用户像电子表格一样自由创建和调整预算类别及金额,避免了固定模板的僵化,让你能够根据实际需求精确规划,所以这对我很有用,可以按我自己的方式管理钱。

· 直观余额对比:核心功能,实时展示各项预算的余额和支出情况,让你一目了然地知道钱花在了哪里,还有多少可用,所以这对我很有用,能帮助我迅速发现超支的可能。

· 简洁易用界面:摒弃了不必要的复杂元素,设计极简,学习成本低,能让你快速上手,高效管理,所以这对我很有用,即使我不是技术专家也能轻松使用。

· 无需注册登录:保护用户隐私,省去了繁琐的注册流程,让你即开即用,所以这对我很有用,避免了账号管理和信息泄露的担忧。

· 便捷数据备份:提供简单的预算数据备份和导出功能,方便用户进行数据迁移或长期存档,所以这对我很有用,能确保我的财务数据安全,不怕丢失。

产品使用案例

· 个人月度预算管理:用户可以为餐饮、交通、娱乐等各项开销设定月度预算,并实时追踪,防止超支,解决的问题是:避免了因记账复杂而放弃管理。

· 短期项目经费控制:项目经理可以为项目中的不同环节(如开发、市场推广)设定预算,并实时查看资金使用情况,确保项目按预算进行,解决的问题是:提高了项目财务的可控性。

· 旅行预算规划:在旅行前,用户可以为住宿、交通、餐饮、景点门票等设置预算,并在旅行过程中记录实际花费,解决的问题是:让旅行财务管理更清晰,避免旅行中乱花钱。

41

AnyBear Claude笔记集成器

作者

svasylenko

描述

一个实验性的项目,旨在探索如何将AnyBear(一个本地的、Markdown为基础的笔记应用)与Claude(一个强大的人工智能语言模型)结合使用。它解决的核心技术问题是如何在本地笔记环境中,利用AI来增强笔记的组织、搜索和内容生成能力,从而为用户提供更智能的笔记体验。

人气

点赞 1

评论数 1

这个产品是什么?

AnyBear Claude笔记集成器是一个尝试性项目,它希望把AnyBear这个能在你电脑本地存放大段文字(Markdown格式)的笔记软件,跟Claude这个很聪明的AI助手联系起来。想象一下,你平时在AnyBear里写笔记,记录想法,而Claude可以帮你把这些笔记整理得井井有条,或者帮你根据笔记内容写出新的文章、总结要点。它创新的地方在于,它不是把你的数据都上传到云端,而是探索如何在本地环境里,让你的笔记软件“活”起来,更聪明地帮你处理信息。所以,它的价值在于,让你的个人知识库和你自己的AI助手能够更紧密地协作,而不用担心数据隐私问题。

如何使用它?

对于开发者来说,这个项目目前更像是一个概念验证(Proof of Concept)和技术探索。你可以把它看作是一个API(应用程序接口)的集成示例。如果你是AnyBear的用户,并且对使用AI增强笔记感兴趣,你可以关注这个项目的进展。开发者可以通过研究它如何调用Claude的API,以及如何将Claude的输出(比如整理后的文本、生成的摘要)反馈回AnyBear的Markdown文件中,来学习如何在自己的项目中实现类似的AI与本地应用的集成。可以想象,未来如果这个项目成熟,开发者可以基于这个思路,为其他本地笔记应用或者知识管理工具添加AI功能。

产品核心功能

· 本地笔记与AI模型交互:通过API调用Claude,实现对AnyBear笔记内容的智能分析和处理,这意味着你的私人笔记可以被AI理解并提供有价值的反馈,这对我来说,意味着我的笔记不再是死数据,而是可以被AI加工的信息源。

· AI辅助内容生成:利用Claude的能力,根据AnyBear中的笔记内容生成摘要、拓展思路或改写文本,这对我来说,意味着我可以更高效地从大量笔记中提炼信息,或者基于已有想法快速创作新的内容。

· 智能搜索与组织:潜在地,AI可以帮助更深入地理解笔记内容,实现更精准的搜索和更智能的笔记组织方式,这对我来说,意味着我能更快地找到我需要的信息,而且笔记结构可能比我自己组织的还要好。

· 数据隐私考虑:探索在本地环境调用AI,尽量减少敏感数据暴露在第三方服务器的风险,这对我来说,意味着我可以在使用AI便利的同时,更好地保护我的个人隐私和知识产权。

产品使用案例

· 学术研究场景:一个研究人员在AnyBear中记录了大量的研究笔记和文献摘要,通过集成Claude,可以快速让AI总结出不同文献之间的联系,或者提炼出某个研究主题的关键论点。这解决了研究人员需要花费大量时间手动梳理文献的痛点。

· 写作与创作场景:一个作家在使用AnyBear记录小说构思、角色背景和情节发展,集成Claude后,可以请AI根据现有笔记提供新的情节发展建议,或者润色描写。这解决了创作过程中可能遇到的“卡文”问题。

· 个人知识管理:一个人用AnyBear记录了学习新技能的所有步骤、遇到的问题和解决方案。集成Claude后,可以请AI将这些杂乱的步骤整理成一份清晰的学习指南,或者根据某个具体问题,让AI在笔记中找到最相关的解决方案。这解决了信息分散,查找困难的问题。

42

BrowserRay: 浏览器里的效率启动器

作者

mddanishyusuf

描述

BrowserRay 是一个为浏览器打造的效率启动器,灵感来源于 macOS 的 Raycast。它允许用户通过一个快捷键呼出搜索框,然后输入命令来快速执行各种浏览器内的操作,比如搜索标签页、快速切换应用、打开书签,甚至可以自定义脚本。它解决了用户在浏览器中需要频繁点击、搜索才能完成的任务,通过代码指令的方式,极大地提升了在浏览器中的操作效率,是一种“用代码驱动”浏览器使用的新范式。

人气

点赞 1

评论数 1

这个产品是什么?

BrowserRay 是什么?它是一个在浏览器地址栏或固定位置出现的弹窗式搜索框,当你按下预设的快捷键(比如 Ctrl+Space)时就会激活。激活后,你可以输入各种命令来控制你的浏览器。例如,你可以输入 `tab youtube` 来快速找到并切换到 YouTube 标签页,或者输入 `bookmark react` 来打开你保存的关于 React 的书签。它的技术核心在于 intercepting 键盘输入,然后解析用户的指令,并通过浏览器提供的 JavaScript API 来执行相应的操作,比如管理标签页、历史记录、书签、甚至调用外部服务。创新的地方在于将桌面级的效率启动器概念移植到了浏览器环境中,并且允许用户通过自定义脚本来扩展功能,真正实现了“用代码解决问题”的黑客精神。

如何使用它?

开发者可以通过安装 BrowserRay 的浏览器扩展来实现。安装后,你可以设置一个激活快捷键。然后,当你需要在浏览器中快速完成某项操作时,按下这个快捷键,就会出现一个搜索框。你可以直接输入命令,例如:`search google <你的搜索词>`,它会自动在新标签页中打开 Google 并搜索。你也可以输入 `close others` 来关闭除了当前标签页之外的所有标签页。更进一步,如果你懂一点 JavaScript,你可以编写自己的自定义脚本,让 BrowserRay 来执行,比如定时刷新某个页面,或者抓取特定网站的信息。这使得 BrowserRay 不仅仅是一个搜索工具,更是一个高度可定制化的浏览器自动化助手。

产品核心功能

· 快速标签页搜索与切换:通过输入标签页的部分名称,即可快速找到并切换到目标标签页,解放了手动查找标签页的时间。

· 书签搜索与访问:输入书签关键词,即可快速打开保存的书签,无需在层层文件夹中翻找。

· 浏览器历史记录搜索:方便快捷地查找浏览过的历史页面。

· 应用快速启动(通过书签或特定URL):可以预设常用网站的书签,并为其设置简短的命令,实现一键启动。

· 自定义命令与脚本执行:允许用户编写 JavaScript 脚本,为 BrowserRay 增加更多个性化功能,例如批量操作、自动化任务等,充分发挥了技术创新的自由度。

产品使用案例

· 同时打开了十几个标签页,需要快速切换到关于 React 文档的页面:输入 `tab react`,BrowserRay 会列出包含 'react' 字样的标签页,选择后即可快速切换,而不是一个个手动找。

· 想快速打开自己收藏的几个编程学习网站:可以为这些网站创建书签,并设置简短的命令,比如 `learn js`,按下快捷键输入 `learn js` 即可直接打开 JavaScript 学习网站。

· 需要关闭除当前标签页外的所有标签页以清净工作区:按下快捷键,输入 `close others`,一键清理,保持专注。

· 想做一个简单的脚本,每隔一小时刷新一次某个监控页面:可以编写一个简单的 JavaScript 脚本,让 BrowserRay 定时触发,实现自动化监控,无需人工干预。

43

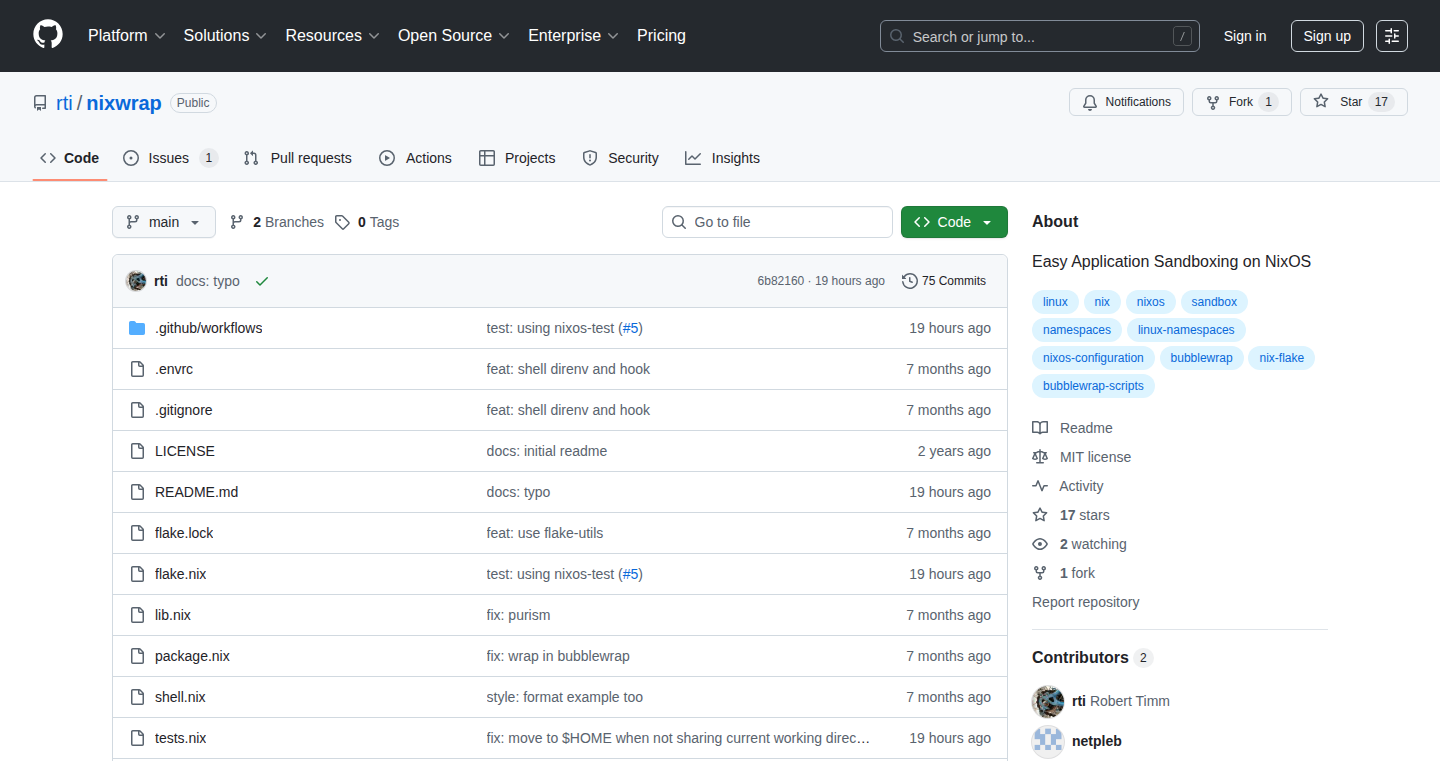

NixWrap: 弹性沙盒打包器

作者

rttti

描述

NixWrap 是一个为 NixOS 用户设计的即时沙盒工具,它基于 bubblewrap(一个Linux系统沙盒工具),提供了更简洁易用的命令行界面。开发者可以使用它来安全地运行那些来源不明或潜在不信任的代码,比如来自NodeJS或Python项目的依赖,从而保护自己的开发环境免受恶意代码的侵害。

人气

点赞 2

评论数 0

这个产品是什么?

NixWrap 是一个让开发者能够安全运行不可信代码的工具,特别是在使用 NixOS 系统时。它本质上是给 bubblewrap 加了一层“方便面”,让原本复杂的沙盒配置变得简单。你可以把它想象成给你的代码进程穿上了一层“防护服”,限制它能访问哪些系统资源(比如网络、文件),就像给淘气的小孩戴上“安全手套”。这样做的好处是,即使你运行的代码有恶意行为,也不会轻易损坏你的电脑系统。

如何使用它?

开发者可以在 NixOS 环境下,通过简单的命令行指令来使用 NixWrap。例如,如果你需要安装 NodeJS 项目的依赖(npm install),你可以使用 `wrap -n npm install`。这里的 `-n` 参数就意味着允许网络访问,并且可以修改当前文件夹里的文件,但这个操作会被限制在沙盒环境中。你可以根据需要调整不同的参数,来控制沙盒的权限,比如完全禁止网络访问,或者只允许读写特定目录。

产品核心功能

· 提供简洁的沙盒配置:通过简单的命令行参数,就可以快速配置一个安全的沙盒环境,省去了手动配置复杂的沙盒命令,这使得开发者能更快地进行实验和开发。

· 基于 bubblewrap 的强大沙盒能力:它利用了 bubblewrap 本身强大的隔离和资源限制能力,确保了沙盒的稳定性和安全性,开发者可以放心地运行未知来源的代码。

· 灵活的权限控制:用户可以精确控制沙盒内的进程可以访问哪些网络资源、哪些文件目录,甚至可以限制其对系统资源的调用,这对于隔离不同项目或测试有风险的代码至关重要。

· 快速的沙盒启动:与手动配置 bubblewrap 相比,NixWrap 的设计目标是更快的启动速度,让开发者在日常开发流程中几乎感觉不到额外的延迟。

产品使用案例

· 在 NixOS 上安装和运行来自不可信第三方源的 Python 包,比如通过 `wrap -n pip install <package>`,这样可以避免这些包影响到宿主系统的 Python 环境或造成安全风险。

· 测试一个来自 Github 的新 NodeJS 项目,运行 `wrap -n npm install && wrap -n npm start`,确保项目的依赖安装和启动过程不会写入敏感的系统目录,或者访问不应该访问的网络。

· 运行一个需要访问特定数据文件的命令行工具,但又不希望它能够随意修改系统中的其他文件,可以使用 `wrap --bind /data:/data <command>` 来指定只能访问 `/data` 目录,其他目录都是不可写的。

44

Precog:AI驱动的PDF智能标注与引用助手

作者

ieuanking

描述

Precog 是一款旨在解决当前AI聊天机器人无法有效处理PDF文档标注和引用的问题而开发的工具。它通过增强的OCR(光学字符识别)技术和智能代理,允许用户直接在上传的PDF文档中高亮文本、引用来源,并与AI进行交互,从而大幅减少AI的“幻觉”(不准确或捏造的信息),提升信息获取的精准度和效率。这对于需要进行论文修订、资料收集和快速浏览文献的开发者来说,提供了一个更可靠、更高效的工作流程。

人气

点赞 2

评论数 0

这个产品是什么?

Precog 是一个基于AI的PDF文档分析工具,它解决了传统AI聊天机器人无法直接对PDF内容进行精准标注和引用的痛点。其核心创新在于集成了先进的OCR技术,能够识别PDF中的文字信息,并结合了“智能代理”(Agentic)的概念,让AI在与用户互动时,能够像一个有经验的研究助手一样,精确地定位并引用PDF中的特定信息。用户可以通过在提问时使用'@'符号来引用PDF中的内容(类似于代码编辑器中的引用功能),这极大地增强了AI的上下文感知能力,从而有效降低了AI生成内容的错误率,并能随着用户交互的增加,更深入地理解用户的需求。所以,它能让AI工具在处理你的PDF文档时,变得更“诚实”和“聪明”,大大减少了你手动查找和核对信息的时间。

如何使用它?

开发者可以将需要分析的PDF文档上传至Precog。在与Precog聊天时,你可以像在代码编辑器里引用代码一样,使用'@'符号加上PDF中的特定文本片段或概念来向AI提问或指示它进行操作。例如,你可以输入“@PDF_section_X 总结一下这个部分的观点”,Precog就会根据高亮或你指定的部分来回答。它还能记录你的笔记和互动历史,不断学习你关注的重点,提升后续的问答质量。这让你在研究、写代码文档或进行技术评审时,能够快速找到并利用PDF中的关键信息,而不用担心AI“瞎编”。

产品核心功能

· PDF内容智能高亮与引用:通过AI识别PDF中的关键信息,并允许用户使用@引用语法直接指向PDF的特定内容,确保AI的回答基于真实来源,提升信息的可信度。这解决了AI回答时常常脱离上下文的问题,让你能快速定位AI的依据。

· 上下文锁定与关联:Precog能将AI的对话上下文牢牢锁定在用户上传的PDF文件中,确保AI的回答始终围绕文档内容展开,避免不相关的干扰。这对于需要精确理解文档细节的开发者来说,可以更专注于核心的技术信息。

· AI幻觉最小化:通过强制AI引用PDF源文本,Precog显著降低了AI“一本正经地胡说八道”的可能性,提高了信息获取的准确性和可靠性。这让你在依赖AI辅助工作时,更有信心。

· 用户需求情境感知增强:随着用户与Precog的互动增多,AI能够学习和理解用户对文档内容的特定需求,提供更个性化、更贴合实际应用场景的回答。这使得Precog成为一个能随着时间推移越用越懂你的助手。

产品使用案例

· 开发者在阅读技术规范文档(如API文档、协议标准)时,可以使用Precog上传文档,然后向Precog提问“@文档中关于认证流程的部分,描述一下其核心步骤”,Precog会精准定位并总结,从而加速对复杂技术细节的理解。

· 当需要从大量的研究论文中快速提取关键论据或实验数据用于论文写作时,开发者可以将论文上传,并使用Precog的引用功能来收集和整理引用的段落。例如:“@论文A的实验部分,引用其关于性能测试的结论”,AI会直接从原文中提取,大大节省了手动摘录和校对的时间。

· 在进行软件版本更新或需求评审时,开发者可以上传产品需求文档或旧版API文档,然后询问Precog:“@新版本需求文档,对比新旧版本在用户管理模块的关键变更”,AI会分析并列出差异,帮助开发者快速把握更新要点,提高评审效率。

· 对于需要处理大量法律合同或项目合同的开发者,可以使用Precog上传合同,并高亮关键条款,然后询问:“@合同中关于知识产权的条款,总结其归属原则”,Precog能够准确提取相关信息,降低合同审查的风险和工作量。

45

Rust嵌入式OLED初始化探索者

作者

Placeless

描述

这是一个为嵌入式开发者设计的Rust库,它提供了一个极其精简(仅1.3KB)的算法,用于自动搜索和验证SH1107G OLED显示屏的初始化序列。对于在资源受限的嵌入式环境(如Arduino Uno)中使用Rust语言开发OLED显示,这是一个极具创新的解决方案,它解决了找不到可用驱动的痛点,并且在极其有限的内存下实现了OLED的正常工作。

人气

点赞 2

评论数 0

这个产品是什么?

这个项目是一个Rust库,专门解决在嵌入式设备上驱动SH1107G OLED显示屏初始化过程中的一个技术难题。通常,要让OLED显示屏正常工作,需要一系列特定的初始化指令。找到正确的指令序列对于嵌入式开发来说可能非常耗时,尤其是当现有的驱动不兼容或没有现成可用时。这个库的核心创新在于它包含了一个高效的算法,能够通过一种叫做“拓扑排序”的技术,系统地探索并找到OLED所需的正确初始化指令组合。这个算法被高度优化,特别适合资源非常有限的微控制器(比如Arduino Uno),它使用了位标志和静态数组等技术来最小化内存占用,最终可以将初始化过程的内存占用控制在1.3KB以内。所以,它解决了开发者在嵌入式Rust项目中使用OLED时,找不到可靠、轻量级初始化方法的挑战,并提供了极高的内存效率。

如何使用它?

如果你是一名Rust嵌入式开发者,正在尝试使用SH1107G OLED显示屏,并且你的开发环境资源非常有限(例如,你使用的是Arduino Uno这样的微控制器),那么你可以将这个库集成到你的项目中。你可以通过Cargo(Rust的包管理器)来添加这个依赖。一旦集成,你就可以利用它提供的工具来探索和应用OLED的初始化序列,让OLED能够正常显示内容。它还可以通过I2C接口扫描连接的设备,或者将数据以十六进制或二进制格式显示出来,这些工具对于调试嵌入式系统非常有用。

产品核心功能

· 自动化OLED初始化序列发现:通过创新的拓扑排序算法,自动找到SH1107G OLED显示屏所需的正确初始化指令集。这使得开发者无需手动查找和测试大量的初始化参数,极大地节省了开发时间,尤其是在资源受限的环境下,它确保了OLED的可靠工作。所以这对我来说,就是能让OLED快速、准确地启动,不用我费劲去查资料。

· 极端内存优化:算法被设计为在AVR微控制器(如Arduino Uno)的约束下运行,使用了位标志和静态数组等技术,将内存占用控制在1.3KB以内。这对于内存非常宝贵的嵌入式系统来说至关重要,它允许你在有限的RAM空间内集成OLED功能。所以这对我来说,就是能在内存小的设备上用上OLED,不会因为内存不足而无法实现功能。

· I2C设备扫描工具:提供一个扫描I2C总线上的设备的功能。在嵌入式开发中,了解哪些设备连接到总线上以及它们的地址是什么,是调试通信的关键步骤。所以这对我来说,就是可以方便地检查OLED或其他I2C设备是否正确连接。

· 十六进制/二进制数据转储:能够将数据以十六进制或二进制格式显示出来。这对于理解和调试数据传输过程非常有用,尤其是在低级别通信时。所以这对我来说,就是能看到数据最原始的样子,方便排查问题。

· 串行端口适配器:提供一个串行端口适配器,用于更方便地进行串行通信。在嵌入式项目中,串行通信是调试和与外界交互的常用方式。所以这对我来说,就是方便地通过电脑和我的嵌入式设备进行通信和调试。

产品使用案例

· 在一个仅有1KB SRAM的Arduino Uno板上,使用Rust语言成功驱动一个SH1107G OLED显示屏。开发者在找不到现成Rust驱动的情况下,利用此库的初始化探索算法,克服了内存限制,实现了OLED的正常显示。所以这个案例证明了该库在极度资源受限环境下的可行性和实用性。

· 当开发者在嵌入式Rust项目中使用多种传感器并通过I2C总线通信时,可以使用库中的I2C扫描工具快速确认所有传感器是否正确连接,并找出它们的I2C地址。这比手动逐个检查代码或参考数据手册要快得多,有效提高了调试效率。所以这个案例说明了该库在多设备通信调试中的便利性。

· 在开发一个物联网节点时,需要通过SPI接口将传感器数据发送到另一个微控制器,但数据传输出现异常。开发者可以使用库中的数据转储功能,将发送和接收的数据以十六进制格式打印出来,从而准确地定位数据格式或传输错误。所以这个案例展示了该库在低级别数据调试方面的价值。

46

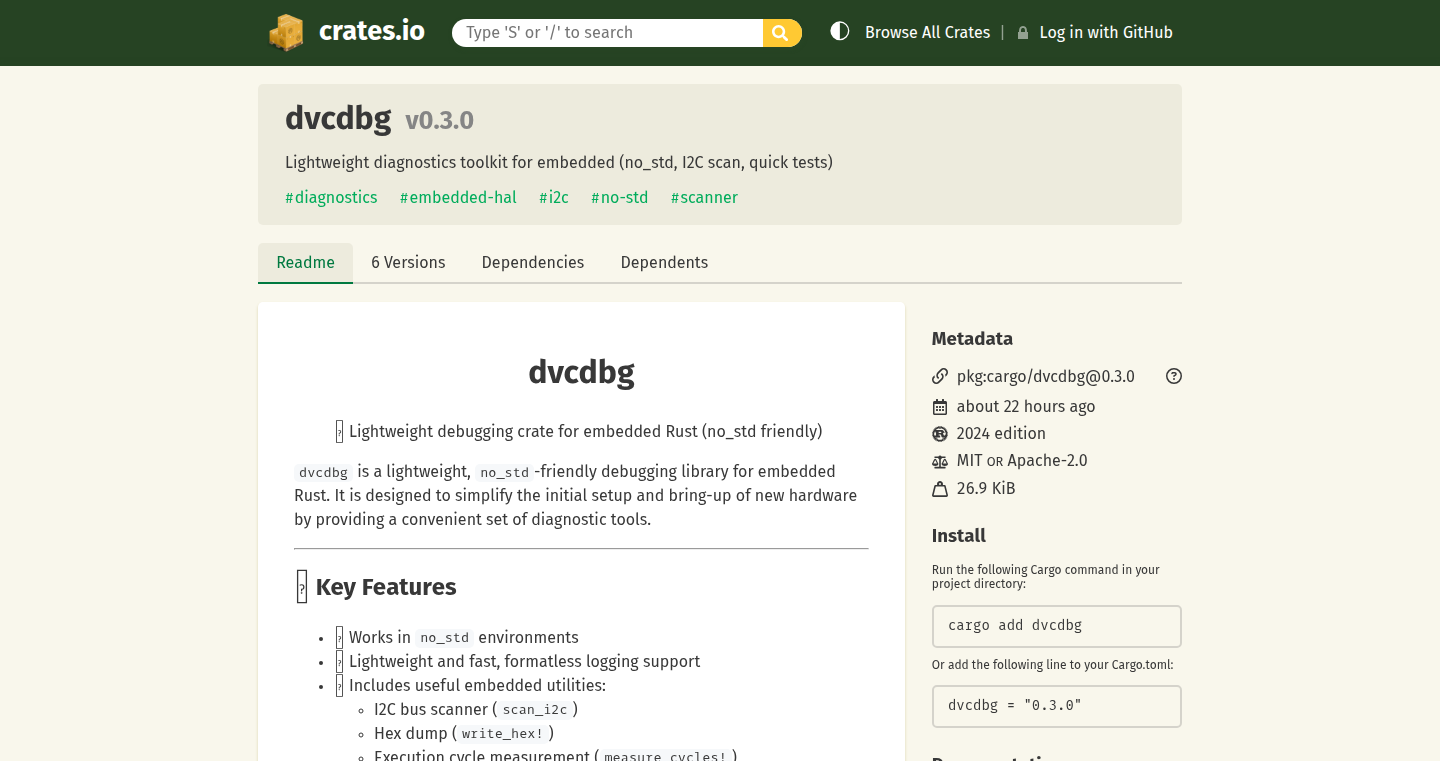

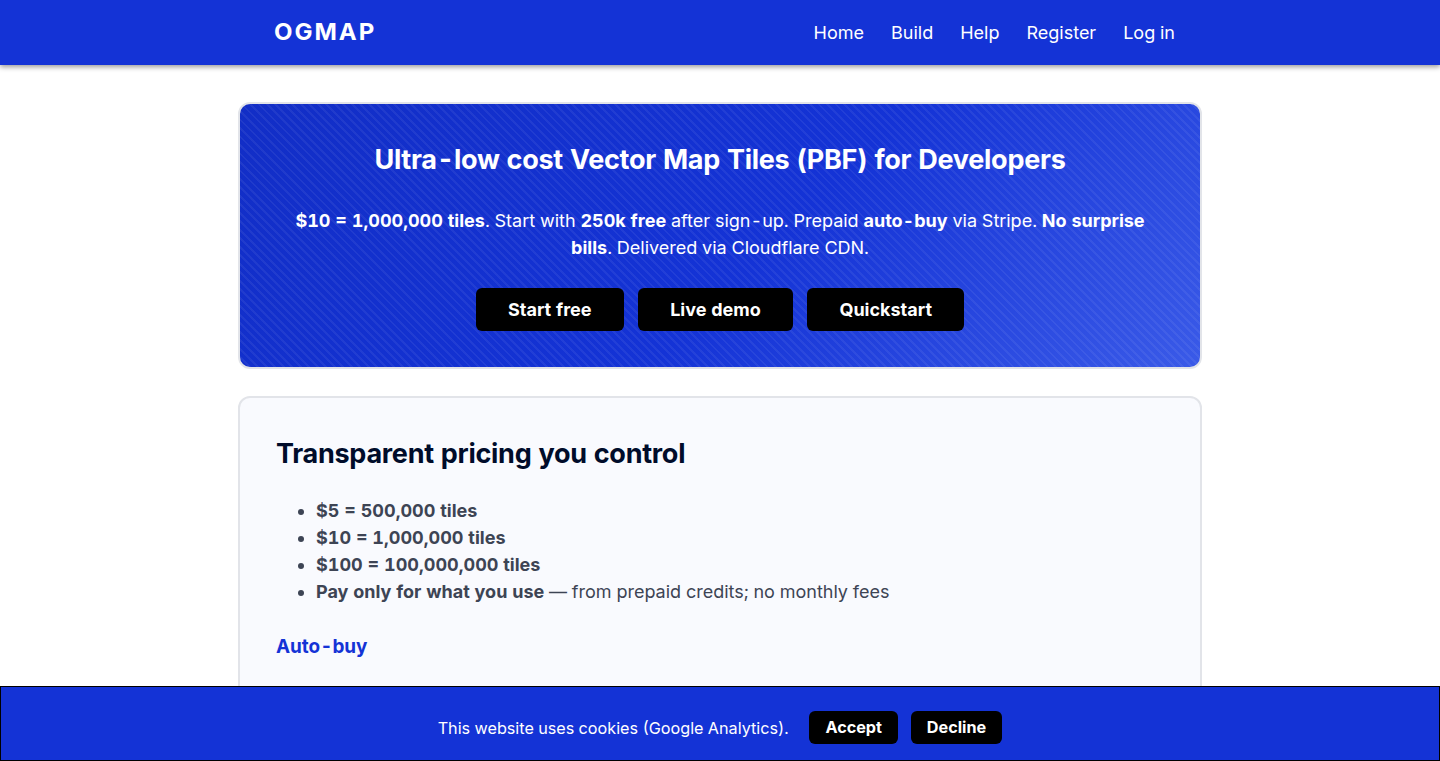

OGMAP: 极简低成本矢量地图瓦片API

作者

absurdwebsite

描述

OGMAP是一个为开发者设计的、价格极低的矢量地图瓦片API服务,采用PBF(Protocol Buffer)格式。它解决了许多小型项目或初创企业在地图服务上高昂的成本问题,让开发者无需担心地图API费用成为预算瓶颈,从而能够更专注于产品本身的创新。其核心优势在于简单、可预测的预付费定价模式和通过Cloudflare CDN提供的全球快速访问。

人气

点赞 2

评论数 0

这个产品是什么?

OGMAP是一个基于矢量瓦片技术的地图API服务,它提供了一种成本极低、易于使用的地图数据分发方式。不同于一些功能复杂的地图服务,OGMAP专注于提供快速、经济的地图瓦片(就像切好的地图小块),并支持MapLibre等开源地图库进行基本样式渲染。它的创新点在于其极简的定价模式,例如10美元就能获得100万个瓦片,并且有免费试用额度,用户可以通过Stripe进行自动充值,并设置消费上限。这使得开发者可以将地图API的成本降到最低,尤其适合预算有限的项目。它解决了开发者在项目初期或获得一定用户量后,传统地图API费用过高的问题,而且它作为一项服务,省去了开发者自己搭建和维护地图服务器的复杂性,确保了扩展性和可靠性。

如何使用它?

开发者可以使用OGMAP提供的API接口,在自己的Web或移动应用程序中加载和展示地图。集成非常简单,通常只需要在前端使用MapLibre GL JS或其他兼容的JavaScript地图库,然后配置OGMAP的瓦片URL。例如,你可以像这样设置地图图层:`'https://api.ogmap.com/tiles/{z}/{x}/{y}.pbf'`。OGMAP提供基础的地图样式,用户也可以根据自己的需求定制样式。对于需要快速原型设计或需要地图功能的初创项目,可以立即接入OGMAP,而无需进行复杂的服务器配置或支付高昂的月度费用。一旦项目受欢迎,OGMAP的低成本和可扩展性也能够支持用户量的增长。

产品核心功能

· 低成本矢量地图瓦片API: 以极低的预付费价格提供高效的地图数据(PBF格式),解决了地图API成本过高的问题,让开发者可以将更多预算投入到核心业务上。

· 简化的预付费定价模式: 提供简单、透明的充值方案,如10美元=100万瓦片,并有免费试用额度,让开发者能清晰预测并控制地图服务支出。

· 全球CDN加速访问: 通过Cloudflare CDN分发地图瓦片,确保用户在全球任何地方都能快速加载地图,提升用户体验。

· 基础地图样式支持: 提供对MapLibre等流行开源地图库的基础样式支持,方便开发者快速集成并进行基础的地图可视化。

· 自动购买与安全限额: 支持通过Stripe自动充值,并可设置消费上限,避免意外的高额账单,增强成本可控性。

产品使用案例

· 初创公司Web应用地图功能: 一个初创公司开发一个旅游推荐网站,需要在地图上展示景点信息。使用OGMAP,他们可以在地图功能上线初期,几乎零成本地提供丰富的地图交互,而无需担心用户量增长带来的API费用激增。

· 独立开发者个人项目: 一位独立开发者正在制作一个个人博客,希望在博客中加入一个展示其生活足迹的交互式地图。OGMAP的免费额度和低廉价格,让他在不投入额外费用的情况下,就能为博客增添一个吸引人的地图功能。

· 开源项目地图集成: 一个开源的社区项目需要一个地图组件来展示社区活动地点。OGMAP作为一项低成本、易集成的服务,可以被轻松地集成到项目中,为项目贡献者提供地图支持,而不会增加项目的运营负担。

· 低预算产品原型: 一家公司正在测试一个地理位置服务的新产品原型,需要快速验证市场需求。OGMAP允许他们在不确测产品是否成功前,就能以极低的成本集成和测试地图功能,避免前期的大量投入。

47

Accounts Draft: AI驱动的财会自动化引擎

作者

Rob_Benson-May

描述

Accounts Draft 是一款专为会计师设计的 AI 工具集,旨在通过自动化重复性、耗时的财会任务,如审计报告中的附注和披露审查、税法咨询等,来提升工作效率。其核心创新在于利用 AI 精准模仿专业会计师的思维模式和操作流程,提供比通用 AI 更准确、更具行业洞察力的解决方案,赋能会计行业数字化转型。

人气

点赞 2

评论数 0

这个产品是什么?

Accounts Draft 是一个利用人工智能技术,专门为解决会计行业痛点而开发的工具集合。它通过学习专业会计师的处理方式,能够高效地自动完成诸如审查复杂的财务报表附注、政策和披露信息,以及解答专业税法问题等任务。与市面上通用的聊天机器人相比,Accounts Draft 在财会领域的专业性和准确性上有着数量级的提升,就好比请了一位经验丰富的会计师助手,能够精准理解并执行专业指令,解决“AI 懂不懂财会”的问题,让AI真正成为会计工作的得力帮手。

如何使用它?

会计师和会计师事务所可以直接集成 Accounts Draft 到现有的工作流程中。例如,在审计过程中,可以将待审查的财务报告文件输入系统,AI会迅速完成初步的附注和披露信息检查,并标记出潜在的疑问点,让审计师能够专注于更深层次的分析和判断。在税务咨询方面,会计师可以向“Ask Tax Questions”模块提问具体的税法问题,AI会提供基于最新法规和实践的答案,极大地缩短了信息查询和研究的时间。此外,它还可以被用来自动化处理收到的客户信函等,解放会计师的双手。

产品核心功能

· 自动化财务报表附注和披露审查:AI模型模仿审计师的审查逻辑,快速识别报告中的关键信息和潜在风险,为审计工作提供高效的初步审查,节省了大量人工阅读和比对的时间。

· 精准的税法咨询问答:提供一个比通用AI更准确的税法知识库,会计师可以直接提问,获得基于最新法规和案例的解答,显著提高咨询效率和准确性,解决“AI能不能靠谱回答我的专业问题”的顾虑。

· 自动化客户文件处理:能够自动处理和解读客户寄送的信函、通知等文件,提取关键信息并进行初步分类,减少人工处理邮件和文件的负担,提升信息处理速度。

· 定制化工作流程自动化:允许根据事务所的特定需求,进一步定制和训练AI模型,以自动化更多内部的、具有重复性的财务处理流程,实现个性化的效率提升。

产品使用案例

· 在一次年度审计项目中,审计团队使用Accounts Draft自动审查了100多份财务报表的附注和披露。原本需要数天完成的初步检查工作,在AI的帮助下仅用了不到一天的时间完成,并且发现了之前人工审查时容易忽略的一些细微问题,大幅提高了审计质量和效率。

· 一家会计师事务所的税务咨询部门,引入了“Ask Tax Questions”功能。当客户提出复杂的增值税退税政策疑问时,AI能够快速给出准确的政策解读和操作指南,让咨询师有更多时间去处理更具战略性和客户沟通价值的事项,也让客户获得了更及时的专业服务。

· 某事务所使用Accounts Draft处理日常收到的客户信函。AI能够自动识别信函类型(如税务局通知、银行对账单等),提取关键日期和金额,并将其归档到正确的文件夹。这使得会计师无需逐一打开和阅读每封邮件,工作流程更加顺畅。

48

Envie:云端密钥安全交接站

作者

saleCz

描述

Envie 是一个开源且支持自托管的API+CLI工具,旨在解决开发团队在共享API密钥、环境变量等敏感信息时遇到的效率和安全问题。它提供了一种比传统文件传输更快捷、更安全的方式来管理和分发开发环境及生产环境中的敏感配置,让团队协作更顺畅,配置管理更集中。

人气

点赞 2

评论数 0

这个产品是什么?

Envie 是什么?它是一个专门为开发者设计的工具,用于安全地共享和管理API密钥、数据库密码等敏感的“环境变量”信息。想象一下,你不再需要把这些重要的“密码”通过聊天工具一句一句发给同事,或者把包含这些信息的文件在不同电脑间倒来倒去。Envie 通过一个API接口和命令行工具,提供了一个集中化的管理平台。其核心创新在于,它采用了客户端加密技术,这意味着敏感信息在传输过程中就已经被加密了,只有授权的用户才能解密。此外,它还利用类似Diffie-Hellman密钥交换的机制来安全地共享访问密钥,确保了只有你知道的特定同事才能获取他们需要的秘密信息。所以,对于开发者来说,Envie 提供了一个更安全、更高效的秘密信息管理方案,避免了因信息泄露带来的风险。

如何使用它?

开发者可以通过Envie的命令行工具(CLI)或者API来管理和获取环境变量。

命令行使用场景:

1. **本地开发环境同步:** 你可以将项目所需的API密钥、数据库连接字符串等敏感信息上传到Envie服务器,然后你的团队成员在拉取代码后,只需通过Envie CLI执行一个简单的命令,就能安全地获取这些配置,并将其自动加载到他们的本地开发环境中。这比手动复制粘贴或者通过聊天工具传递要快得多,也安全得多。

2. **快速切换环境:** 如果你的项目需要在开发、测试、预生产等多个环境之间切换,Envie可以让你快速下载对应环境的配置,而无需修改本地代码或重新配置。

API集成场景:

1. **CI/CD流水线集成:** 你可以将Envie的API集成到你的持续集成/持续部署(CI/CD)流程中。当代码部署到服务器或容器时,CI/CD脚本可以调用Envie API来获取生产环境所需的密钥,并将它们安全地注入到应用程序中。

2. **第三方服务集成:** 任何需要访问敏感配置的外部服务或应用,都可以通过Envie的API进行身份验证和配置获取,实现统一的安全管理。

总的来说,Envie就像一个开发者专属的“保险箱”,你可以把敏感信息存进去,然后安全地授权给需要的人或服务,并且可以方便地通过代码来获取,从而大大简化了开发和部署流程。

产品核心功能

· 客户端加密管理环境变量:确保敏感信息在传输过程中就已被加密,防止在不安全的网络中泄露,提升了信息传递的安全性。

· Diffie-Hellman式密钥交换:用于安全的共享访问密钥,只有经过授权的参与者才能解密信息,为团队协作提供安全保障。

· 集中化环境配置管理:将分散在各处的API密钥、密码等信息集中存储和管理,提供一个统一的接口,便于跟踪和控制。

· API与CLI接口:支持通过API与应用程序集成,或通过CLI工具快速获取和同步配置,满足不同开发场景的需求。

· 自托管能力:允许开发者将Envie部署在自己的服务器上,完全掌控数据的安全和隐私,适用于对数据安全有更高要求的团队或项目。

产品使用案例

· 团队A在开发一个需要多个第三方API的项目,成员分布在不同地区。过去,大家通过Slack互相发送API Key,效率低且有泄露风险。使用Envie后,团队负责人将所有API Key上传到Envie,并授予团队成员访问权限。团队成员只需要在本地运行Envie CLI命令,就能安全地获取最新的API Key,大大提高了开发效率和协作安全性。